简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

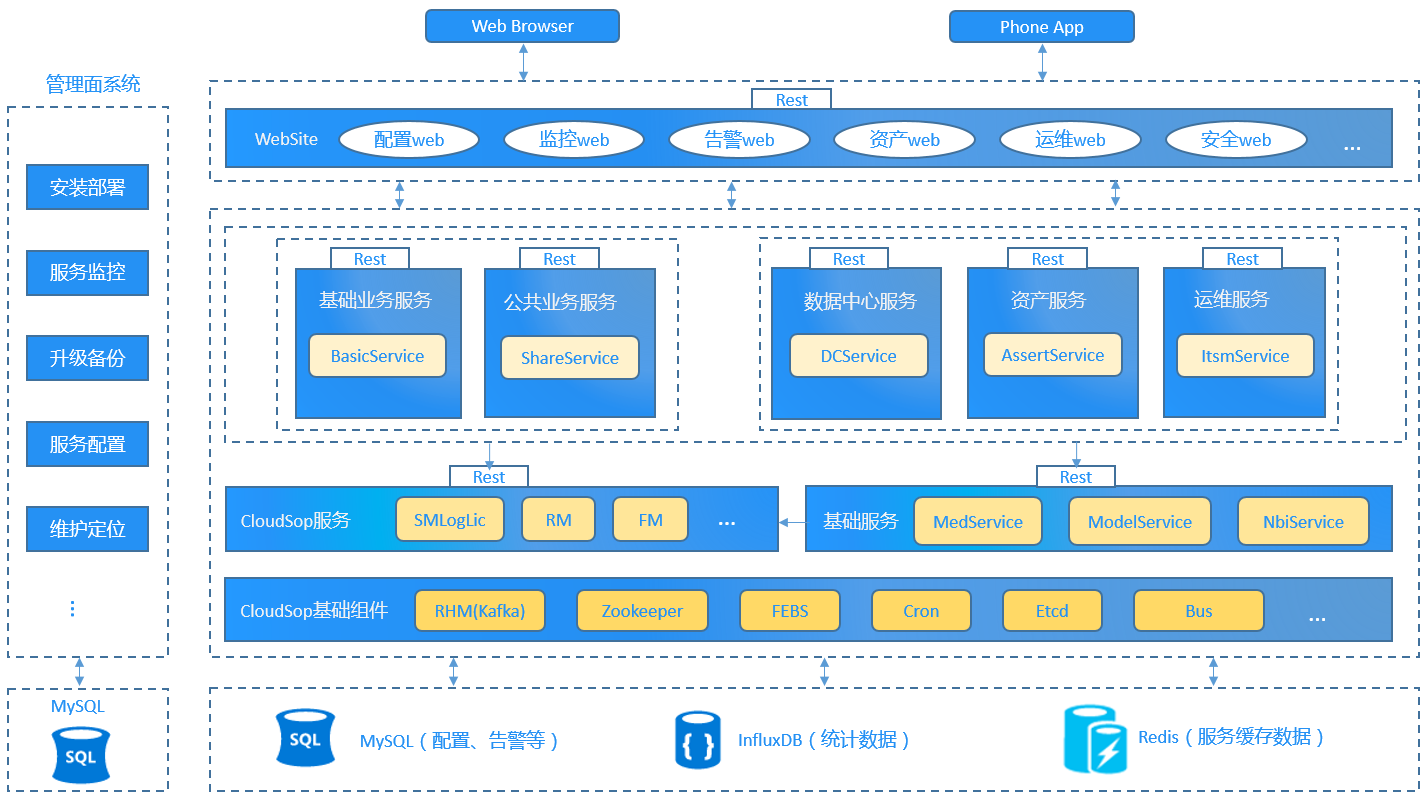

为什么在信息系统建设前需要进行系统规划?系统规划提供了机构信息化建设的基本纲领和总体指向。系统规划是工程项目实施的前提与依据。做好系统规划可避免盲目信息化建设给机构带来巨大的损失系统规划主要解决什么问题?根据组织机构使命及其战略目标,制定信息系统建设总体目标与愿景;针对组织机构信息化需求,确定信息系统总体框架、技术路线与实施方案:在充分考虑组织机构的技术、设备和人力资源等因素下,制定组织机构的信息

默认情况下,LlamaIndex 使用 OpenAI 的模型,然而由于 OpenAI 的网站在国内无法访问,故使用本地下载好的模型代替之。

金融科技理论与实践课程重要知识点整理,大部分答案均为豆包生成,仅供参考。侵删。

返回一个 1 维张量,包含在区间 start 和 end 上均匀间隔的 step 个点,默认左右均为闭区间, 输出 1 维张量的长度为steps。返回一个张量,包含了从标准正态分布(均值为 0,方差为 1)中抽取一组随机数,形状由可变参数 sizes 定义。返回一个张量,包含了从区间[0,1)的均匀分布中抽取的一组随机数,形状由可变参数sizes 定义。返回一个张量,包含从给定参数 means,s

默认情况下,LlamaIndex 使用 OpenAI 的模型,然而由于 OpenAI 的网站在国内无法访问,故使用本地下载好的模型代替之。

不使用 async。可以使用openai 库里面的 openai,也可以使用 Python 的 requests。首先定义 async_query_openai 函数,负责处理单个请求,返回单个结果。async_process_queries 接收一个请求列表,返回所有请求的结果列表。导入必要的库,其中 time 模块负责计算最后的时间,不需要的话可以不导入。,等待它完成,然后关闭事件循环。我使用

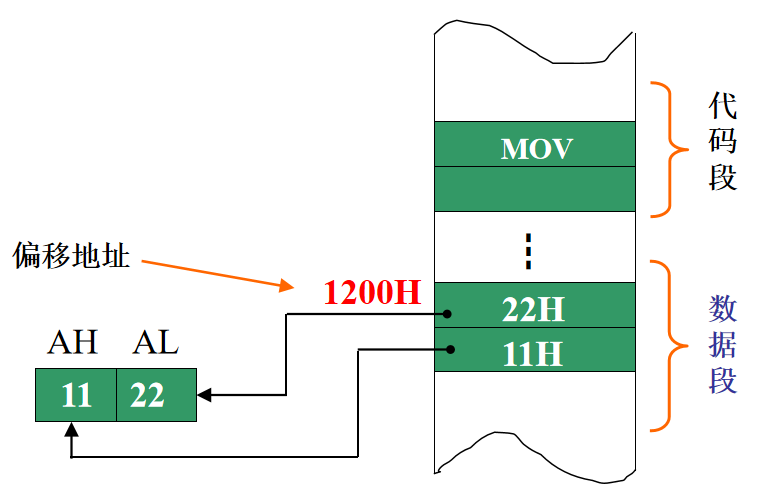

涵盖8086/8088内部寄存器类型,编址方式,与常见的汇编指令

操作系统期末考试总复习,此文章以简答题和知识点整理为主

操作系统考点整理与总结,覆盖课本前三章,方便考前复习

我们输入以下命令启动服务器,–model 为本地模型的路径,–served-model-name 是模型在服务器中的别名,这里我们取简称 openchat,其他都是默认值,当然也可以自己设置。在这里我们不演示了,直接将 vLLM 部署为模仿 OpenAI API 协议的服务器,这使得 vLLM 可以用作使用 OpenAI API 的应用程序的直接替代品。当然,你也可以试一试 ChatComplet