简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

为了防御后门攻击,以往的研究主要集中在使用干净数据在模型部署前去除后门攻击。在本文中,我们研究了利用测试时部分被污染的数据来去除模型中的后门的可能性。为了解决这个问题,我们提出了一种两阶段方法 TTBD。在第一阶段,我们提出了一种后门样本检测方法 DDP,用于从一批混合的、部分被污染的样本中识别出被污染的样本。一旦检测出被污染的样本,我们利用Shapley 估计来计算神经元的重要性贡献,定位受污染

机器学习从业者通常通过监控模型的某些指标来估计其泛化误差,并在训练数值收敛之前停止训练,以防止过拟合。通常,这种误差度量或任务相关的指标是通过一个验证集(holdout set)来计算的。因为这些数据没有直接用于更新模型参数,通常假设模型在验证集上的表现可以作为泛化误差的代理,只要验证集具有代表性,能够代表模型在推理时面对的数据。然而,如果验证集在超参数搜索中被重复使用,模型可能会对其过拟合。因此

高并发的哲学原理》(基本来自本书)《亿级流量系统架构设计与实战》

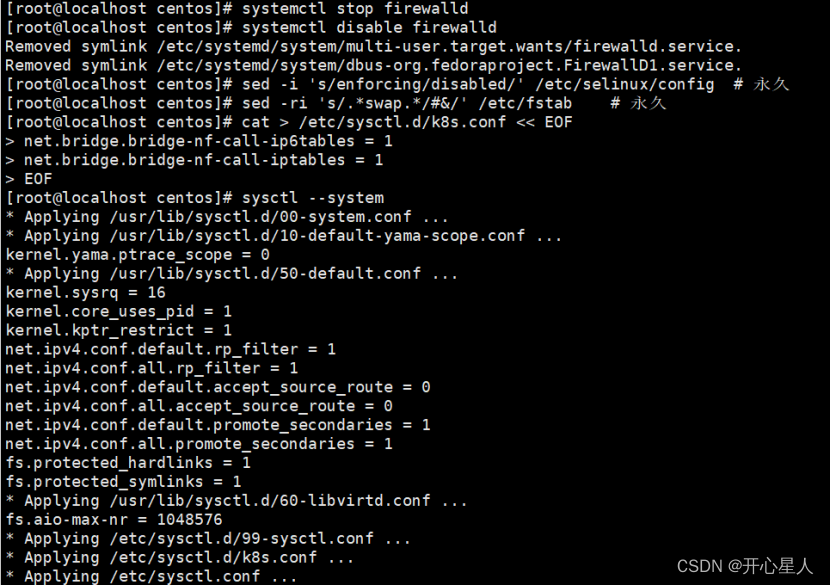

操作系统:centos7.9_x64K8s:1.23操作系统最小硬件配置(在vmmare安装时需要选择):2核CPU、2G内存、20G硬盘。

弄清楚计算机网络、万维网、因特网、互联网、互连网的概念

防火墙位于可信和不可信网络之间,通过设置一系列安全规则对两个网络之间的通信数据包进行访问控制,检测网络交换的信息,防止对重要信息资源的非法存取和访问,以达到保护内部可信网络的目的。防火墙一般部署在网络边界,以对可信的内部网络和不可信的internet外网进行过滤和阻断。防火墙简单的可以用路由器、交换机实现,复杂的就要用一台计算机,甚至一组计算机实现。...

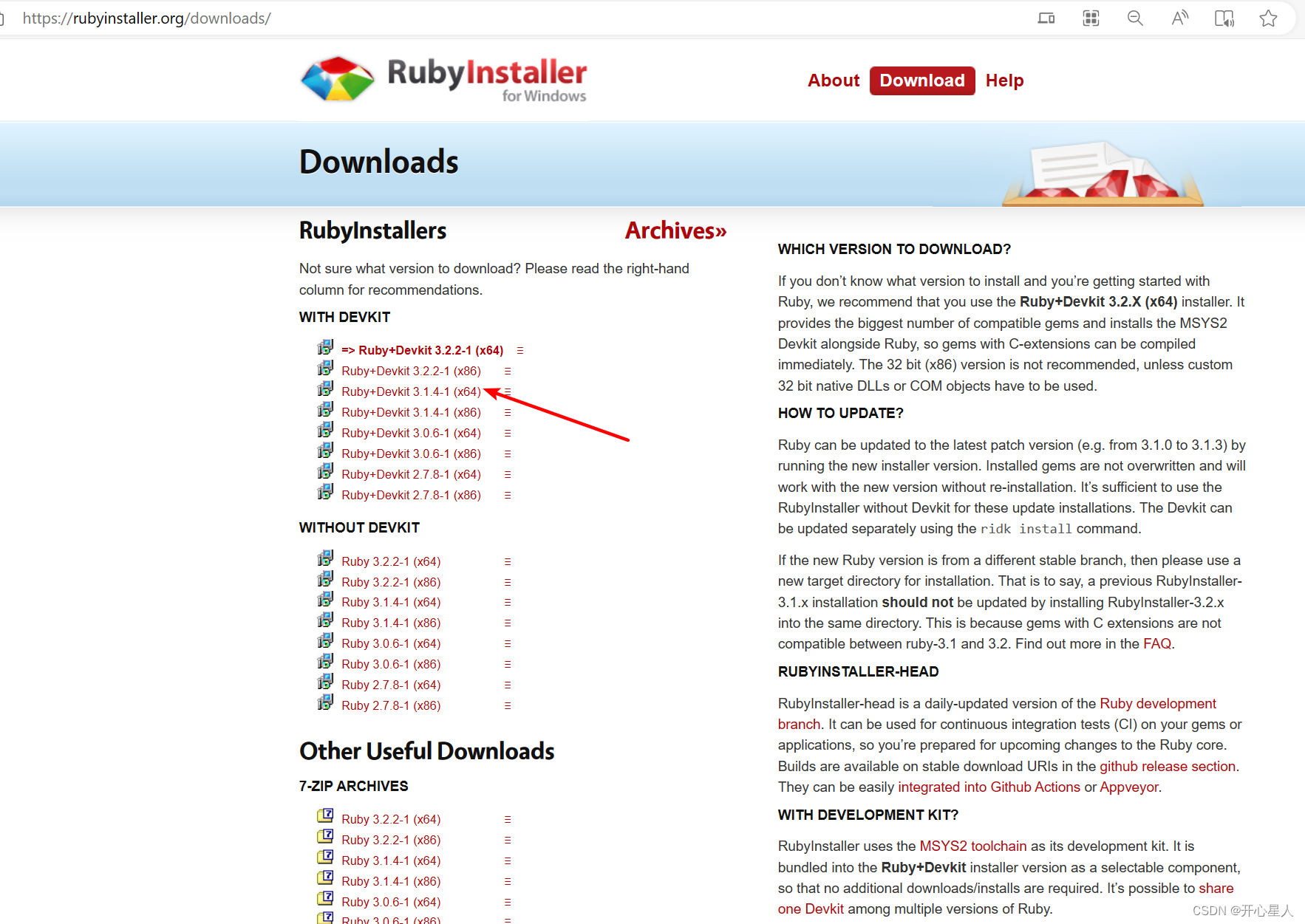

我在file1中,想跳转say_hello函数的定义,跳转不了。(如果执行不了,应该是环境变量没生效,重启vscode)现在可以跳转函数定义了,之后可以更好的研究msf源码了。遂下载真正的ruby ide。vscode插件市场安装ruby插件。新建一个目录,打开terminal。

虽然自然图像的空间具有复杂的拓扑结构,但可以通过同调群 Hk 的近似来更好地理解,其中前 k 个群形成对拓扑的 k 阶近似。通过对我们的数据进行归一化,近似中的零阶项 H0 被消除。然后,一阶项 H1 包含自然图像的最基本结构,即线性梯度。由于线性梯度通常由它们的角度参数化,而角度自然地被圆形结构所包含,所以我们拓扑的一阶近似是一个圆。Carlssons的工作实际上表明第一贝蒂数是3,这表明 H1

李宏毅深度学习笔记。

李宏毅深度学习笔记Transformer 是一个基于自注意力的序列到序列模型,与基于循环神经网络的序列到序列模型不同,其可以能够并行计算。