简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

做智能体最难的事情,并不是如何怎么学会做智能体,工具的学习往往是简单的,如何找到智能体真正有用的应用场景和业务需求才是核心能力。我们目前在各大智能体开发平台上的智能体,说实话,更多是玩具的属性。

这两年,AI越来越火,在生活和工作里到处都能看到它的影子。AI 智能体就像一个个超级能干的数字小帮手,能自己 “看” 懂各种信息,快速做出判断,还能帮我们完成各种复杂任务。不管是处理数据、写文案,还是安排工作流程,它们都能轻松搞定,大大提高了工作效率。

最近的学术文献中,大型语言模型(LLMs)在医疗领域展示出巨大潜力。例如,闭源模型如GPT-4和MedPalm-2表现卓越,并成功通过了美国医师执照考试(USMLE)。同时,开源模型如Llama 2也为医学专业语言模型的开发提供了支持,如MEDITRON、PMC-LLaMA、MedAlpaca和ChatDoctors等,逐渐缩小与闭源同行的性能差距。然而,这些精密医疗语言模型主要集中在英语应用上,

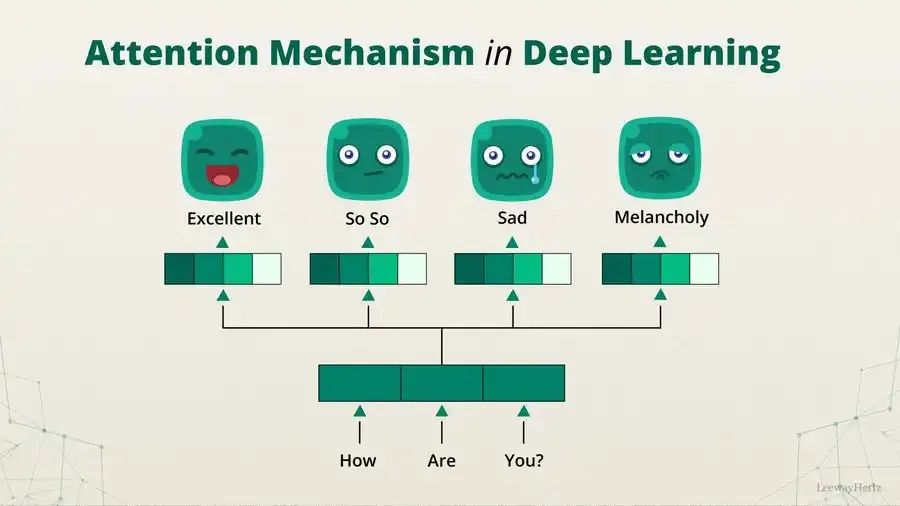

在深度学习中,注意力机制模仿了人类在处理信息时的选择性关注能力,允许模型在处理输入数据时动态地调整其注意力权重,从而突出重要信息并忽略不重要的信息。注意力机制通过计算查询向量(Query)、键向量(Key)之间的相似度来确定注意力权重,然后对值向量(Value)进行加权求和,得到最终的输出。Attention Mechanism一、注意力机制什么是注意力机制(Attention Mechanism

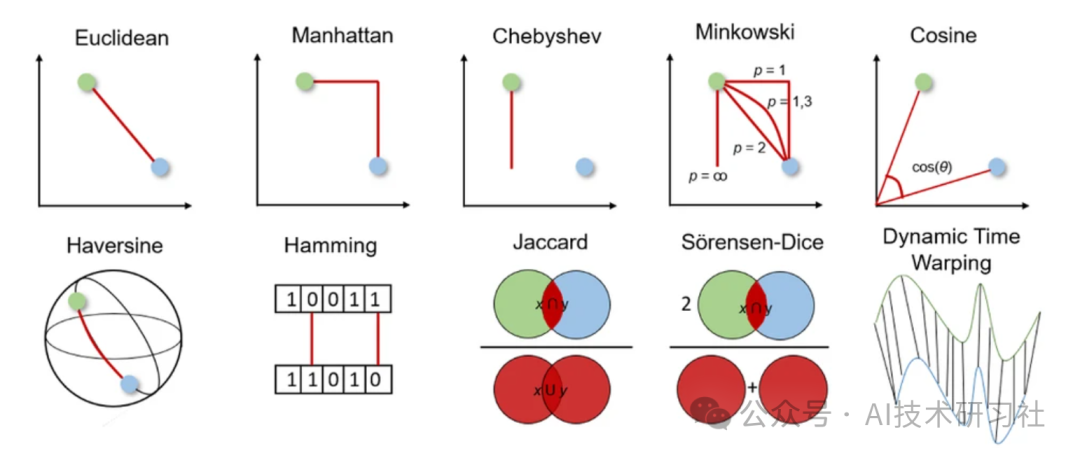

向量距离,也称为距离度量或相似度度量,是一种数学函数,用于量化两个向量之间的相似性或差异性。这些向量可以代表各种数据集,向量距离有助于理解向量在特征空间中的接近程度或远离程度。因此,向量距离在各种机器学习算法中至关重要,使这些算法能够基于向量之间的关系做出决策。对于距离的度量,我们可以在几何距离测量和统计距离测量之间进行选择,应该选择哪种距离度量取决于数据的类型。特征可能有不同的数据类型(例如,真

人工智能(AI)已从技术概念演变为驱动社会变革的核心引擎。无论是个人生活的便捷化、办公效率的指数级提升,还是企业管理和生产制造的颠覆性创新,AI技术正以前所未有的深度和广度重塑各行各业。本文将深入挖掘AI在不同细分场景中的具体应用,展现智能化革命的完整图景。

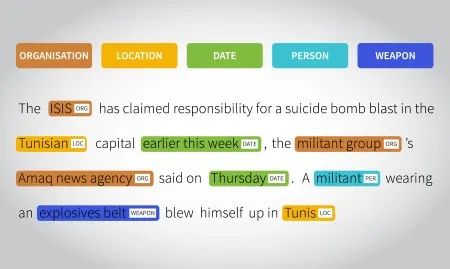

数据标注是对数据进行归因、标记或标记的过程,以帮助机器学习算法理解和分类它们处理的信息。此过程对于训练AI模型至关重要,使它们能够准确理解各种数据类型,例如图像、音频文件、视频片段或文本。数据标注工具是一种专用软件平台,可帮助组织对机器学习训练的原始数据进行注释、标记和分类。这些工具通过添加有意义的标签、分类或注释,帮助将非结构化数据(如图像、文本、视频或音频)转换为结构化的带标签的数据集。可以将

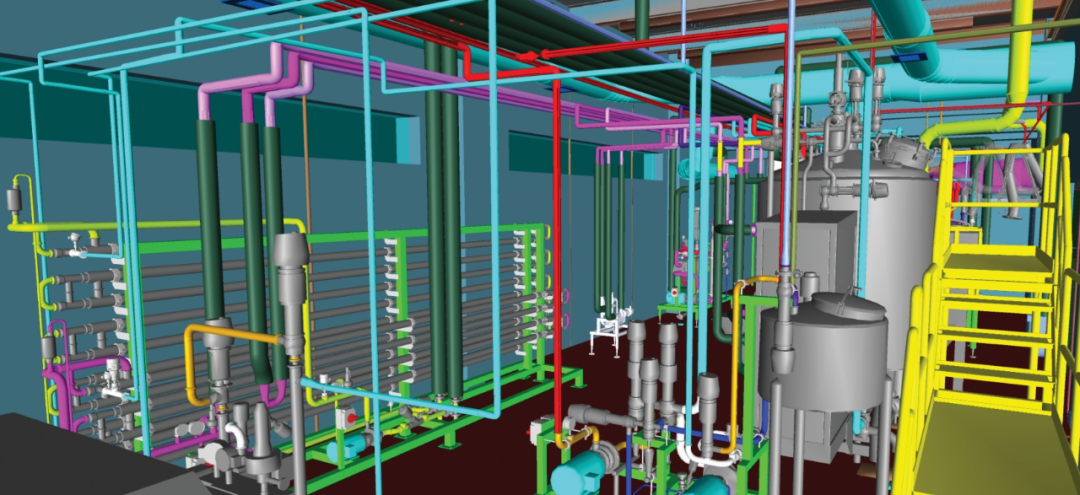

鉴于人工智能(AI)技术对工业领域的影响日益加深,来自国际自动化学会(ISA)的专家们分享了对于“AI在过程控制中应用”这一趋势的看法。本文节选自ISA“咨询自动化专业人士”系列问答。自 1990 年代中期以来,神经网络已经成功应用于一个特定的行业——聚合物。需要指出的是,他们使用了基于 Wiener 结构的混合建模方法,即线性动力学,非线性静态部分使用神经网络建模。这些工业应用程序明确处理了其训

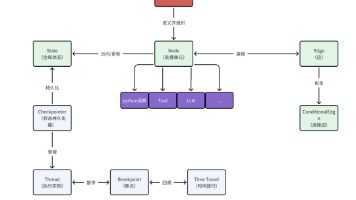

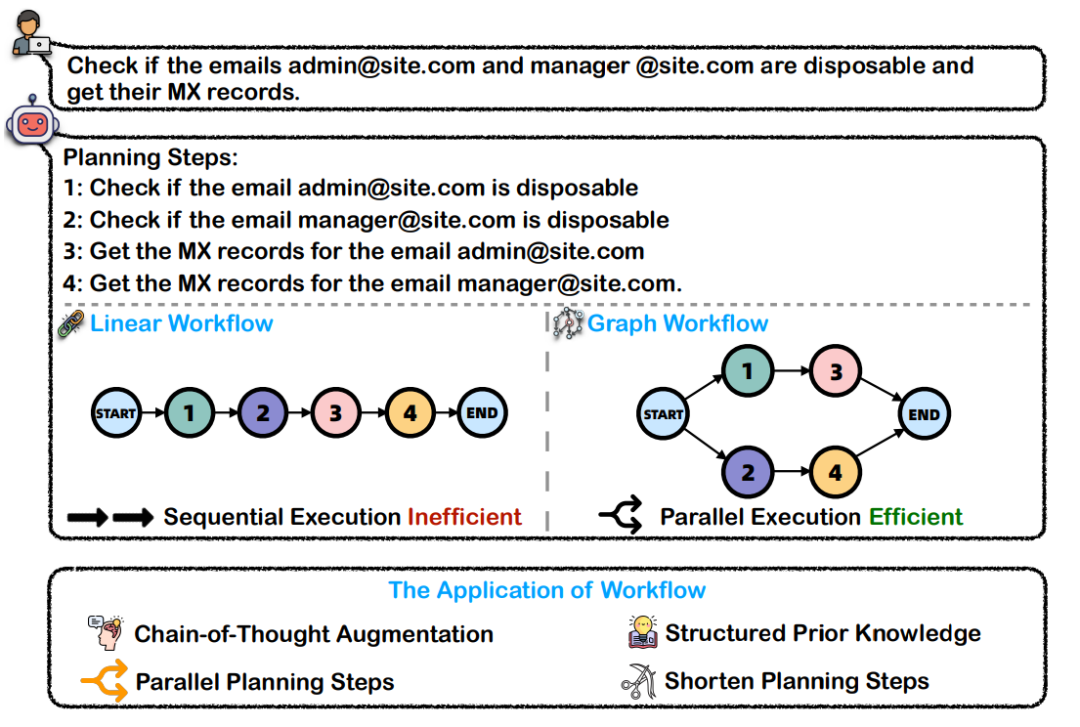

是大模型智能体的核心能力,广泛应用于大模型的多工具调用、具身智能场景中的复杂任务拆解和多机器人协同、复杂问题的求解、医学场景中的疑难杂症诊断分析,AI for Science中的实验方案设计等。相较于普通的推理能力,规划更加依赖于结构化思维建模(Structure Thinking),而非单一的线性思维过程。研究表明,目前的大模型在规划能力上仍有显著不足,尤其在处理图结构类型的工作流任务时表现薄弱

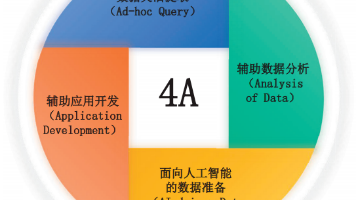

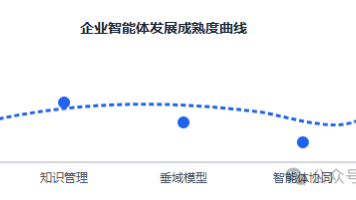

随着人工智能技术的快速发展,各行各业不断推进数字化转型和智能化发展。2025年全国两会《政府工作报告》指出要“激发数字经济创新活力,持续推进‘人工智能+’行动,将数字技术与制造优势、市场优势更好结合起来,支持大模型广泛应用”,“加快完善数据基础制度,深化数据资源开发利用”。本文探索将大模型与大数据技术相融合,面向商业银行数字金融场景,应用大模型NL2SQL技术,在数据灵活提取、辅助数据分析、面向人