简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

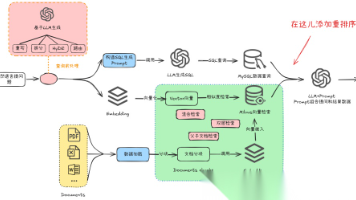

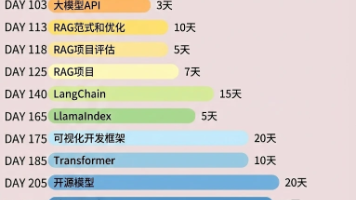

前面几篇文章分别介绍了 Spring AI 和 LangChain4j 在 RAG 文档处理各环节的支持——文档读取、解析、分段、清洗、元数据加工。本文将这些知识点汇总到一个完整的对比框架中,以《仙逆》知识库构建为参考场景,帮助你在项目起始阶段快速判断哪个框架更适合团队的技术栈和需求。

你有没有做过 RAG,结果发现 AI 的回答明显在"猜"?你的文档明明写得很清楚,但 AI 检索回来的总是不相关的片段——语义上相似,但逻辑上答非所问。你开始调 embedding 模型,换向量数据库,调 chunk size,调 top-k,折腾一周,准确率还是卡在 60-70%。

每一个答案的背后,都有证据支撑。在搜索系统里,这些证据通常来自文档——标题、摘要、片段(snippet)——然后打包送给下游的答案模型或智能体去处理。

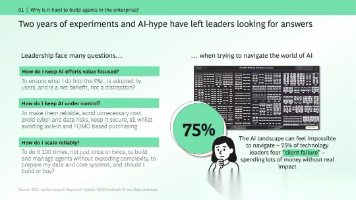

前面几篇,我们已经把一个核心判断讲清楚了:2026 年之后,企业做 AI Agent,真正比拼的不是谁模型更会说,而是谁更能交付结果。

过去的2025年,AI Agent无疑是企业技术领域最热的话题。2026年,热度有增无减。但绝大多数关于Agent的讨论要么停留在理论层面,要么忽视了企业环境的真实复杂性——老旧的技术栈、混乱的数据、多国合规要求、复杂的治理体系。

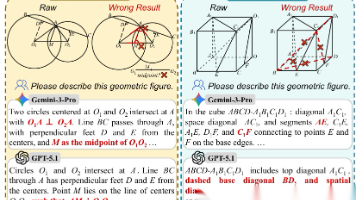

尽管多模态大语言模型 (MLLMs) 在诸多领域取得了显著进展,但在**几何推理**方面仍面临挑战,其主要瓶颈在于对细粒度视觉元素的**感知能力不足**。虽然以往的形式化语言有助于理解平面几何,但需要复杂空间理解能力的**立体几何 (Solid Geometry)** 领域仍未被充分探索。 为解决这一问题,本文设计了一种**统一的形式化语言**,将平面与立体几何相融合,全面覆盖了几何结构与语义关系

你有没有见过这种AI:让它做点事,它一顿操作猛如虎,结果发现把事情搞砸了。该查的资料没查,该用的工具没用,顺序乱七八糟,最后还振振有词:"我已经完成了任务。"

Gartner 预测:2026 年底,40% 的企业应用将内置 Agent。而去年,这个数字还不到 5%。渗透率飙升的背后,是一个更严肃的问题:不是“能不能做”,而是“怎么做才稳定、怎么跑才安全、怎么管才不乱”。从“调 API 玩票”到“企业级 Agent 稳定运行”,中间隔着4个真实的工程问题。这些问题相信每一个企业都绕不开。 6月26-27日,**AICon全球人工智能开发与应用大会·上海站*

这半年,AI 圈最热的词,除了大模型,几乎就是 Agent。有人说,Agent 才是 AI 真正落地的开始;有人说,大模型只是“大脑”,Agent 才是“手脚”;