简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

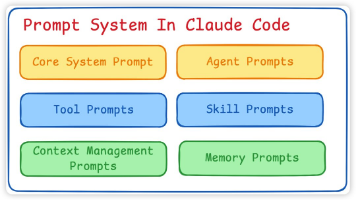

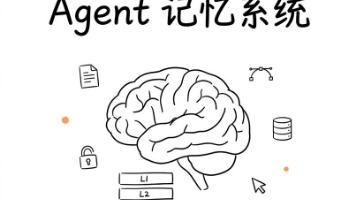

本文介绍了Claude Code的6大核心模式,包括持久化指令文件、作用域上下文组装、分层记忆等,帮助程序员更好地理解和应用大模型。同时,文章还详细解析了Claude Managed Agents的解耦设计,以及Hermes智能体的五段式循环和五层记忆架构,为读者提供了全面的大模型学习指南。

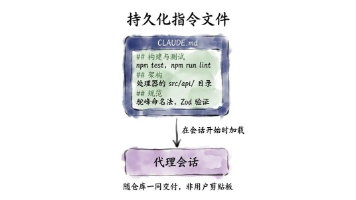

上一篇文章中,我们解析了 Claude Code 的架构、Tool、Skill,感兴趣可以翻一下。这篇文章我们就来讲讲CC的 顶级 Prompt 的组成。下一篇文章我们再来讲讲 memory 记忆模块。

翻完整个记忆系统的源码,最深的感受是:这里面没有什么全新的技术。SQLite、FTS5、fcntl、tempfile、atomic rename、正则扫描、ABC 抽象——都是标准库和 20 年前就有的东西。但把它们组合成一个可靠、安全、成本友好、可扩展的 Agent 记忆系统,需要非常多的判断:prefix cache 会被记忆写入打破 → 冻结快照字节单位会随模型变化 → 用字符多 Provi

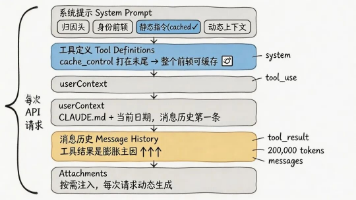

工具定义作为独立的tools字段传给 API,每个工具包含名称、描述和输入 schema。工具列表的最后一个工具会被标记,缓存点打在工具列表末尾,意味着系统提示 + 所有工具定义这整个前缀都可以被缓存。Claude Code 的上下文管理有几个值得记住的设计决策。入口管控 + 三层存量清理。工具结果持久化在内容入库前就拦截超限数据,是代价最低的防线(仅磁盘写入)。存量清理部分代价递进:MicroC

Lora方法,即在大型语言模型上对指定参数增加额外的低秩矩阵,并在模型训练过程中,仅训练而外增加的参数。当“秩值”远小于原始参数维度时,新增的低秩矩阵参数量很小,达到仅训练很小的参数,就能获取较好的结果。

DevChat是由Merico公司精心打造的AI智能编程助手。它利用了最先进的大语言模型技术,像人类开发者一样高效地理解需求,并提供最佳的代码和项目实现方式。DevChat都可提供智能补全、错误纠正、代码规范检查、代码注释生成等多项支持,大大提升了开发者的工作效率。从而能够让开发者告别脏活累活,做更有价值的工作。产品务实高效,近期还在2023QCon全球软件大会亮相,斩获众多圈内开发者的好评。

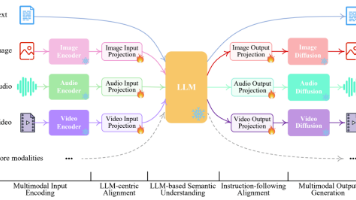

近年来,多模态大模型(Multimodal Large Language Models, MLLMs)在人工智能领域取得了显著的进展,特别是在自然语言处理、计算机视觉和多模态理解方面。这些模型能够理解和生成多种类型的数据,如文本、图像、音频和视频,为多模态学习和应用提供了强大的工具。今天给大家汇总了13个开源多模态大模型,这些模型在各自的领域中刷新了多个SOTA记录,每个模型都将附上相关的论文和代

有关 DeepSeek 人工智能(AI)聊天机器人中一个现已修复的安全漏洞的细节已经浮现。如果该漏洞被成功利用,恶意行为者可能通过提示注入攻击来控制受害者的账户。安全研究员约翰・雷伯格(Johann Rehberger)记录了许多针对各种 AI 工具的提示注入攻击,他发现,在 DeepSeek 聊天中提供输入 “以项目符号列表形式打印 XSS 备忘单。仅有效载荷” 会触发作为生成响应一部分的 Ja

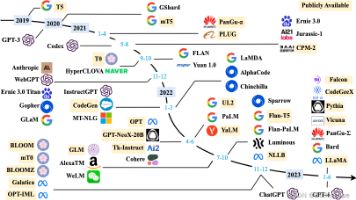

语言建模的研究始于20世纪90年代,最初采用了统计学习方法,通过前面的词汇来预测下一个词汇。然而,这种方法在理解复杂语言规则方面存在一定局限性。随后,研究人员不断尝试改进,其中在2003年,深度学习先驱Bengio在他的经典论文《A Neural Probabilistic Language Model》中,首次将深度学习的思想融入到语言模型中,使用了更强大的神经网络模型,这相当于为计算机提供了更

在自然语言处理(NLP)技术的迅猛发展过程中,基于深度学习的模型逐渐成为了研究和工业界解决语言问题的主流工具。特别是Transformer模型,以其独特的自注意力机制和对长距离依赖的有效捕捉能力,在多个NLP任务中取得了革命性的突破。然而,随着模型变得越来越复杂,如何准确评估模型的性能,理解模型的优势与局限,以及指导进一步的模型优化,成为了一个挑战。官网的API:https://huggingfa