简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

DeerFlow 2.0 Lead Agent 与 Prompt 工程解析 本文深入剖析了DeerFlow 2.0的Lead Agent架构与Prompt工程实现。主要内容包括: Lead Agent创建流程:采用工厂模式构建,包含模型名称三级回退机制(请求参数>Agent配置>全局默认)和特殊的Bootstrap Agent用于初始化。 动态Prompt构建:System Promp

文章摘要: DeerFlow 2.0是字节跳动开源的SuperAgent框架,基于LangGraph+LangChain构建,完全重写了V1版本。该框架提供完整的Agent运行时环境,包含9层中间件、SubAgent并发引擎、沙盒隔离、技能系统等核心组件。项目采用前后端分离架构,后端Python实现核心框架(包含Lead Agent、中间件管线、记忆系统等),前端使用Next.js。核心创新点包括

2026 年 4 月,AI 圈经历了"史上最疯狂一周"——OpenAI 发布 GPT-5.5,DeepSeek 开源 V4,Claude Opus 4.7 上线,Gemini 3.1 Pro 更新。但最值得关注的数据不是某个模型的 benchmark 分数,而是一个数字:**0.3%**。根据 Introl 的评测,开源模型(DeepSeek V4、Qwen 3.6、Llama 4)与闭源模型(G

2026 年 4 月,AI 圈经历了"史上最疯狂一周"——OpenAI 发布 GPT-5.5,DeepSeek 开源 V4,Claude Opus 4.7 上线,Gemini 3.1 Pro 更新。但最值得关注的数据不是某个模型的 benchmark 分数,而是一个数字:**0.3%**。根据 Introl 的评测,开源模型(DeepSeek V4、Qwen 3.6、Llama 4)与闭源模型(G

DeepSeek 版 Claude Code 以 1/15 的价格提供接近 Claude 99% 的编码体验。文章对比了三种实现路径:Claude Code + DeepSeek API(5分钟快速搭建)、开源替代 OpenCode + DeepSeek,以及 Git 原生工具 Aider + DeepSeek。数据显示 DeepSeek V4-Pro 在 SWE-bench 上仅比 Claude

DeepSeek 版 Claude Code 以 1/15 的价格提供接近 Claude 99% 的编码体验。文章对比了三种实现路径:Claude Code + DeepSeek API(5分钟快速搭建)、开源替代 OpenCode + DeepSeek,以及 Git 原生工具 Aider + DeepSeek。数据显示 DeepSeek V4-Pro 在 SWE-bench 上仅比 Claude

2026 年 4 月 Anthropic 在 Claude Code 2026.4 版本中,正式推出的CC Switch(全称 Claude Code Switch) 功能,就是为了彻底解决这些问题而生。它是基于 MCP 协议原生打造的一站式无缝切换引擎,实现了「模型、项目上下文、开发环境、Agent 角色、Skills 套件、云资源」的一键切换,无需重开窗口、无需重复配置、不会丢失上下文,真正实

很多人对 Token Plan 的理解停留在 “选一个 API 计费套餐”,但本质上,Token Plan 是一套覆盖「配额规划、计费选型、API 运行时管控、成本优化、风险兜底」的全生命周期管理体系,是大模型 API 从 “Demo 能用” 到 “生产稳定” 的核心门槛,也是决定 AI 应用能否盈利的关键。完整拆解 Token Plan 的底层逻辑、核心模块、API 实战与避坑指南。

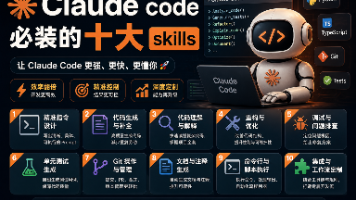

2026 年,Andrej Karpathy 提出的Agentic Engineering(智能体工程) 已经成为 AI 编程的行业主流,而 Claude Code 凭借原生的多智能体协同、全流程自主执行能力,已经超越 Cursor、Windsurf 等工具,成为百万开发者的首选 AI 编程平台。但绝大多数人用 Claude Code,只用到了它最基础的代码生成能力 —— 本质上还是升级版的 Vi

摘要: Anthropic研究表明,负面Prompt会显著降低AI性能。辱骂性指令导致模型核心能力下降50%以上,代码生成通过率从84.7%暴跌至32.4%。原理在于负面情绪挤占注意力带宽、触发安全防御机制、污染语义分布。实战对比显示,正向引导Prompt的代码通过率达92%,而负面Prompt仅28%。正确交互方式包括:使用中性明确指令、精准错误反馈、正向激励、分步拆解任务,必要时重置会话。行业