简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本视频完整演示如何用 Bright Data ChatGPT Scraper 批量抓取 ChatGPT 真实推荐数据 + 自动生成 AI 选品情报报告,控制台无代码 + API 两种用法全覆盖,半天搭完一套月度自动跑、零人工值守的监控系统。海外消费者的选品入口正在从"搜索"迁移到"问 AI"——Helium 10、Jungle Scout 这类传统选品工具看不到这一块,而它正以肉眼可见的速度变成新

摘要:本文记录了基于魔珐星云平台快速搭建3D数字人面试官的完整实践过程。通过轻量化具身技术,将纯文本AI面试官升级为具备表情、动作和思考神态的3D交互形象,显著提升了面试场景的真实感和沉浸感。文章详细介绍了从注册账号、创建应用到代码实现的每个步骤,重点展示了如何通过参数流架构实现低延迟、高并发的实时交互,以及如何对接大模型实现智能追问功能。实践表明,具身数字人相比纯文本交互能带来更自然的沟通体验,

摘要:本文记录了基于魔珐星云平台快速搭建3D数字人面试官的完整实践过程。通过轻量化具身技术,将纯文本AI面试官升级为具备表情、动作和思考神态的3D交互形象,显著提升了面试场景的真实感和沉浸感。文章详细介绍了从注册账号、创建应用到代码实现的每个步骤,重点展示了如何通过参数流架构实现低延迟、高并发的实时交互,以及如何对接大模型实现智能追问功能。实践表明,具身数字人相比纯文本交互能带来更自然的沟通体验,

摘要:本文记录了基于魔珐星云平台快速搭建3D数字人面试官的完整实践过程。通过轻量化具身技术,将纯文本AI面试官升级为具备表情、动作和思考神态的3D交互形象,显著提升了面试场景的真实感和沉浸感。文章详细介绍了从注册账号、创建应用到代码实现的每个步骤,重点展示了如何通过参数流架构实现低延迟、高并发的实时交互,以及如何对接大模型实现智能追问功能。实践表明,具身数字人相比纯文本交互能带来更自然的沟通体验,

本文记录了基于RokidAIGlasses开发名片记忆助手智能体的全过程。首先分析了AR眼镜行业背景及设备能力,针对商务社交场景中的人脉记忆痛点,确立了"社交记忆增强系统"的产品定位。技术实现上采用灵珠平台的三模块架构:通过表格知识库存储结构化联系人数据,Prompt工程约束模型行为,工作流引擎实现多步骤交互。重点阐述了数据建模原则、Prompt调优策略及工作流节点设计,并演示

本文记录了基于RokidAIGlasses开发名片记忆助手智能体的全过程。首先分析了AR眼镜行业背景及设备能力,针对商务社交场景中的人脉记忆痛点,确立了"社交记忆增强系统"的产品定位。技术实现上采用灵珠平台的三模块架构:通过表格知识库存储结构化联系人数据,Prompt工程约束模型行为,工作流引擎实现多步骤交互。重点阐述了数据建模原则、Prompt调优策略及工作流节点设计,并演示

摘要:本文介绍了基于ModelEngine平台构建智能医疗问答系统的实践过程。作者通过整合公开医学数据库、专业书籍和权威网站内容,建立了结构化医学知识库,并利用ModelEngine的低代码工作流功能设计了包含输入分析、知识检索和智能回复的完整问答流程。该系统能够根据用户描述的症状提供个性化医疗建议,解决了传统健康咨询平台信息基础、缺乏精准性的问题。未来计划扩展语音识别、图像分析和远程医疗集成功能

Redis是一个完全开源免费的高性能(NOSQL)的key-value数据库。它遵守BSD协议,使用ANSI C语言编写,并支持网络和持久化。Redis拥有极高的性能,每秒可以进行11万次的读取操作和8.1万次的写入操作。它支持丰富的数据类型,包括String、Hash、List、Set和Ordered Set,并且所有的操作都是原子性的。此外,Redis还提供了多种特性,如发布/订阅、通知、ke

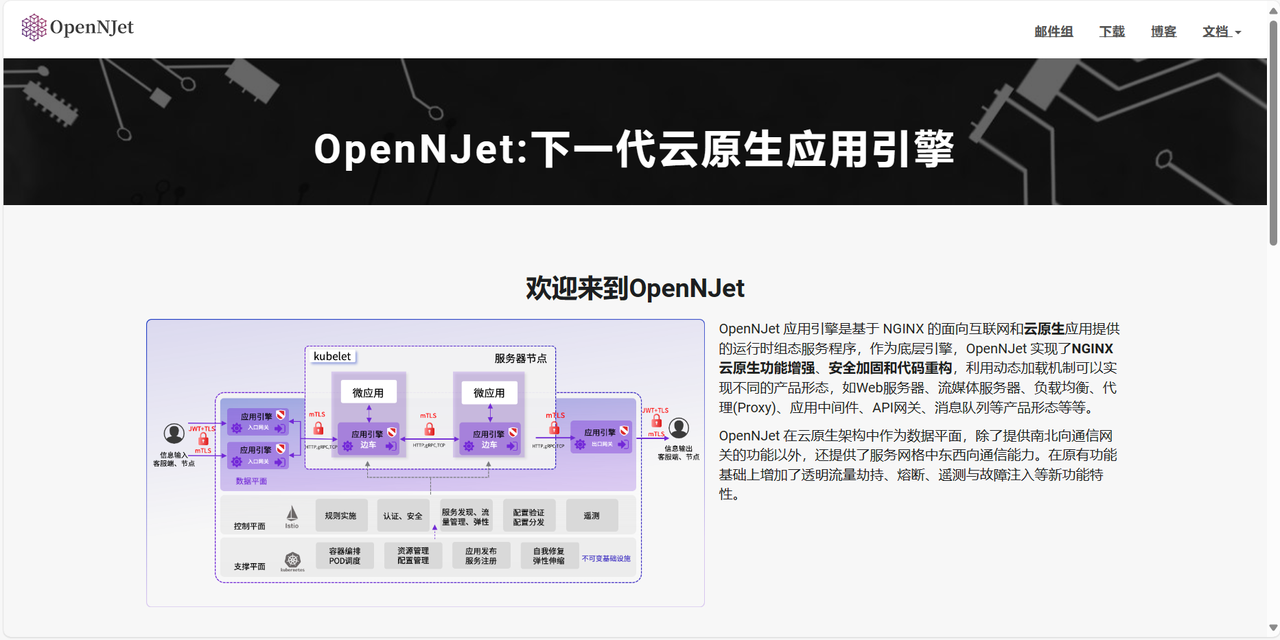

OpenNJet 应用引擎是基于 NGINX 的面向互联网和云原生应用提供的运行时组态服务程序,作为底层引擎,OpenNJet 实现了 NGINX 云原生功能增强、安全加固和代码重构,利用动态加载机制可以实现不同的产品形态,如 Web 服务器、流媒体服务器、负载均衡、代理 (Proxy)、应用中间件、API 网关、消息队列等产品形态等等。OpenNJet正是在这样的背景下应运而生,它不仅继承了NG

当电商平台上演盛大的购物狂欢时,如双十一、双十二,我们常常面临着选择困难症:琳琅满目的商品使我们不知所措,而一旦选定了心仪的商品,看到价格后却可能望而却步。面对这种情况,很多人渴望能够享受到各种优惠,比如大额满减和优惠券,然而通常情况下,这些优惠券抢购的竞争激烈,一般人难以抢到。不过,别担心!今天我将分享如何利用Python实现零成本抢购优惠券,帮助你在电商狂潮中脱颖而出。通过这个方法,你将有机会