简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

实体对齐是信息融合与数据集成领域的核心技术,旨在识别并关联不同图数据中指向现实世界同一对象的等价实体节点。这一技术在构建大规模统一知识库、支撑智能化语义搜索以及提升推荐系统精准度等国家大数据战略需求中具有重要的应用价值。然而,随着多源图数据规模的持续扩张,实体对齐任务面临图结构高度异构、语义信息复杂多样带来的严峻挑战。具体而言,不同图数据通常由不同机构独立构建,其构建背景与业务需求各异,导致其拓扑

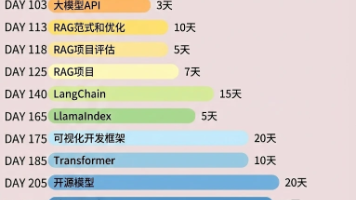

2020 年,Google 的 Lewis 等人发表了一篇里程碑式的论文 *Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks*,正式提出了 RAG 框架。其核心思想极其朴素:**让大语言模型在生成回答之前,先从外部知识库中检索相关文档,以此作为生成的依据。

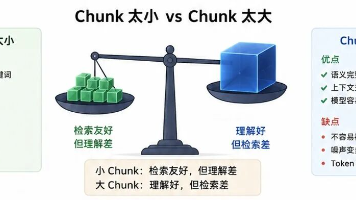

很多人在做 RAG 时,会把精力放在:* 模型选型* Prompt 优化* Rerank

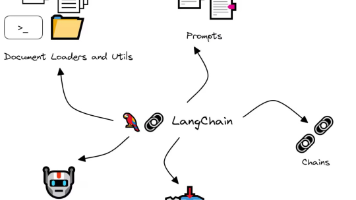

前面讲了那么多理论,这一篇来点实战。怎么用框架快速搭一个Agent?目前最流行的两个框架是**LangChain**和**LangGraph**。LangChain适合快速上手,LangGraph适合复杂工作流。这篇先讲LangChain,下一篇再对比LangGraph。

LangChain 是一个强大的开源框架,专门用于开发基于大语言模型(LLMs)的应用程序。它的核心目标是简化 LLM 应用的开发流程,提供了一套完整的工具链和组件抽象,使开发者能够高效构建复杂的 AI 应用。

最近后台私信集中在两个问题上:一个是「Hermes Agent 太费 token 了」。对话一长、工具一多,账单涨得比进度还快,很多人刚把流程跑通,就开始心疼 API 费用。另一个更现实:「我的环境根本不能连外网」。在公司内网、实验室隔离网、甚至某些政企/金融场景里,能不能用、合不合规,第一道门槛就是离线可用、数据不出网。

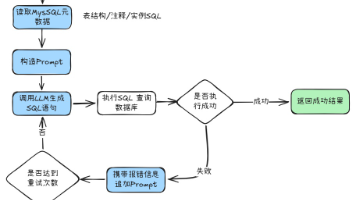

文本转`SQL`通俗的来说,就是用户输入自然语言,通过`LLM`大语言模型将自然语言结合表结构生成`SQL`的过程。

面试官提问"5000 万向量换 embedding,停服重跑吗?"腾讯索引迁移面。候选人答了三分钟,方向是"晚上停服全量重跑 embedding"。面试官追了一句:"出问题怎么回滚?"候选人卡住了。这道题看似在问迁移步骤,**实际在考你能不能区分"原地升级"和"新索引切读"——前者根本回不去,后者出事能秒退**。

最近在折腾本地 Agent 栈,想搞清楚一件事:到底能不能不依赖任何云端 API,在自己笔记本上把一套完整的 Agent 系统跑起来?答案是可以的,而且比想象中干净很多。

一文搞懂 PPO、DPO、GRPO、KTO、ORPO 的核心原理与区别