简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

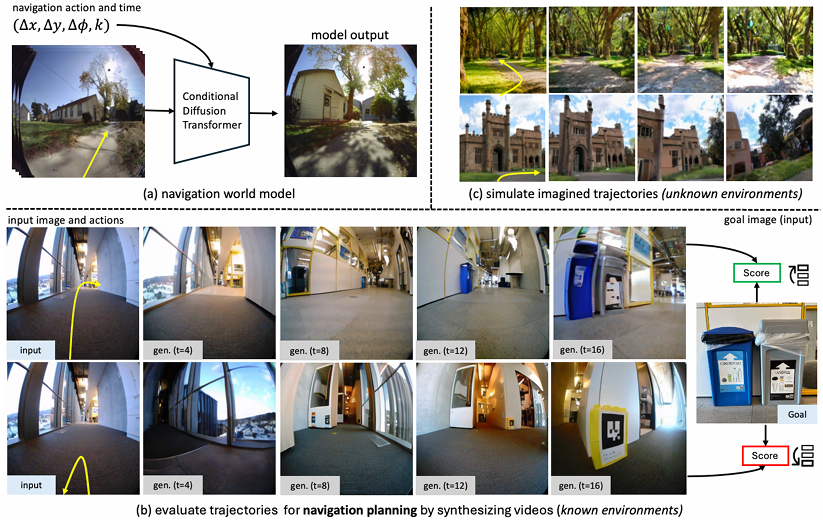

本文提出的导航世界模型(NWM)通过条件扩散Transformer(CDiT)实现了在大规模数据上的高效训练,并在导航任务中表现出色。NWM不仅能够独立规划导航轨迹,还能通过与现有导航策略结合来提升性能。此外,通过在未标记数据上进行训练,NWM在未知环境中的表现也得到了显著改善。

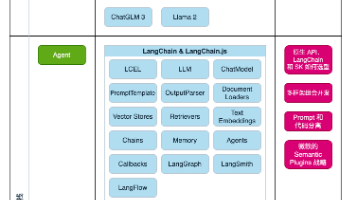

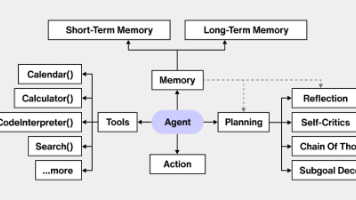

AI 智能体现在能做的事情真的很厉害,可以思考、规划,还能执行各种复杂任务,而且代码量并不大。这让开发者看到了一个机会:把那些庞大复杂的代码库和 API 拆解成更实用的模块。

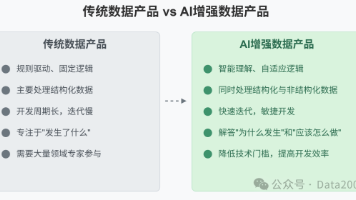

传统数据产品主要依赖规则、统计算法和经典机器学习模型,需要大量人工干预和领域专家来进行开发,并且具有固定的逻辑和数据处理能力,对复杂业务场景适应性普遍较差。

大语言模型取得突破性进展之后,AI Agent已然成为最具变革性的核心概念,其所涵盖的领域极为广泛且仍在不断演进。

数据准备充分:代码细致地处理了数据的加载、清洗、类型转换、特征提取(时间特征、利润)和异常值控制,为后续分析和建模奠定了坚实的基础。探索性分析深入:通过统计摘要和多种可视化手段(包括基础图表和高级图如 Chord 图、SHAP 图),脚本对数据进行了深入的探索,揭示了销售的关键模式、趋势、相关性以及不同维度(产品、时间、地区、人员)下的表现。建模流程规范:遵循标准的机器学习流程,包括特征编码、数据

随着人工智能的快速发展,检索增强生成(Retrieval-Augmented Generation,RAG)技术正在经历前所未有的演变。RAG技术通过将外部知识融入大型语言模型(LLM)的生成过程,极大地提高了AI系统的事实准确性和可靠性。如今,RAG正向更具智能性和自主性的方向发展,能够处理像超图这样的复杂结构,并适应各种专业领域的需求。本文将介绍11种最新的RAG类型,展示这一技术领域的创新前

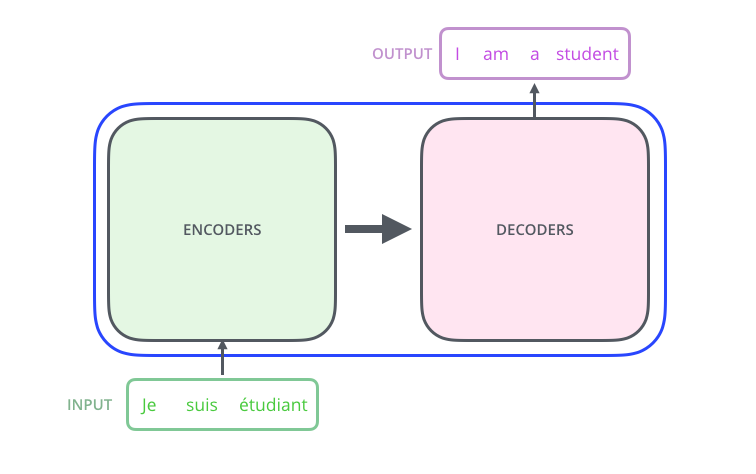

以前的文章中我介绍了 Attention —— 一种在现代深度学习模型中广泛使用的方法。Attention 的引入显著提升了神经机器翻译系统的性能。在这篇文章中,我们将进一步探讨 Transformer —— 一种以 Attention 为核心、加快训练速度的模型架构。Transformer 在某些任务中甚至超越了 Google Neural Machine Translation 模型。而 Tr

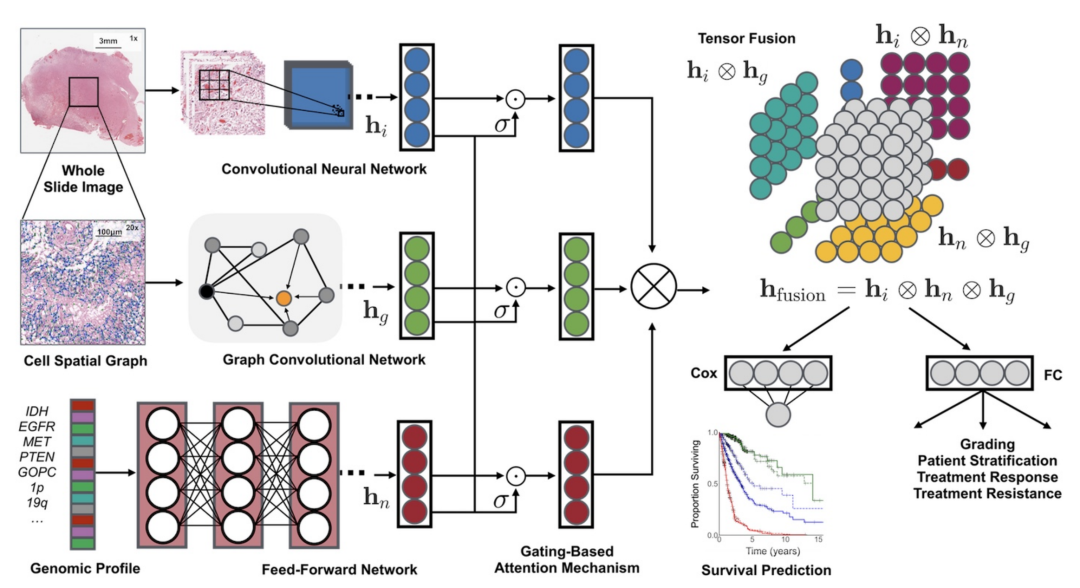

这篇文章提出了Pathomic Fusion这一创新框架,致力于解决现有方法的局限。传统上,癌症诊断依赖组织学与基因组数据,但组织学分析主观易变,基因组分析难以精准区分肿瘤与正常细胞特征,且****多数深度学习方法仅基于单一数据模态,未充分利用多模态数据互补信息****。文章详细阐述了Pathomic Fusion框架的构建与实现。Pathomic Fusion框架。

提出了一种深度学习框架(ETMIL-SSLViT),用于直接从EC和CRC患者的H&E染色WSIs中预测病理亚型和TMB状态,有助于病理分类和癌症治疗规划。

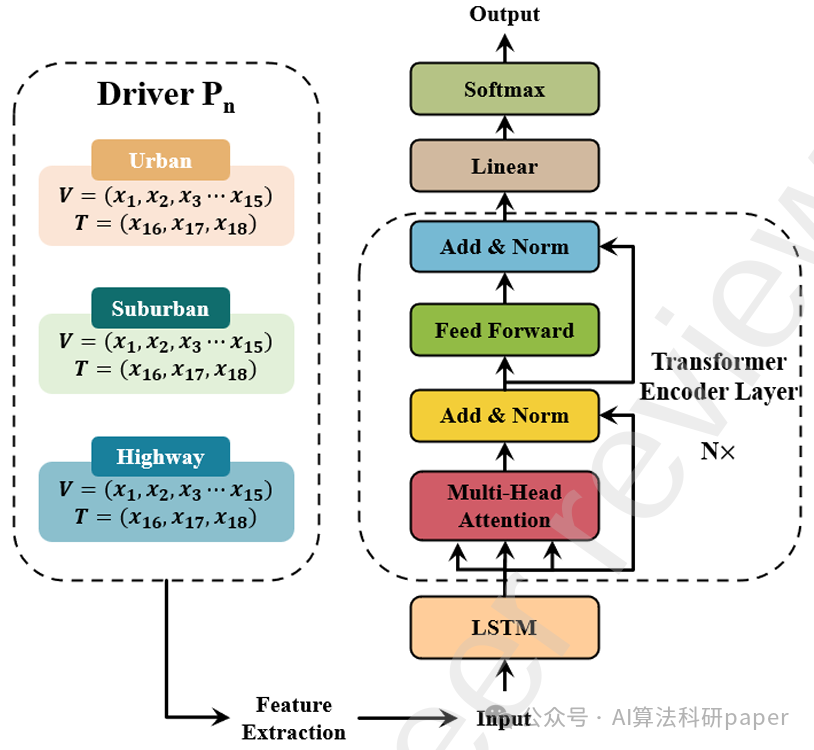

不仅巧妙融合了二者的优势,还构建了一个强大而灵活的预测框架,为我们处理复杂时间序列数据提供了更牛x的工具。这方向如今是深度学习领域的热门研究主题,前景非常可观,在工业物联网(如设备故障预警)、智慧城市(如交通流量预测)、生物医学、环境科学(如气象预测)等领域都有广泛应用。相关成果频繁发表于顶会顶刊,尤其是跨学科相关的。