简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

是 Apache Flink 中用于将数据流转换为 Kafka 记录(record)的序列化模式(Serialization Schema)。它允许将 Flink 数据流中的元素转换为 Kafka 生产者记录,并定义了如何序列化元素的逻辑。在 Flink 中,当你想要将数据发送到 Kafka 主题,需要一个序列化模式来将 Flink 数据流中的元素序列化为 Kafka 记录。而就是为此目的而设计的

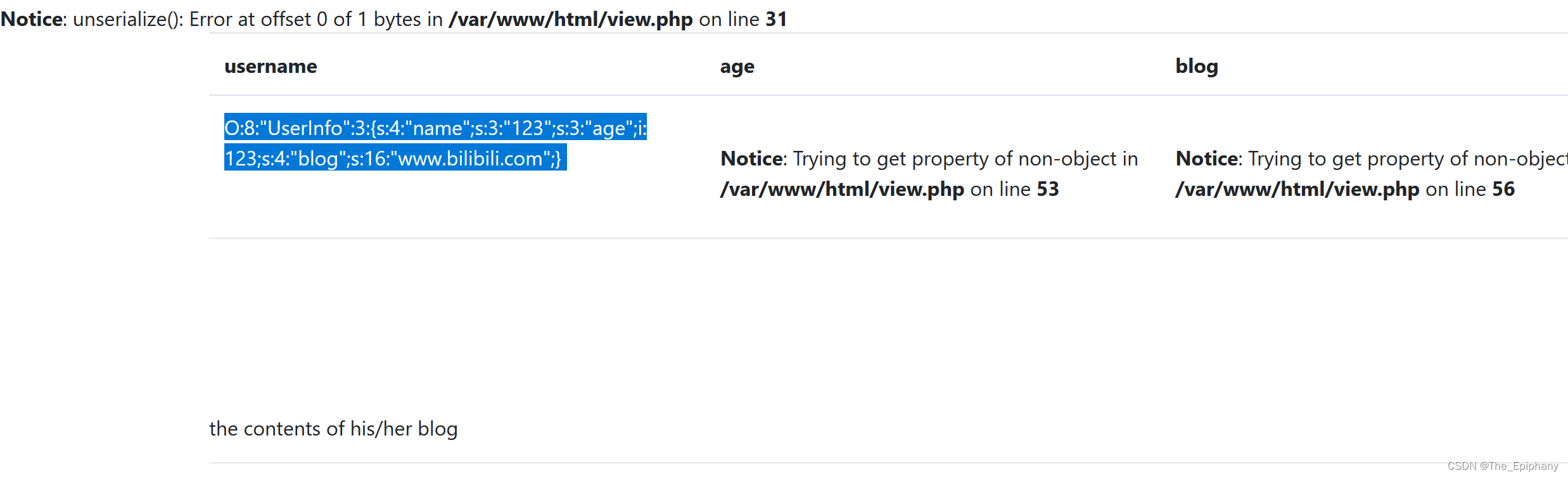

注意:序列化内容要在4号位置,这由column的顺序决定。

dataSet = pd.read_csv(‘dataSet.csv’, header=None).values.T# 转置 5*15数组。return -np.sum([p * np.log2§ for p in probability_lst])# 返回信息熵。cnt = Counter(data)# 计数每个值出现的次数Counter({1: 8, 0: 5})cnt = Counter(d

show backends;show backends \G;show data;show data from tpch.supplier;show TEMPORARY PARTITIONS FROM tpch.supplier;show PARTITIONS FROM tpch.supplier;desc supplier;show create table supplier;show rout

• batch.size:批次大小,默认16k• linger.ms:等待时间,修改为5-100ms默认是0ms,就是数据一到队列中就发给broker,这样的好处就是实时性好,但是效率低,一次发几条数据总比一次发一条效率高。也不能改太大,太大时效性不好。• compression.type:压缩snappy压缩数据,这样一批次就可以存更多的数据• RecordAccumulator:缓冲区大小,可

XML可扩展标记语言eXtensible MarkupLanguage,由W3C组织发布,目前推荐遵守的是W3C组织于2000年发布的XML1.0规范。XML用来传输和存储数据,就是以一个统一的格式,组织有关系的数据,为不同平台下的应用程序服务。

建表的基本语法[key_desc]参数说明col_name:列名称注意,在一般情况下,不能直接创建以以 __op 或 __row 开头命名的列,因为此类列名被 StarRocks 保留用于特殊目的,创建这样的列可能导致未知行为。如需创建这样的列,必须将 FE 动态参数 allow_system_reserved_names 设置为 TRUE。col_type:列数据类型之前博文数据类型agg_ty

在VS Code中,如果PDDL存在错误或警告,我们是可以动态修复的,比如上述代码存在 “Undeclared requirement :negative-preconditions” 问题。第一步,点击“Show configuration”,接着会显示PDDL Overview页面,显示“AI Planning and PDDL support in VS Code”。第三步,继续点击“Pla

结合 API 设计、文档管理、自动化测试、监控、研发管理和团队协作的一站式 API 生产平台,从个人开发者到跨国企业用户,Eolink 帮助全球超过30万开发者和数万家企业更快、更好且更安全地开发和使用 API。