简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

做满一年 CRUD 后端开发,越来越多 Java 程序员陷入职业瓶颈,我曾经也是其中一员,日复一日对接需求、写增删改查、熬夜改 BUG,干了多年的老同事薪资常年原地不动,职级晋升困难,传统后端岗位内卷加剧,随着 AI 落地普及,不少基础开发岗正在被工具精简替代,越深耕越焦虑,生怕慢慢被行业淘汰😥偶然调研 2026 年 AI 行业招聘行情,被大模型应用岗的薪资涨幅与发展前景打动,下定决心利用业余时

AI 浪潮正在全方位重塑互联网程序员的职业生态,低附加值的重复编码逐步被 AI 工具承接,但 AI / 大模型、跨领域复合型技术岗迎来大规模扩招。普通开发者不用惧怕被淘汰,找准转型方向,依托 AI 锤炼架构设计、问题拆解、落地决策核心能力,切入大模型工程、政企数字化、AI 安全等新兴赛道,借助日常实操 + 副业练手稳步完成职业升级。AI 本质是程序员效率工具而非终结者,把重复性工作交给 AI,聚焦

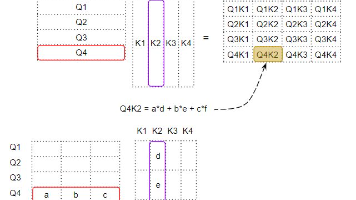

Query 和 Key 之间的点积,计算出每一对单词之间的相关程度。这个相关程度被当作一个权重因子,用来对所有 Value 单词做加权求和。这个加权和,就是输出的注意力分数。Transformer 会学习词嵌入等参数,让相关的单词向量方向更一致。这也是引入三个线性层、把输入序列变成 Query、Key、Value 三种形式的原因之一:给注意力模块更多可学习的参数,用来精细调整单词向量的生成。

2026年刷遍CSDN、脉脉程序员圈子的热门爆料,相信很多AI小白、后端开发者都刷到过!一位顺利斩获百度大模型开发岗校招Offer,薪资标准直接给到,折算综合年薪逼近50万,引发全网激烈讨论。这条薪资爆料一出,评论区瞬间两极分化。有人吐槽:百度作为国内AI赛道的头部标杆,顶尖名校硕士拿这个薪资,属实偏保守;但不少大厂资深工程师、过来人却理性点评:30k的固定底薪在大厂校招体系中十分稳健,大厂定薪绝

文章探讨了智能体开发的实践挑战,强调从简单Demo到实际应用的转变过程中,单智能体在面对复杂业务场景时的局限性。通过RAG系统改造案例,展示了多智能体架构的优势:模块化、专业化和可控性。多智能体协同不仅解决了复杂问题,还提高了系统的可扩展性和维护性,代表了智能体开发的发展方向。技术实现上,多智能体可以通过分工协作,将用户端与业务端分离,使系统更具适应性和通用性。

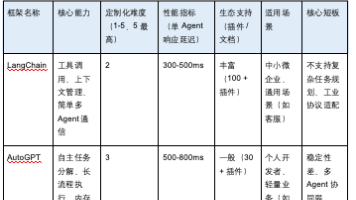

本文解析了企业开发AI Agent平台面临的三大核心矛盾:开源框架通用性与企业定制化需求不匹配、自研难度认知模糊、技术迭代与研发能力不匹配。提出了基于需求分层、技术拆解的开发路径选择框架,针对不同规模企业提供了开源二次开发与自主研发的决策建议和避坑指南,并通过实践案例验证了不同开发路径的可行性。随着生成式 AI 技术的爆发式发展,Agent(智能体)已从学术概念逐步落地为企业数字化转型的核心工具—

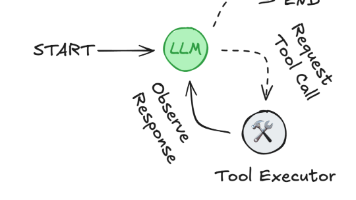

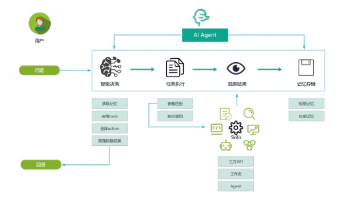

AI Agent 是一种具备高度智能化特征的“智能体”,其核心能力包括智能决策、任务执行、观察结果和记忆存储。简单来说,AI Agent 不仅能理解用户的指令和意图,还能根据环境和任务需求,主动制定方案并执行一系列复杂操作,完成特定目标。AI Agent 不再是被动的“工具”,而是能够主动参与复杂工作流程,持续优化执行策略的“智能执行者”。

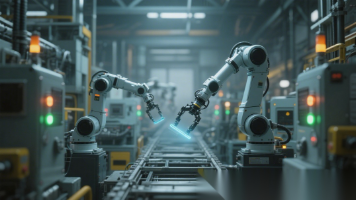

工业智能体是融合工业机理知识、大数据分析和多模态感知决策能力的自主智能系统,从"感知-决策-执行"三级架构构建,应用于研发设计、生产制造、供应链管理和运维服务等领域。尽管面临技术适配性、安全风险和成本人才等挑战,工业智能体正向更自主、更系统、更开放的方向发展,成为推动制造业智能化转型的核心力量。

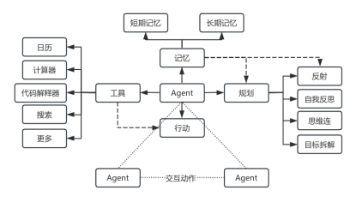

文章介绍了Agent智能体的概念、架构和与LLM的关系。Agent作为具备感知-决策-执行闭环的智能系统,以LLM为核心组件,通过整合工具、规划、行动和记忆四大要素,结合RAG技术实现对外部知识库的检索增强。这种架构使Agent能够处理复杂任务,为企业提供自动化协作、财税合规等应用场景,有效提升工作效率并降低成本。

大模型发展进入中国加速期,依赖数据、算法、算力三要素,从预训练转向后训练时代。企业应用需掌握"三板斧":Prompt工程实现低成本场景落地,RAG增强结合企业知识库解决实时性问题,Agent智能体拆解复杂业务流程。商业价值分三层:嵌入型优化流程、辅助型提升协作效率、颠覆型重构商业模式,为企业与个人应对AI时代提供全面指引。