简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍通过命令行修改Claude配置文件的方法:1)使用Win+R打开运行窗口,输入cmd启动命令提示符;2)通过PowerShell命令修改用户目录下的.claude.json文件,添加或更新hasCompletedOnboarding属性为true;3)最后重启Claude应用使更改生效。这个操作可以跳过Claude的初始引导流程,适合需要快速使用的场景。全文提供了完整的命令行操作步骤,通过

摘要:本文介绍了Git和Claude Code的安装方法。首先通过winget安装Git 2.53.0.3版本,这是运行Claude Code的基础。然后提供两种Claude Code安装方式:一是通过官网下载(需科学上网),使用npm或PowerShell命令安装;二是直接通过winget安装。最后建议验证Claude版本以确保安装成功。全文简洁明了地说明了安装步骤和注意事项。

对于同一概率流ODE轨迹上的任意点。

CCSwitch 3.13.0版本现已发布,用户可通过GitHub下载Windows安装包。安装过程简单快捷,只需按照向导点击"Next"即可完成。安装后需配置供应商API Key方可使用。该版本下载地址为:https://github.com/farion1231/cc-switch/releases/download/v3.13.0/CC-Switch-v3.13.0-Wi

CCSwitch 3.13.0版本现已发布,用户可通过GitHub下载Windows安装包。安装过程简单快捷,只需按照向导点击"Next"即可完成。安装后需配置供应商API Key方可使用。该版本下载地址为:https://github.com/farion1231/cc-switch/releases/download/v3.13.0/CC-Switch-v3.13.0-Wi

CCSwitch 3.13.0版本现已发布,用户可通过GitHub下载Windows安装包。安装过程简单快捷,只需按照向导点击"Next"即可完成。安装后需配置供应商API Key方可使用。该版本下载地址为:https://github.com/farion1231/cc-switch/releases/download/v3.13.0/CC-Switch-v3.13.0-Wi

本文系统梳理了语言模型的演进历程:从2003年NNLM首次用神经网络替代统计模型,到2013年Word2Vec通过简化架构实现效率突破(CBOW聚合上下文预测中心词,Skip-gram中心词预测上下文),再到2018年BERT采用深层Transformer实现动态语境建模。模型发展呈现从静态词向量到动态上下文表示、从局部窗口到全局双向理解的趋势。不同模型在计算效率、语义捕捉、一词多义处理等方面各具

Word Embedding(词嵌入)是一种将离散的词汇符号映射到连续的低维稠密向量空间的技术。在这个向量空间中,语义相似的词在几何距离上彼此接近,从而实现了从"符号匹配"到"语义计算"的跨越。核心定义词嵌入是将单词(或多词短语)表示为固定维度的实值向量,这些向量之间的距离(例如余弦相似度)反映了单词之间的相关性,这种相关性基于单词通常出现的上下文。分布式假设(1954)↓统计共现分析(LSA/S

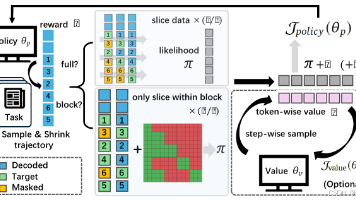

本文提出了一种创新的强化学习框架TraceRL,专门针对扩散大语言模型设计。研究团队通过理论推导和算法实现,解决了传统强化学习方法在扩散模型应用中的关键挑战。论文首先形式化定义了扩散概率模型的前向扩散和反向去噪过程,建立了掩码扩散过程的数学描述,并从信息论角度对比了扩散生成与自回归生成的本质差异。核心贡献TraceRL框架将去噪过程建模为马尔可夫决策过程,创新性地设计了轨迹感知的密集奖励机制和扩散

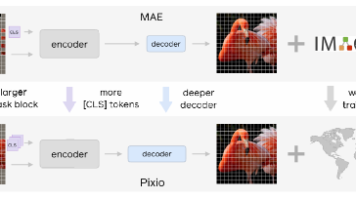

本文介绍了Pixio模型,这是一种在像素空间进行自监督视觉预训练的新方法。论文首先分析了当前自监督视觉预训练的两大范式:潜在空间方法(如对比学习)和像素空间方法(如MAE),并指出它们各自的优缺点。在此基础上,Pixio通过四项关键技术改进MAE框架:(1)编码器-解码器容量重分配,采用更深的解码器;(2)优化掩码策略,使用更大粒度的掩码块;(3)引入多类别标记机制;(4)设计网络规模数据的自适应