简介

该用户还未填写简介

擅长的技术栈

可提供的服务

大数据人工智能相关课程培训,人工智能培训及咨询,合作抠抠526346584

数据集的格式要求在不同的阶段是不同的,本教程以sft阶段的数据集需求,将以系统自带的identity数据集和将自定义的一个商品文案生成数据集为例,介绍数据集的使用。更多详情可以在中找到相关解释。系统目前支持alpaca和sharegpt两种数据格式,以alpaca为例,整个数据集是一个json对象的list,具体数据格式为"instruction": "用户指令(必填)","input": "用户

摘要:DeepSeekMath大模型通过创新方法显著提升了开源模型的数学推理能力。研究团队从CommonCrawl挖掘出120B tokens的数学内容构建DeepSeekMathCorpus数据集,其性能远超现有数据集。模型采用代码预训练初始化,结合新型GRPO强化学习算法(省去价值模型,降低训练成本),在多个数学基准测试中表现优异:7B参数的DeepSeekMath在MATH基准达到36.2%

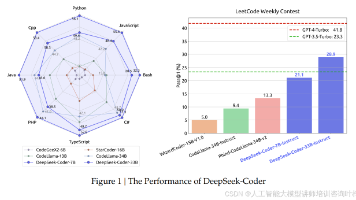

摘要:DeepSeek-Coder系列开源代码模型突破闭源垄断,采用2万亿tokens高质量训练数据,支持1.3B-33B参数规模。创新性引入16K长上下文窗口和FIM填空任务,在HumanEval等基准测试中超越Codex等闭源模型。33B版本性能接近GPT-4,7B版本也优于CodeLlama-33B。V2版本扩展至128K上下文和338种语言,HumanEval准确率达93.2%。该模型支持

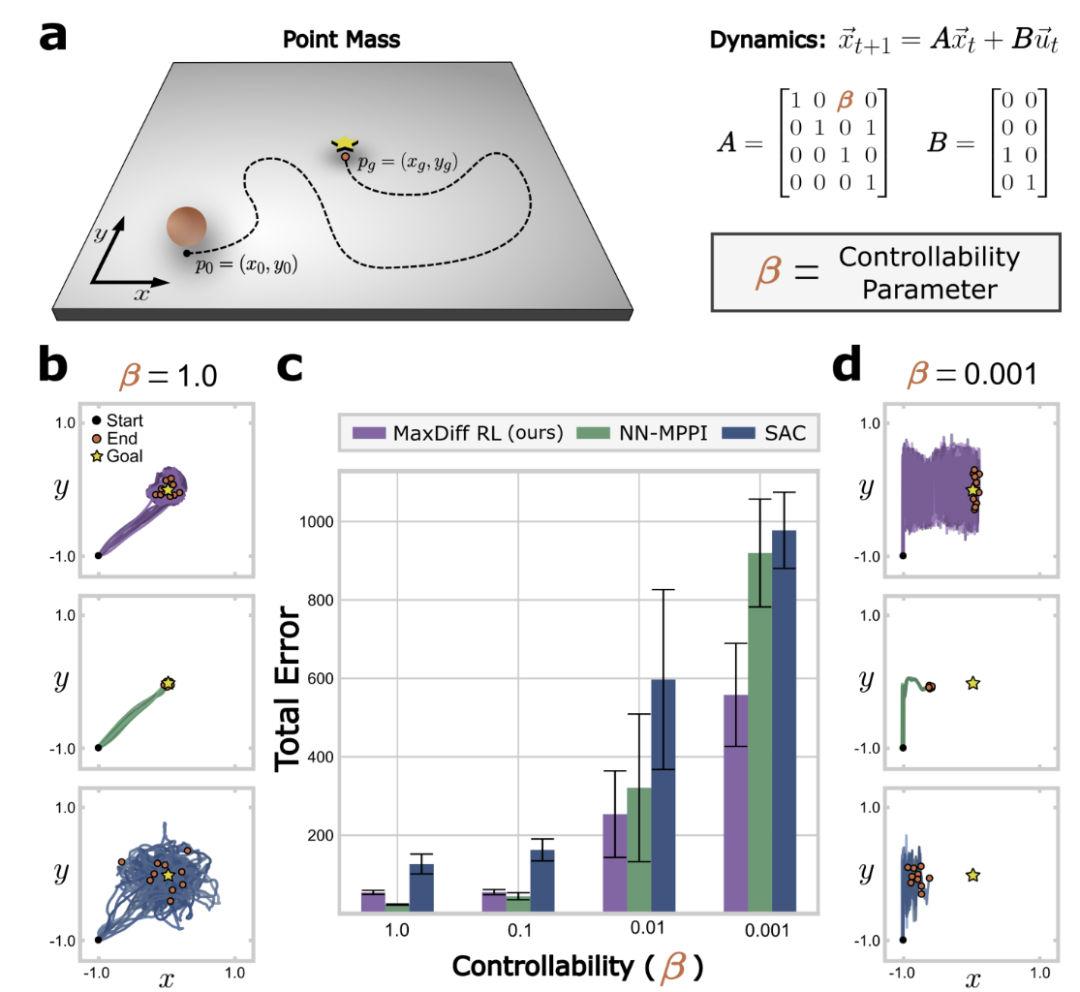

MaxDiffRL 同时考虑策略和智能体-环境动力学的时间相关性的一般形式,若不考虑时间相关性,就褪化成MaxEntropy,即MaxEnt是MaxDiff的特例。找到满足最大扩散的轨迹分布的policy,是一个优化问题:最小化“agent现在的轨迹分布与 最大扩散轨迹分布“之间的KL距离。不同于从固定的均匀分布或高斯分布中采样,最大熵强化学习最大化学习到的路径分布(即策略)的熵,以期确保足够的随

本文详细介绍了EasyR1训练框架的执行流程,包含启动、初始化、Rollout、奖励计算、更新及验证保存等关键阶段。框架通过Ray分布式系统实现并行处理,采用vLLM生成响应,结合PPO算法进行模型优化。具体包括:1)命令行参数解析和Ray初始化;2)分词器、数据加载器、Worker组和奖励管理器的创建;3)vLLM生成响应序列;4)多阶段奖励和价值计算;5)基于FSDP的梯度更新;6)周期性验证

我们在11个下游视觉数据集上进行了实验证明,本文方法在少样本场景中显著提高了现有多模态提示学习模型的性能,相较于16张图像的最先进方法,平均准确率提升了2.31%。本文在诸如链接预测和网络完成等各种下游任务中进行了定量评估,结果表明本文的建模框架能够有效跟踪潜在空间中节点的内在轨迹,捕捉不断演变的网络结构的基本特征。最终,本文收集了2249个查询-结果对和347个表格,使用三种不同的评估指标对五个

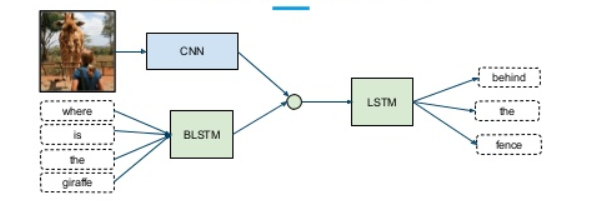

我们对世界的体验是多模态的 —— 我们看到物体,听到声音,感觉到质地,闻到气味,尝到味道。模态是指某件事发生或经历的方式,当一个研究问题包含多个模态时,它就具有多模态的特征。为了让人工智能在理解我们周围的世界方面取得进展,它需要能够同时解释这些多模态的信号。例如,图像通常与标签和文本解释相关联,文本包含图像,以更清楚地表达文章的中心思想。不同的模态具有非常不同的统计特性。这些数据被称为多模态大数据

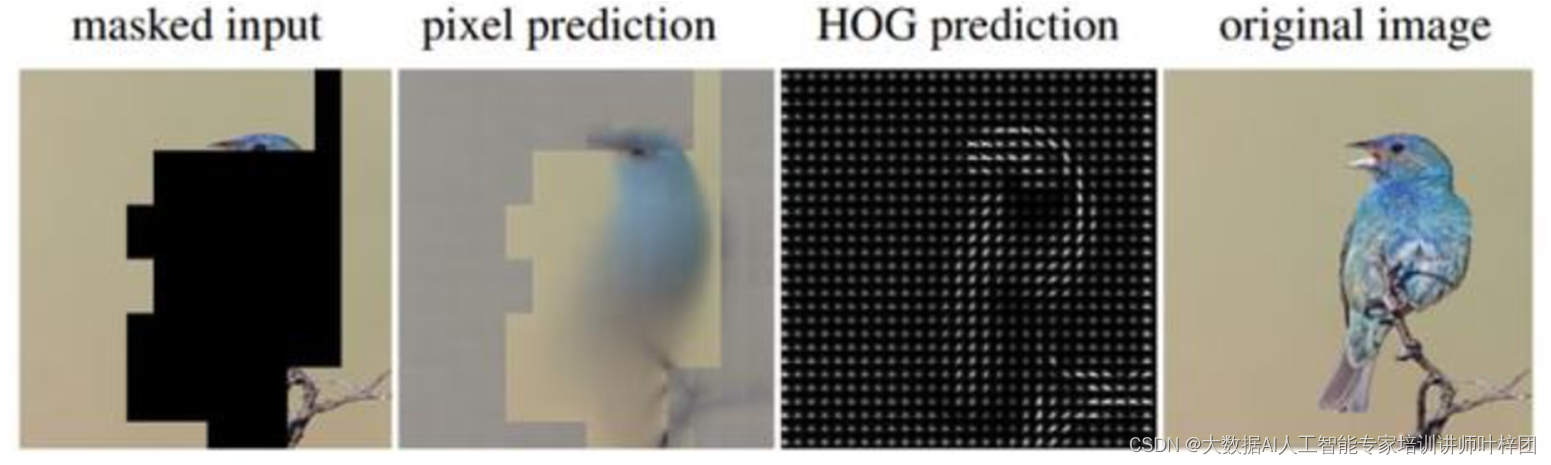

接上一篇P32P33n2021年12月中旬,Facebook AI Research和约翰霍普金斯大学的研究人员提出了MaskFeat,也是采用「Mask-and-Predict」的方法,性能却比MAE上更进一步。nMaskFeat最核心的改变就是将MAE对图像像素(pixel)的直接预测,替换成对图像的方向梯度直方图(HOG)的预测。...

距离的度量ß曼哈顿距离ß欧几里得距离据说源于在曼哈顿接街头,无论出租车怎么开,距离都是一样的!ß切比雪夫距离国际象棋是俄罗斯人民的最爱,用“国王”的走法来解释,通俗易懂!曼哈顿距离与欧几里得距离相似性的度量ß余弦相似度用向量空间中两个向量夹角的余弦值作为衡量两个个体间差异的大小。ß相比距离度量,余弦相似度...

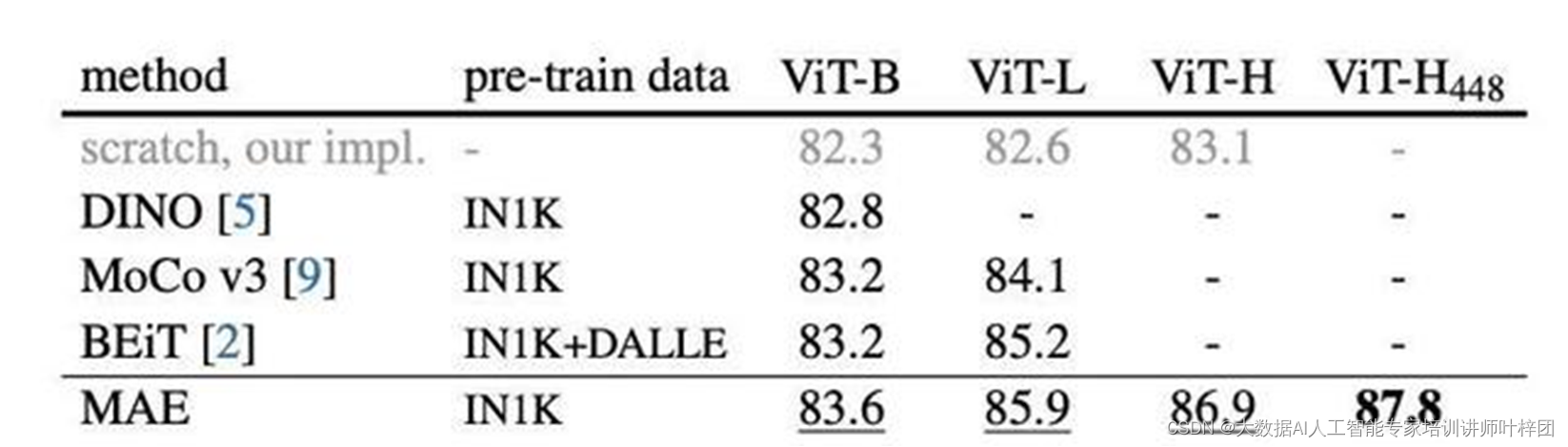

接上一篇P28P30实验效果-ViT模型的影响n性能惊艳:ImageNet-1K最高87.8%。与当前SOTA自监督预训练方法相比,对于 ViT-B 的表现结果都很接近。对于 ViT-L不同方法的结果就存在很大差距,这表明更大模型的挑战是减少过度拟合。n再看最后一列,仅使用ImageNet-1K数据时,ViT-Huge模型的最高精确度为87.8%,这明显超过了所有在ImageNet-21K 预训练