简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

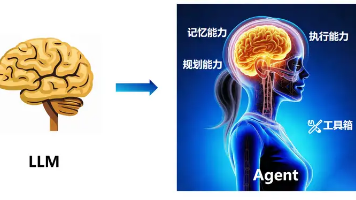

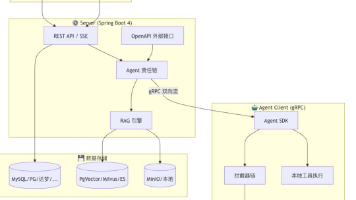

在AI大模型浪潮席卷全球的今天,Python几乎成了AI开发的"标配"。但对于占据企业应用半壁江山的Java技术栈团队来说,如何快速接入AI能力、构建生产级的AI Agent系统,一直是个难题。今天,我们要介绍的 Snail AI,就是为Java/Spring技术栈量身打造的企业级AI Agent开源平台。

2026年普通人利用AI智能体开展副业的5种路径:开发AI小工具、用AI提升效率做兼职、开设AI训练营、创作内容矩阵、制作数字资产。强调AI副业门槛低、自动化、平台给流量的优势,提供真实案例拆解,并给出行动三步走:选赛道、做小样、放大+复利。适合小白和程序员低成本入场AI副业领域。你是不是也常这么觉得:每天忙到脚不沾地,但银行卡余额就是不见涨;想搞个副业,不是抽不出时间,就是不知道从哪儿下手;好不

2026年AI副业风口:零技术也能月入过万!从AI智能体搭建、数字人带货到漫剧创作,10大实战方向任你选,每晚1小时轻松增收,上班族躺赚指南来了。最近好多姐妹问我,到底怎么用AI搞点零花?很多人一提AI副业,第一反应就是:我要学哪个工具?不会技术能不能做?2026年做AI副业其实真的没那么难,但也绝对不是什么随便点几下就能暴富的哈,我自己也摸索了一段时间,特别是AI漫剧我也是深耕了一段时间,今天给

LangChain 是一个开源框架,旨在简化基于大型语言模型(LLMs)的应用程序开发。通过模块化组件和链式结构将语言模型与外部数据源、工具和任务流程集成,构建复杂且功能强大的应用程序。

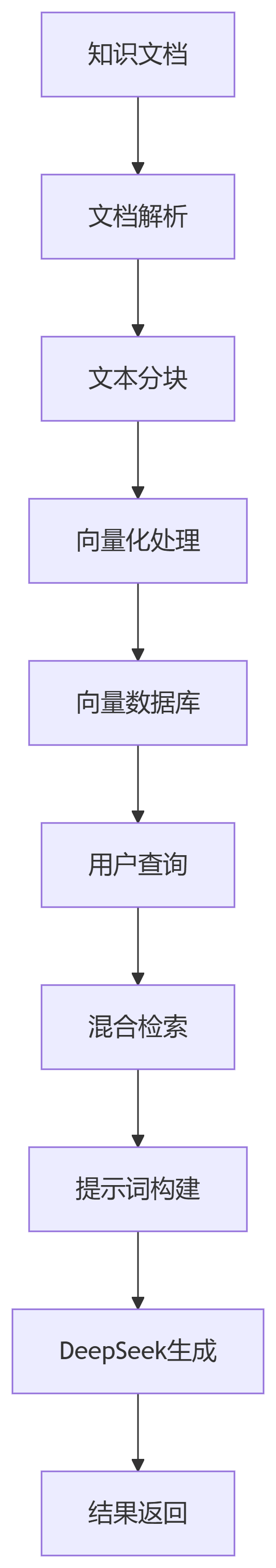

在前面的文章,我介绍了基于LM studio的大模型部署和API调用,本文将介绍一个实际的项目案例,即利用Python构建一个本地化的知识库来加深大家对于大模型本地化应用的理解。Chroma作为向量数据库的选择,则是因为其优秀的性能和易用性,适合存储和查询大规模文本向量。同时,BM25模型被用来构建额外的检索层,它根据词频和逆文档频率计算文档的相关性得分,这对于处理未见过的查询尤其有用。截至目前大

TextIn平台是一款基于OCR(光学字符识别)技术的智能文档解析工具,能够高效提取文档中的结构化数据。特别是在财报分析中,TextIn的OCR技术能够精准识别财务报表中的表格和文本,并将其转换为可处理的Markdown格式。这样,企业不仅可以避免人工输入带来的错误,还可以大大提升财报处理的速度和准确性。合合信息的TextIn与DeepSeek R1的结合,提供了一种全面、自动化的财报分析解决方案

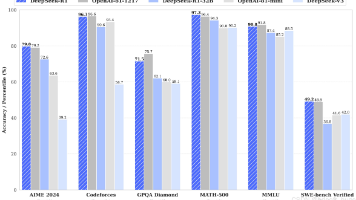

DeepSeek-R1 是幻方量化旗下大模型公司 DeepSeek 研发的系列推理模型,以下是关于它的简介:2024 年 11 月 20 日:DeepSeek-R1-Lite 预览版正式上线网页端,仅支持网页使用,暂不支持 API 调用。2025 年 1 月 20 日:DeepSeek 正式发布 DeepSeek-R1 模型,并同步开源模型权重。2025 年 1 月 24 日:在 Arena 上,

作为一个非算法出身的AI产品经理,转行之前我也有过纠结和顾虑,怕自己“干不了”。