简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

最近好不容易用服务器把模型跑起来了,美滋滋地看他一轮一轮训练,感觉应该没啥问题,想着一个晚上训练完肯定没问题!结果第二条早上来一看:main()这不是说我显存不够了吗!使用nvidia-smi命令查看服务器显卡使用情况:没错,我用的就是0号显卡,难道是实验室师兄师姐在训练模型?不应该呀!这个显存占用量和我模型训练的显存占用量极为相似,何况师兄师姐他们训练模型之前肯定会查看显卡的使用情况的!

部署yolo项目,是我这几个月以来做的事情,最近打算把这几个月试过的方法,踩过的坑,以博客的形式,分享一下。关于下面动态中讲到的如何用opencv部署,我在上一篇博客中已经详细讲到了:【yolov8部署实战】VS2019环境下使用C++和OpenCV环境部署yolo项目|含详细注释源码。这篇博客主要讲讲使用onnxruntime部署主要参考:https://github.com/Amyheart/

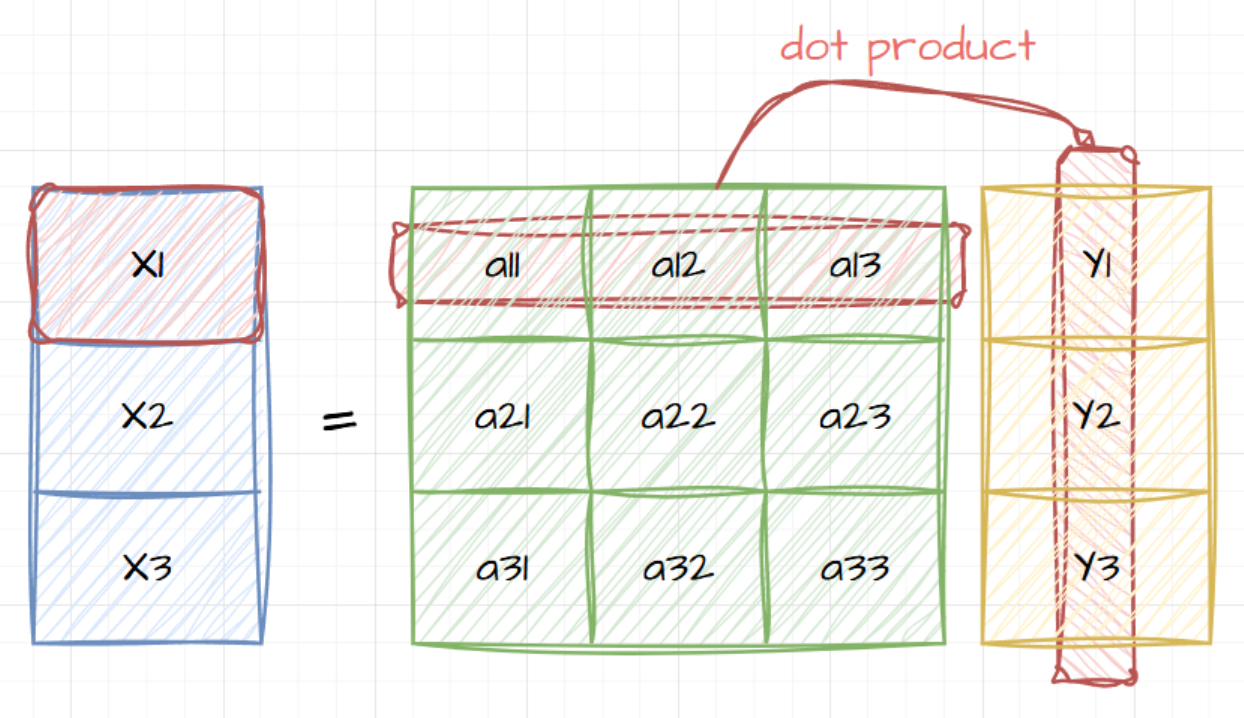

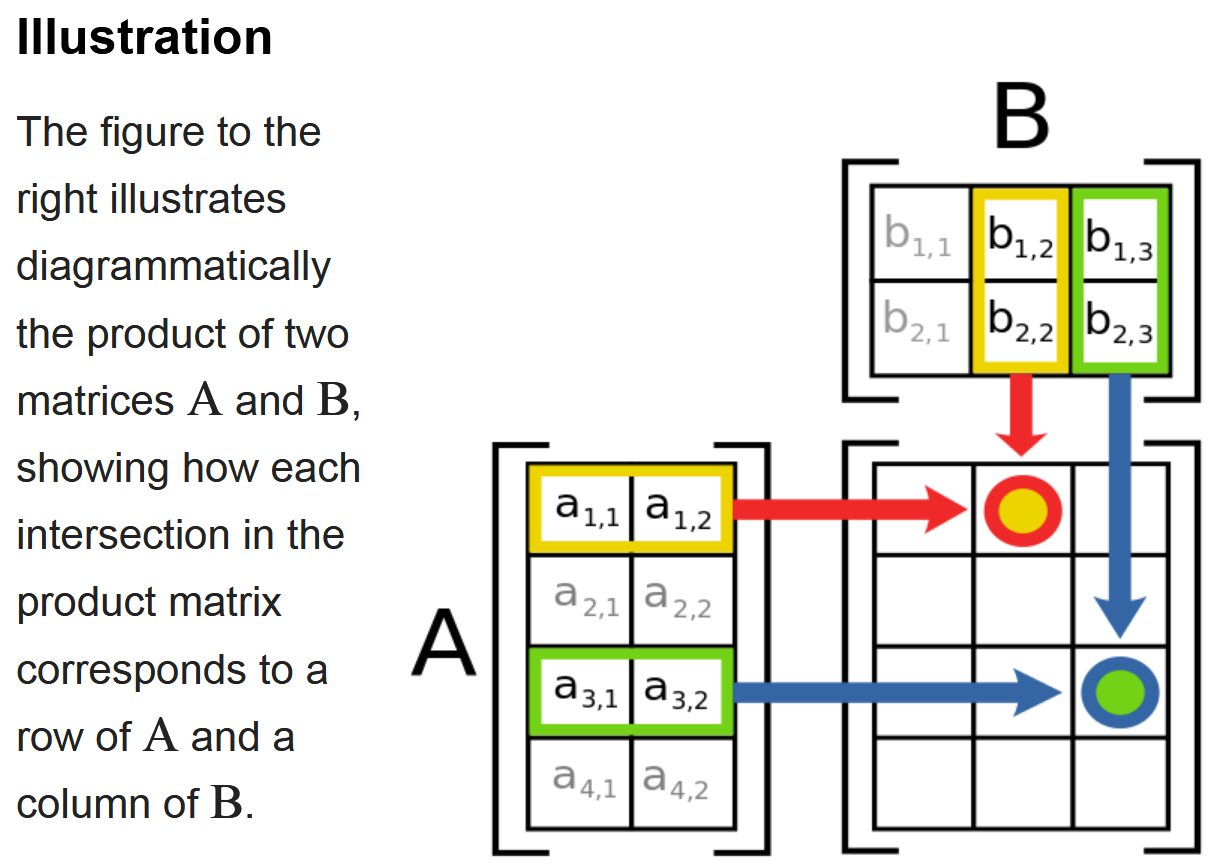

在之前的学习中,我自以为我对张量、矩阵、数组,已经十分清楚。就在近期我打算再好好学习一下张量各个操作的过程极其原理的时候,才发现之前的自己或许根本没有弄清楚张量到底是个啥?为什么呢?我发现我学习的过程中发现对张量的各个操作有种说不上来的不明白。我问了自己很久,到底是哪一点让自己感受到这种“不舒适”的学习感?我向来是一个喜欢追根溯源,刨根问底的人。于是我问我自己这个问题区分这两个概念:[x,y,z]

爱因斯坦求和约定(Einstein Summation,简称einsum)是一种简洁且功能强大的符号表示法,用于指定复杂的张量运算。在深度学习领域,特别是在 PyTorch 库中,提供了一种灵活的方式来执行各种张量操作,例如矩阵乘法、点积、批量计算、外积、规约(reduction)、重塑(reshaping)或转置(transposing)等等。在上篇文章中我们介绍了张量关于”积“的各种操作【深度

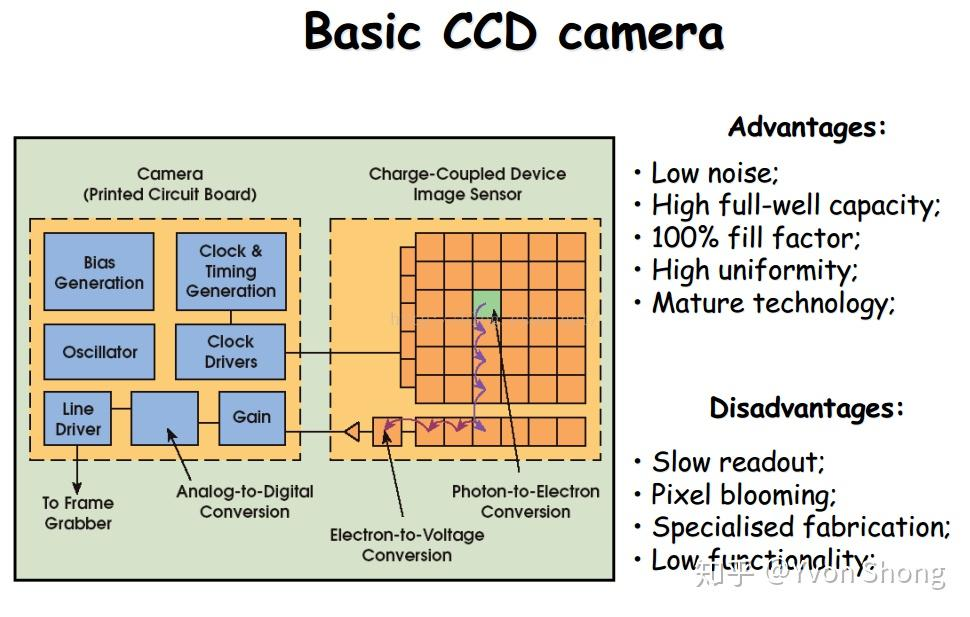

前言一、图像传感器技术1.0:前言1.1:两种典型图像传感器1.2:图像传感器主要参数解析1.2.1:传感器材料⭐1.2.2:传感器的光电二极管元件⭐1.2.3:传感器分辨率⭐1.2.4:图像传感器的两种基本结构⭐1.2.5:灵敏度1.3:传感器成像原理1.3.1:光腔阵列和光腔1.3.2:如何获得彩色图像1.3.3:马赛克变换(DEMOSAICING)1.4:传感器中的数据流程1.5:传感器的处

点积内积外积哈达玛积(Hadamard Product矩阵乘法这篇博客,我将结合这三种操作在深度学习中的运用,来讲解一下这三种操作的区别。对比总结表运算数学符号代码实现(PyTorch)输入要求输出规则矩阵乘法ABABA @ B或前列=后行行列点积求和点积(内积)u⋅vu⋅v同维向量标量外积u⊗vu⊗v任意两向量矩阵(( \mathbf{u} \mathbf{v}^T ))哈达玛积A∘BA∘BA

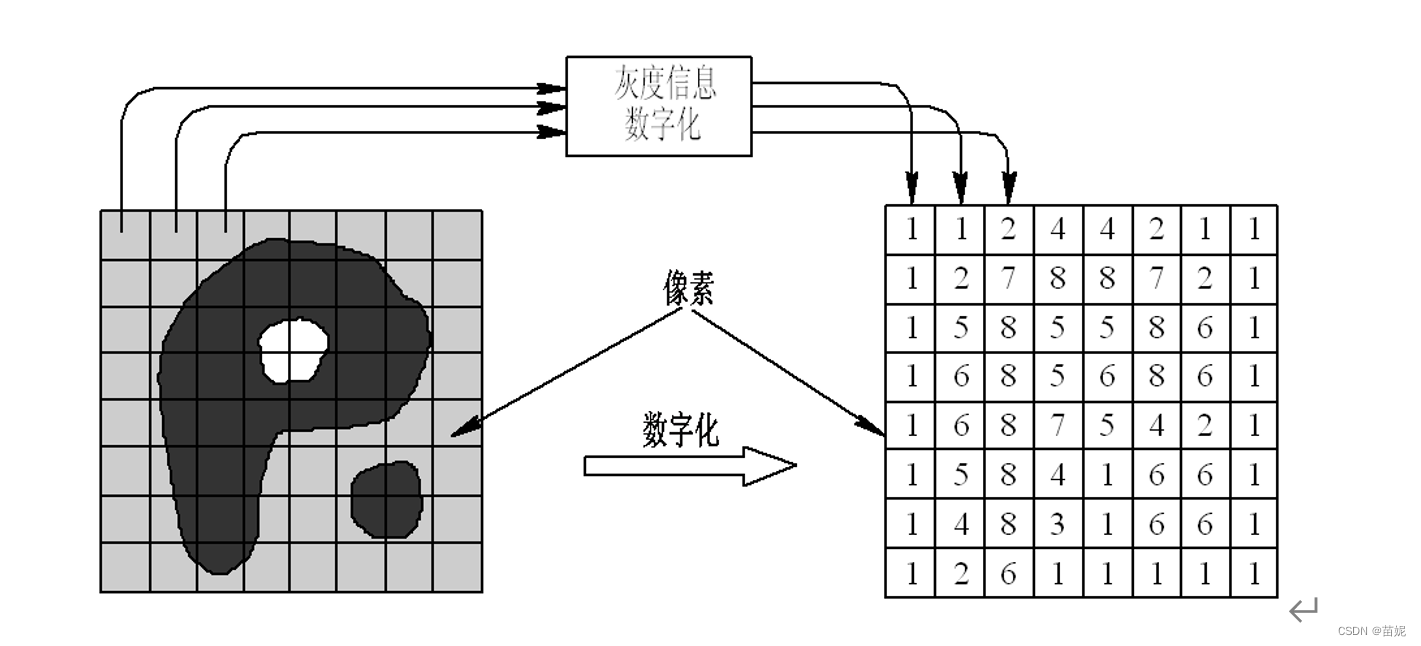

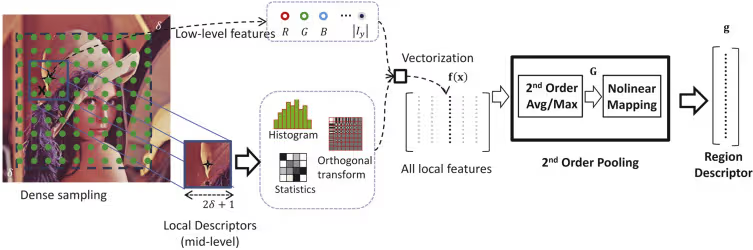

🍊什么是计算机视觉特征?简单来说就是图像特征,对于我们来说,看到一张图片,能很自然的说出和描述图像中的一些特征,但是同样的图片,丢给计算机,只是一个二维矩阵,计算机需要从这个图像中提取计算得到一些数值表示,来描述这个图像所具有的特征:颜色、形状、纹理等。🍊什么是计算机视觉特征度量?(如颜色直方图、梯度直方图、形状描述符),(如图像检索、目标跟踪、人脸识别、物体识别等)的。根据,可以将特征度量分

yolov8 opencv模型部署(C++ 版)win10下 yolov8 tensorrt模型部署✨使用opencv推理yolov8模型,仅依赖opencv,无需其他库,以yolov8s为例子,注意:使用opencv4.8.1!使用opencv4.8.1!使用opencv4.8.1!如果你使用别的版本,例如opencv4.5,可能会出现错误至于怎么安装yolov8、训练模型、导出onnx博客中都

光流(optical flow)是空间运动物体在观察成像平面上的像素运动的瞬时速度。所谓光流就是瞬时速率,在时间间隔很小(比如视频的连续前后两帧之间)时,也等同于目标点的位移💭🤔所以也就是说,只要我们求出这个“速度”,也就是只要确定当前目标区域的位移,即可确定这个目标在下一帧中的位置(有时候也会说,根据上一帧和当前帧的信息,确定目标在当前帧中的位置)。——这也是生成式方法中逐次逼近搜索的体现,

【最短路算法】一篇文章彻底弄懂Dijkstra算法|多图解+代码详解Dijstra算法用于计算单源正权边的最短路问题今天学习的贝尔曼福特算法,是用于计算单源,且可含负权边的最短路问题用于求解单源、有负权边的最短路问题实现通过m次迭代求出从起点到终点不超过m条边构成的最短路径其优于Dijkstra的方面是边的权值可以为负数、实现简单,缺点是时间复杂度过高。