简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文此次的主要内容是使用强化学习训练语言模型的过程,特别是通过人类反馈的强化学习(RLHF)技术来微调大语言模型。本文先介绍了预训练模型的使用,然后重点介绍了RLHF的第二阶段,即将下游任务以特定数据集的形式交给大模型,以及第三阶段,即训练奖励模型。同时,文章还讨论了微调语言模型时使用的DFT方法和奖励模型的重要性,以及PPO在迭代更新参数中的作用。最后,本文提醒用户注意数据准备和奖励模型训练等额

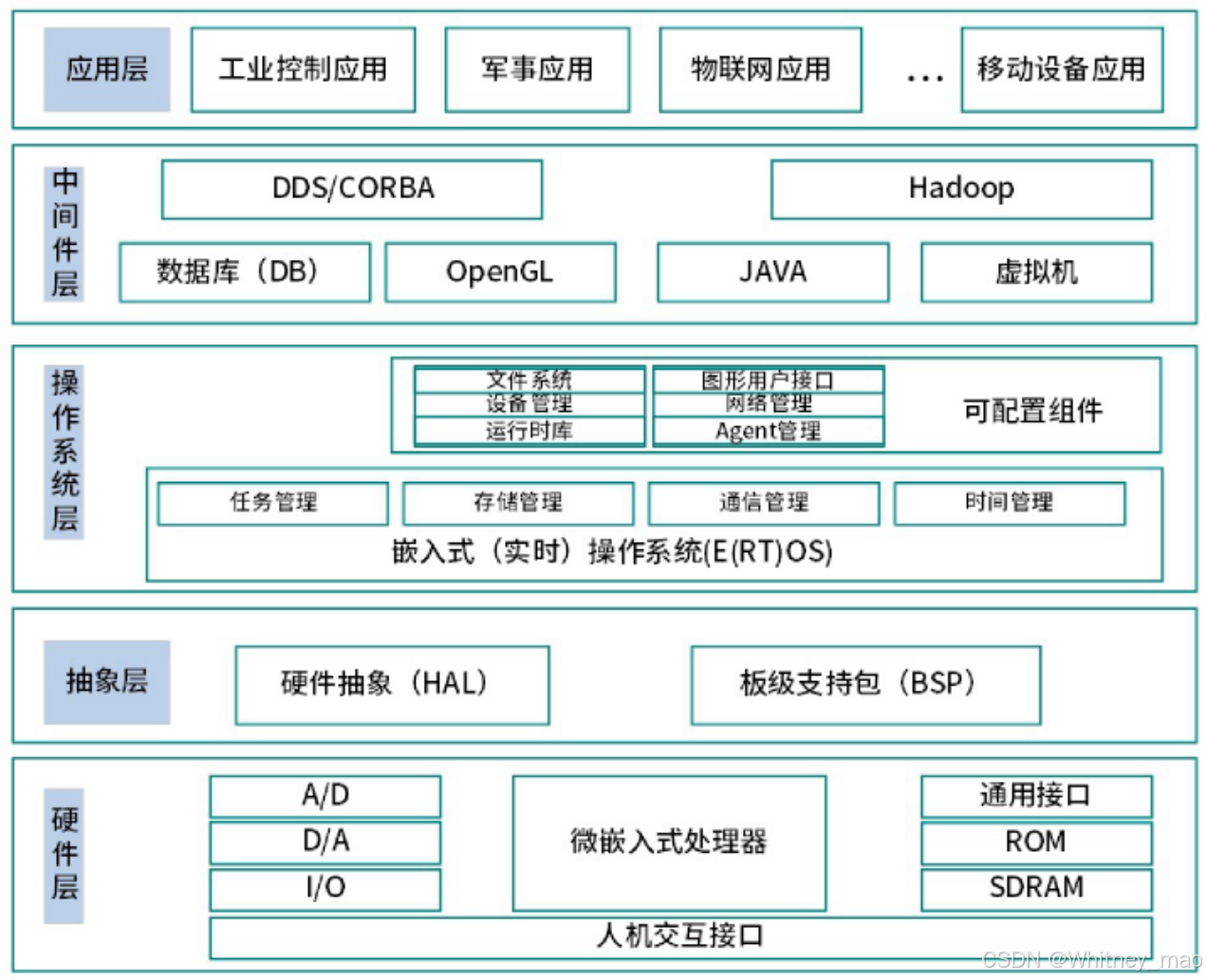

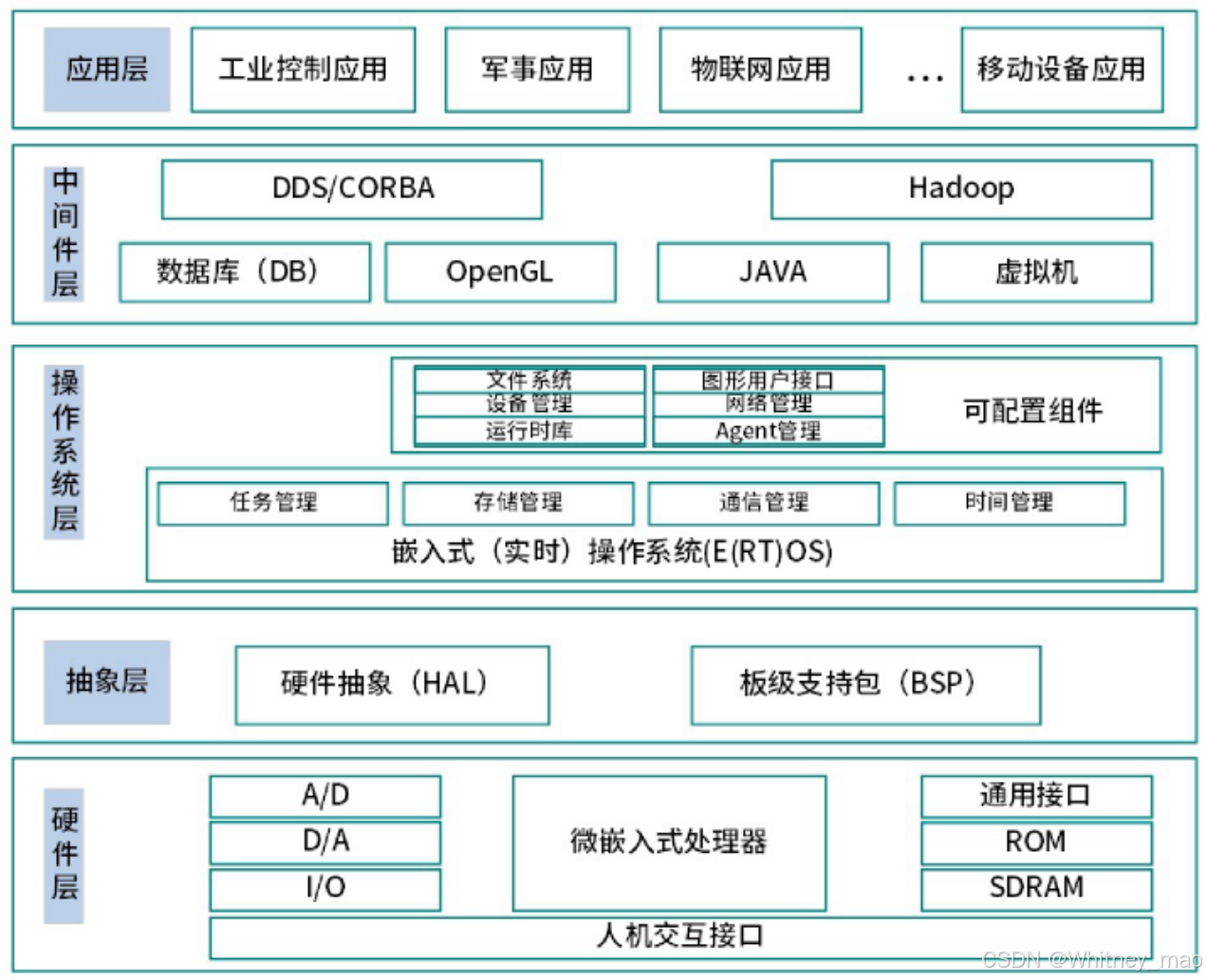

本文主要讲述了嵌入式系统的组以及功能设计原理。同时,本文也会介绍嵌入式系统的基本情况、设计思想、组成部分和实时操作系统等特点,以及微内核、宏内核架构和嵌入式数据库等相关知识。

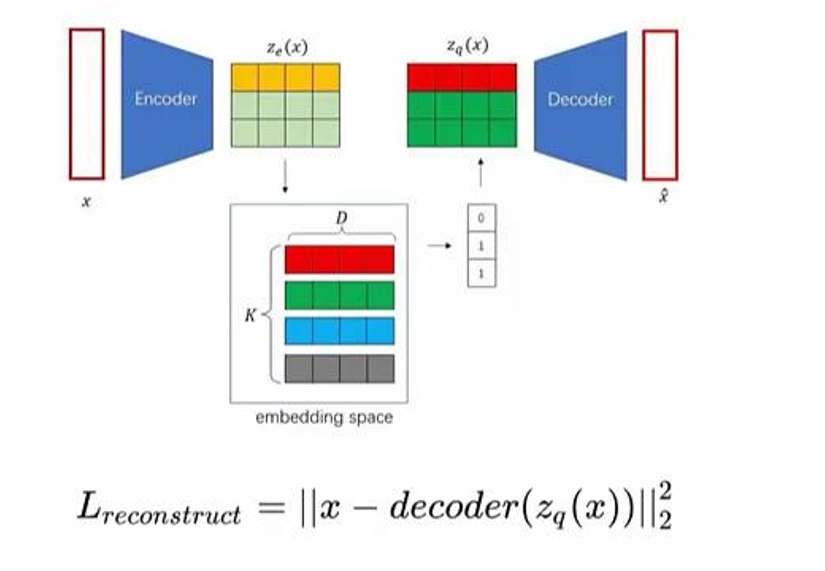

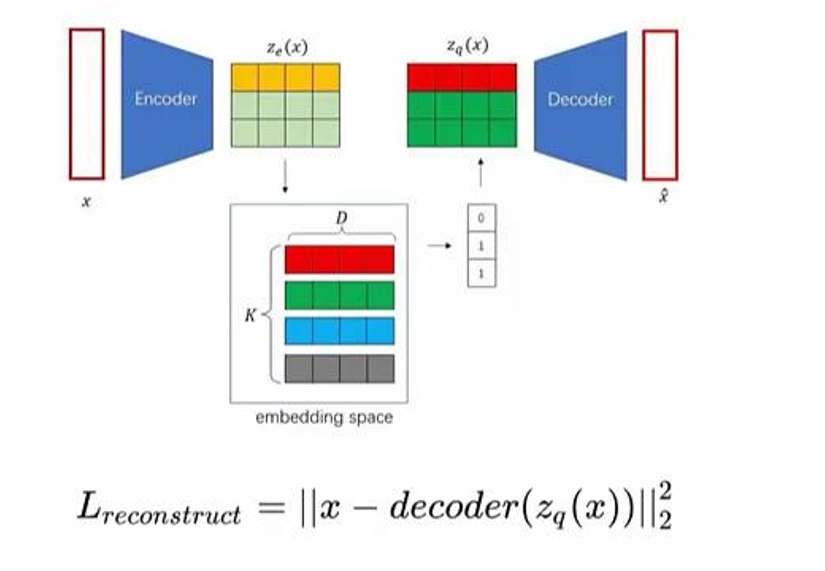

本文主要讲述了向量生成图像的原理、限制及训练方法。首先介绍了向量生成图像的基本原理和局限性。此外,通过约束向量和图像token化,实现了向量的非连续化,使得每个向量对应一个具体的图像特征。最后,详细阐述了训练过程中的关键概念、目标和流程,包括训练的必要性、训练目标和流程,以及解决训练过程中问题的方法,如使用神经网络预测像素和逐步学习预测像素的能力。

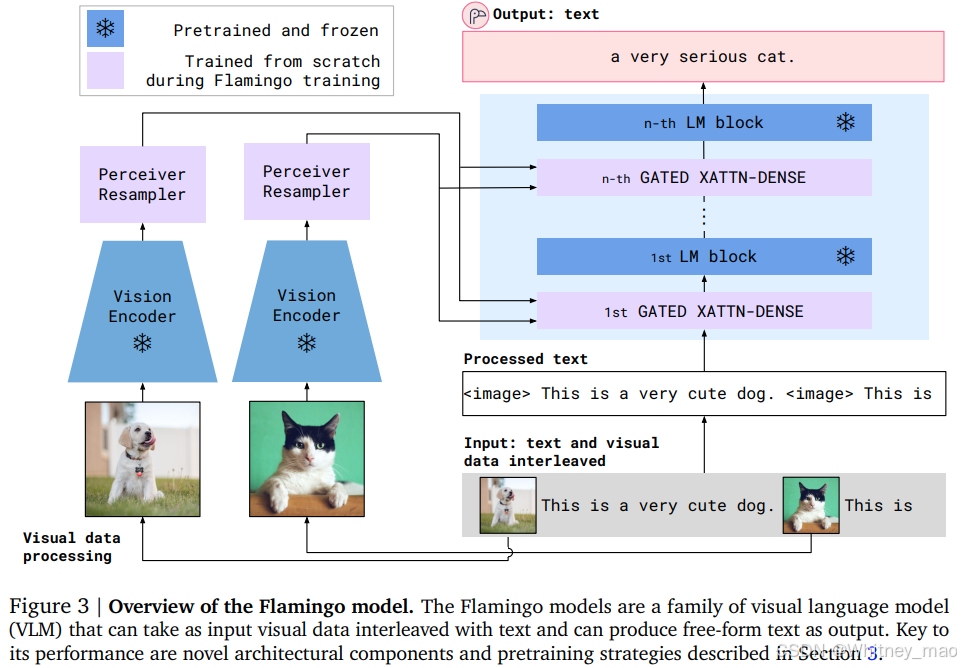

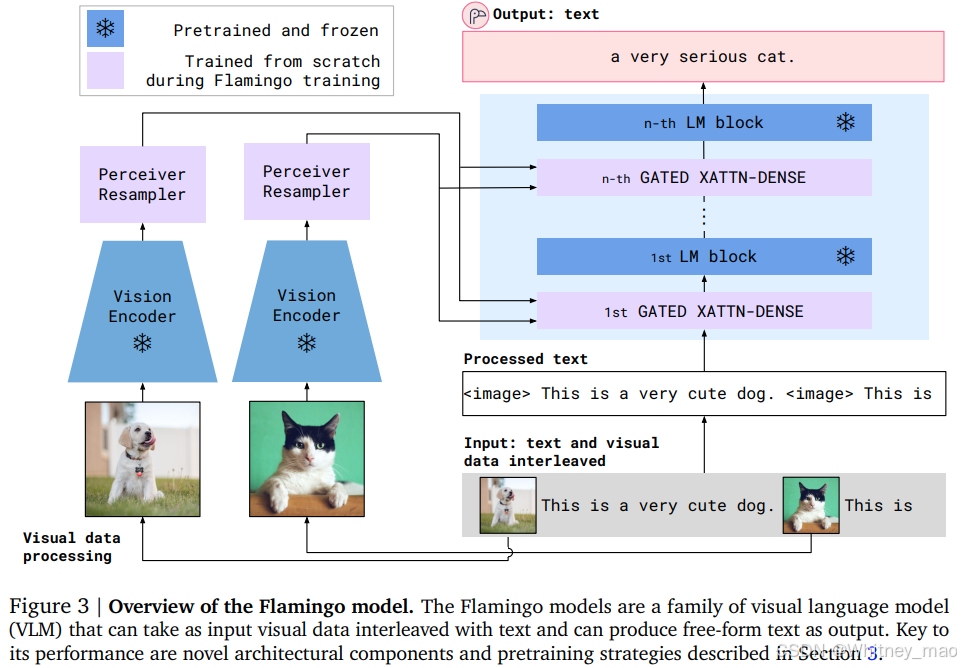

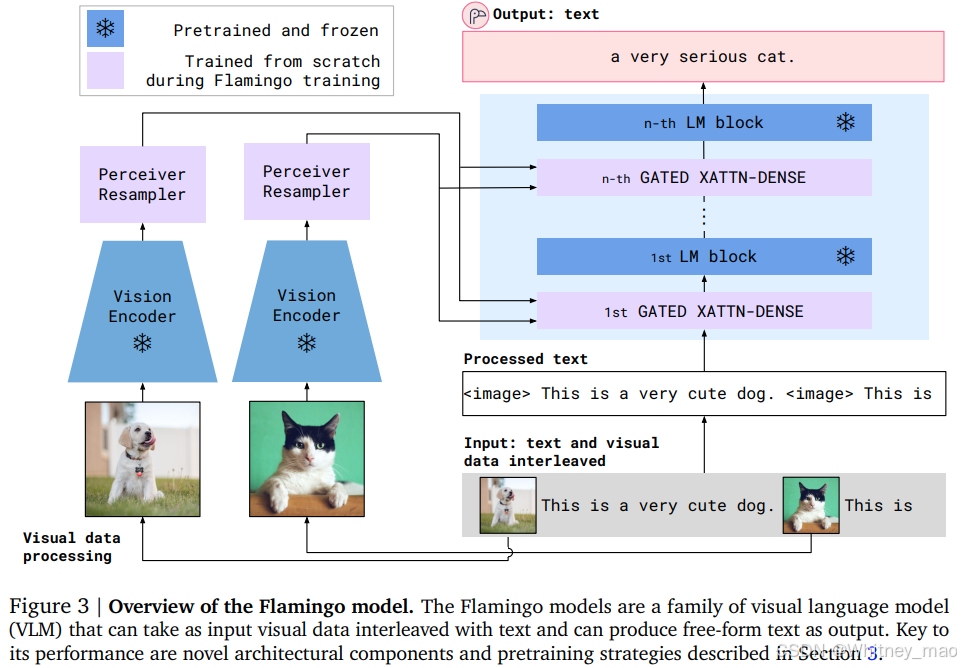

本文从多模态大模型相关概念出发,并以Flamingo 模型为例,探讨了基于多模态大模型训练的演进与前瞻。新一代训练范式包括统一架构、数据工程革新和动态适应机制,以提升跨模态推理能力和长视频理解。

本文主要讲述了嵌入式系统的组以及功能设计原理。同时,本文也会介绍嵌入式系统的基本情况、设计思想、组成部分和实时操作系统等特点,以及微内核、宏内核架构和嵌入式数据库等相关知识。

本文从多模态大模型相关概念出发,并以Flamingo 模型为例,探讨了基于多模态大模型训练的演进与前瞻。新一代训练范式包括统一架构、数据工程革新和动态适应机制,以提升跨模态推理能力和长视频理解。

本文主要讲述了向量生成图像的原理、限制及训练方法。首先介绍了向量生成图像的基本原理和局限性。此外,通过约束向量和图像token化,实现了向量的非连续化,使得每个向量对应一个具体的图像特征。最后,详细阐述了训练过程中的关键概念、目标和流程,包括训练的必要性、训练目标和流程,以及解决训练过程中问题的方法,如使用神经网络预测像素和逐步学习预测像素的能力。

本文从多模态大模型相关概念出发,并以Flamingo 模型为例,探讨了基于多模态大模型训练的演进与前瞻。新一代训练范式包括统一架构、数据工程革新和动态适应机制,以提升跨模态推理能力和长视频理解。

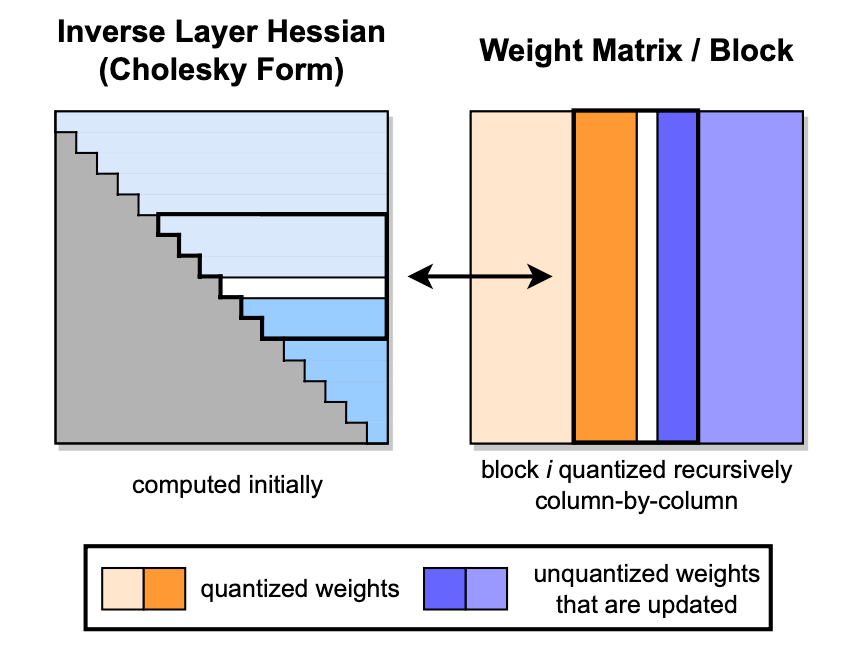

本文主要讲述了模型量化技术在大模型微调中的重要性,包括如何使用transformers库进行模型量化,以及AWQ量化方法,从而强调了模型量化可以降低推理成本,减少计算资源和时间,优化大模型的微调过程。AWQ是一种从大模型中找到重要值的量化方法,可以避免使用数据集进行反向传播和矩阵分解。该方法在两个模型上进行测试,并与BNB的量化方法和原始的十六位浮点数方法进行比较,也鼓励实际操作使用AWQ来量化模

本文主要阐述了如何使用第二代6B模型进行对话训练,以及如何通过微调来提高大模型的性能。文中提到了在8501端口上启动第二代6B模型,并使用极简模板进行请求。与第一代模型相比,第二代6B模型具有更强的对话能力,并且可以通过微调来适应特定任务。此外,本文还介绍了如何使用ChatGLM-6B模型进行调用,以及如何使用gradio进行环境隔离和客户端创建。最后,文中提到了向量数据库和基于大模型的RAG或c