简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Spark SQL Catalyst优化器详解:Spark SQL语句通过Catalyst优化器转换为RDD执行,包含Parser、Analyzer和Optimizer三个模块。Parser使用ANTLR将SQL解析为AST;Analyzer进行元数据绑定和类型检查;Optimizer是核心,分为RBO和CBO。RBO通过谓词下推、列裁剪等规则优化,CBO基于统计信息选择最优执行计划。Cataly

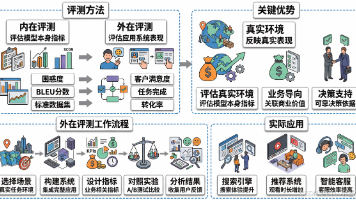

📌 外在评测(Extrinsic Evaluation)是AI模型评估的核心方法,它通过将模型部署到真实应用场景中,直接衡量其业务价值而非技术指标。与内在评测(如BLEU分数、准确率等)相比,外在评测聚焦三大优势: 1️⃣ 真实性 - 在完整系统中评估用户满意度、任务效率等实际表现 2️⃣ 业务导向 - 直接关联商业KPI如转化率、收入增长 3️⃣ 综合性 - 考量数据质量、用户行为等全链路因素

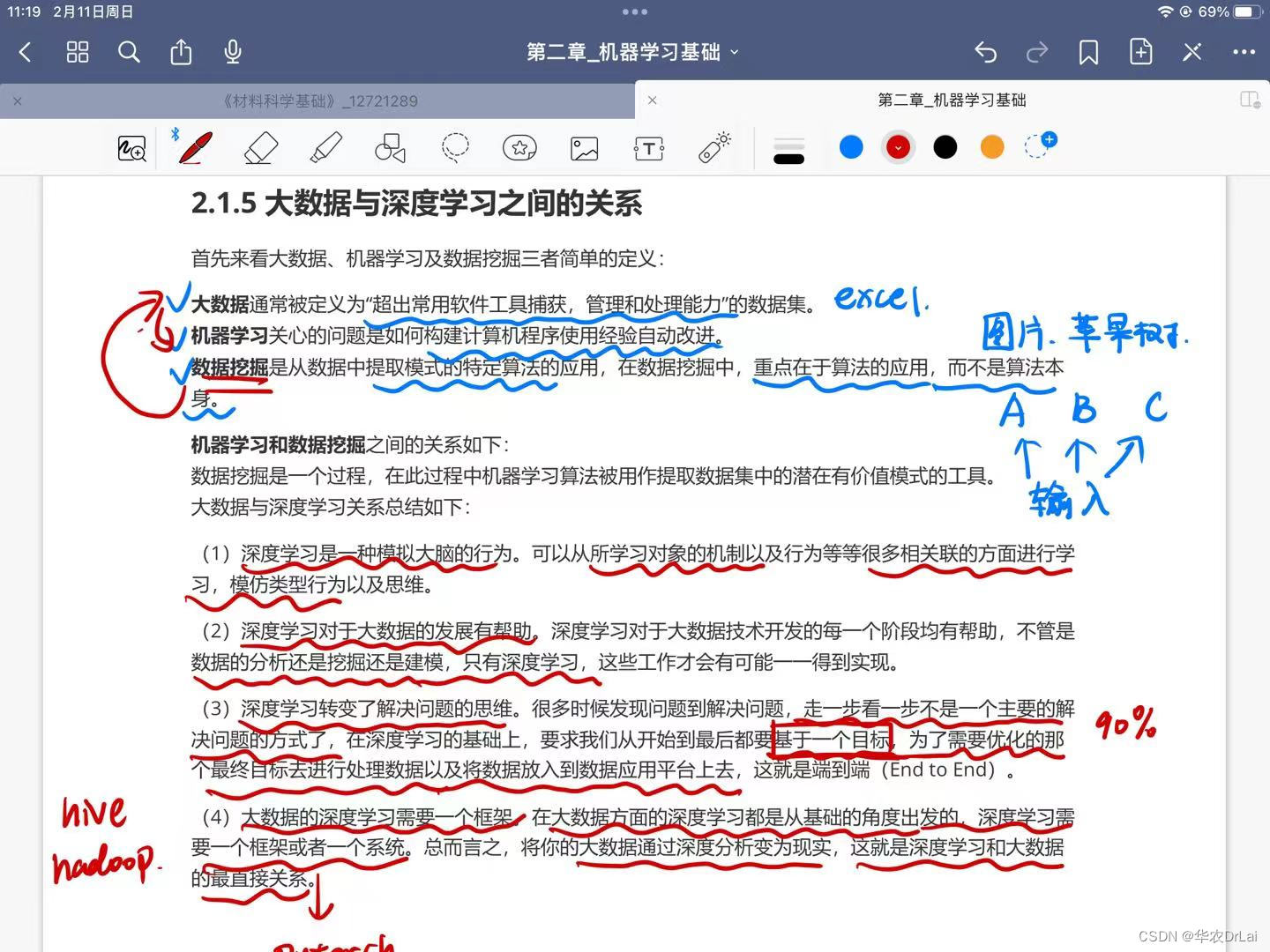

大数据的定义与特点:大数据指的是规模(数据量)、多样性(数据类型)和速度(数据生成及处理速度)都超出了传统数据处理软件和硬件能力范围的数据集。它具有四个主要特点,通常被称为4V:Volume(体量)、Velocity(速度)Variety(多样性)和Veracity(真实性)大数据与深度学习的关系,数据量的需求: 深度学习需要大量的数据来训练其模型。深度学习的概念深度学习是机器学习的一个子领域,它

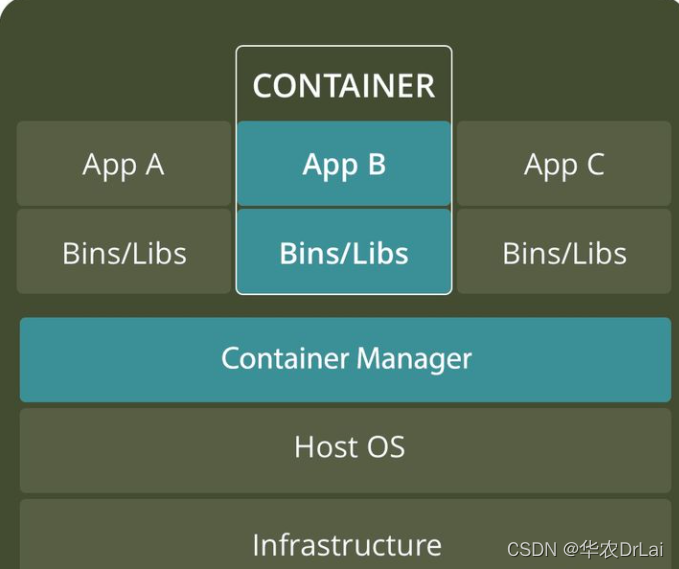

为什么人们会舍弃docker,转投K8S?

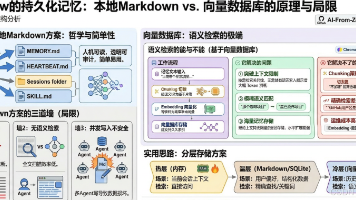

本文探讨了OpenClaw的持久化记忆系统原理及其优化方向。OpenClaw采用本地Markdown文件作为记忆存储,具有简单透明、可编辑的优势,但面临上下文窗口限制、检索效率低和并发写入问题。向量数据库虽能实现语义检索和海量存储,却存在chunking策略困难、精确检索不足和维护成本高的局限。作者提出分层存储的混合方案:热层(内存)处理当前会话,温层(Markdown/SQLite)存储结构化信

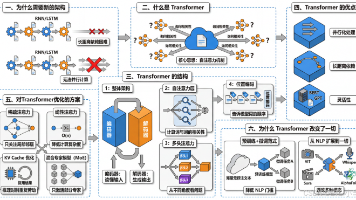

Transformer是一种革命性的神经网络架构,彻底改变了序列数据处理方式。相比RNN/LSTM,它通过自注意力机制解决了长距离依赖和并行计算问题,使模型能直接捕捉词间关系。其核心结构包括编码器-解码器、多头注意力和位置编码,具有并行化处理、长距离依赖捕捉和高度灵活性等优势。针对计算复杂度高的缺陷,业界提出了稀疏注意力、线性注意力、KV缓存和混合专家模型等优化方案。Transformer不仅确立

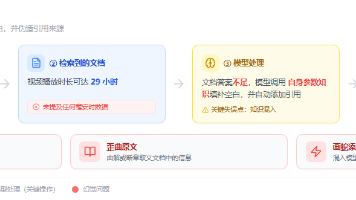

本文探讨了RAG(检索增强生成)系统中的幻觉问题及其解决方案。RAG幻觉指系统生成看似合理但实际与检索文档不符或缺乏依据的回答,这种"披着事实外衣的谎言"比传统LLM幻觉更具误导性。文章从检索层、理解层和生成层分析了幻觉成因,并提出混合检索策略、重排序模型、优化chunk切分等缓解方法。在引用溯源方面,介绍了chunk打标签、后处理验证等技术方案,以及inline标注、脚注引用

想象你开了一家新餐厅,开业第一天几乎没有顾客评价。这时候你该怎么办?是等着慢慢积累口碑,还是想个办法先让菜单看起来更诱人?推荐系统也面临同样的困境。一个推荐模型要训练得好,需要海量的用户行为数据——谁点了什么、看了什么、买了什么。但现实中,冷启动问题无处不在:新用户没有历史记录,新商品没有交互数据,小众品类样本稀疏。没有足够的数据,模型就像没有食材的厨师,再厉害的算法也做不出好菜。大语言模型(LL

想象一下,你走进一家书店。**传统推荐**就像一位经验丰富的店员。他记得你上次买了《三体》,所以推荐你买《流浪地球》;他看到很多买《百年孤独》的人也买了《霍乱时期的爱情》,于是把这两本书放在一起。这种推荐很精准,但有个问题——如果店里新到了一本小众的科幻小说,他无法立即推荐给你,因为他没有这本书的销售数据。

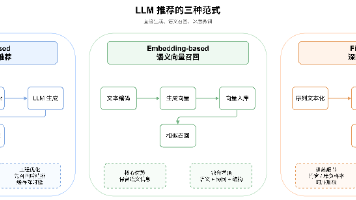

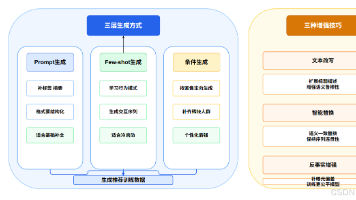

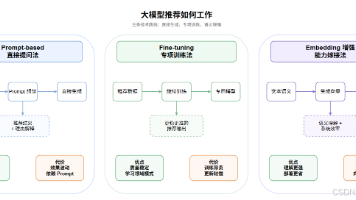

第一种:服务员直接问你"想吃什么",然后根据你的描述现场思考推荐(像Prompt-based)第二种:餐厅已经把所有菜品的特色标签化,快速匹配你的口味偏好(像Embedding-based)第三种:服务员跟你相处久了,记住了你每次来点的菜,越来越懂你的口味(像Fine-tuning)这就是大语言模型(LLM)做推荐的三种核心范式。随着ChatGPT的爆火,越来越多人开始探索:能不能让"懂一切"的L