简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Agent 之间再也不需要“记住对方的 URL 和 schema”;只需声明自己会做什么,系统就会自动调度你上场;出了问题,你能像调试微服务一样去追踪每一步的消息流转;DSL 中声明行为即可自动映射为 MCP 消息,无需写 glue code。这和传统“Agent 开发=写 API + 拼 prompt”的方式完全是两个时代的产物。Cangjie Magic 的智能规划器核心理念只有一句话:“给我

每一轮训练(Episode)就像一次“刷副本”,智能体一边探索环境、一边更新自己的大脑。DQN 就像给 Q-learning 装上了“大脑”,不再手动查表,而是通过神经网络自己学会如何评估每一个动作的价值。ε 一开始设得大一点,然后逐渐降低,比如从 1 降到 0.01,逐步让智能体从“瞎玩”变成“聪明玩”。训练时随机从这些“回忆”里抽样,打乱顺序训练,避免连续样本带来的偏差。每次训练就是在更新这个

摘要:OWASP发布的LLM应用十大安全风险列表(LLM Top 10)针对大语言模型应用的新型安全威胁提供了系统指南。该榜单包含提示注入、训练数据中毒、敏感信息泄露等10大关键风险,并提出了防御建议:重构prompt模板、输出无害化处理、最小权限设计等。作为AI应用安全设计的重要参考,该指南帮助开发者打造可信可控的LLM系统,助力安全思维在AI时代的落地实践。(149字)

Attention机制是深度学习中一种动态加权机制,它允许神经网络在处理语言时,能够自主判断哪些部分重要并优先考虑。最初应用于机器翻译,Attention机制让模型在输出时可以有选择性地参考输入的每一部分,从而解决了RNN在长段落中遗忘开头的问题。Self-Attention(自注意力机制)进一步增强了模型的上下文感知能力,让序列中的每个词在理解自身意义的同时,考虑整个句子中其他词的影响。Mult

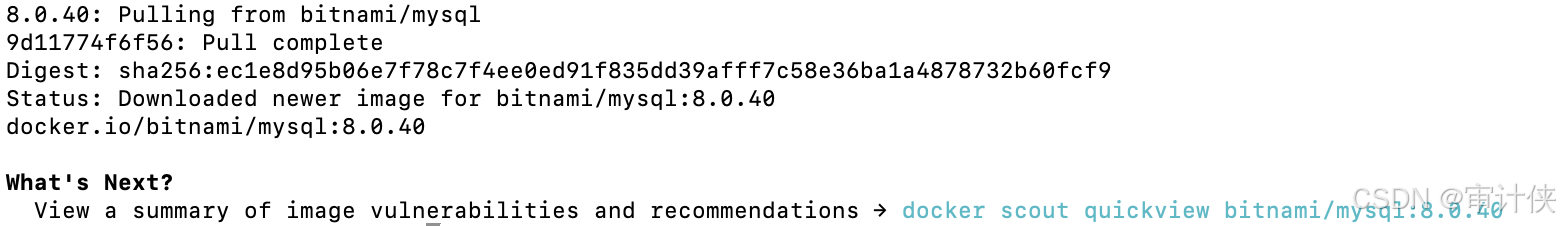

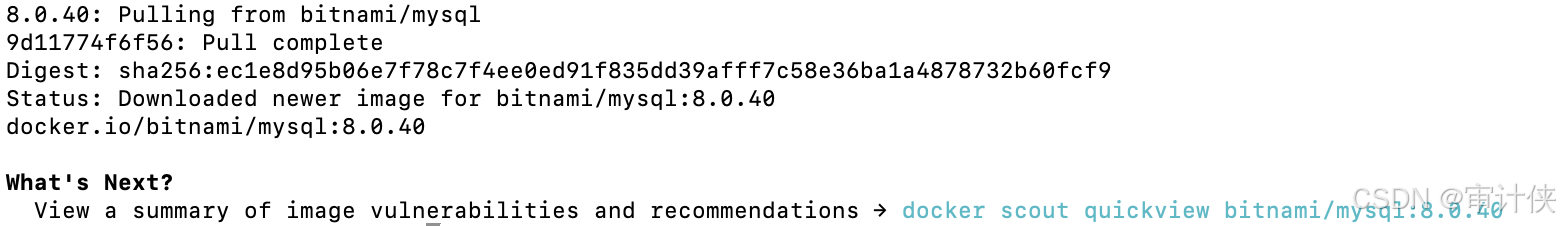

本文介绍了如何使用 Docker 部署 Bitnami MySQL 8.0.40 镜像,并提供了详细的步骤和配置说明。首先,通过 docker pull 命令拉取镜像,建议使用加速器提升下载速度。接着,创建持久化目录并通过 docker run 命令启动容器,配置了数据库的 root 密码、初始化数据库、用户及密码等环境变量,并挂载数据目录以实现数据持久化。文章还介绍了如何使用 DBeaver 客

JVM 是 Java 程序运行的灵魂,但当程序内存飙高、响应变慢或死锁卡死时,我们常常束手无策。这时候,就需要你掌握一套 JVM 原生命令工具箱。工具用途简述jps获取 Java 进程信息jstack获取线程调用堆栈jmap获取堆快照、对象统计jstat查看 GC、内存、类加载状态jinfo查看/调整 JVM 参数。

摘要: LLM在代码审计中的核心问题并非能力不足,而是缺乏系统化工作方法。裸跑LLM存在覆盖率低、幻觉高、优先级混乱等问题,本质是缺少资深审计员的流程化思维。解决方案是设计一套"审计协议"(Skill),将审计拆解为6阶段流水线:代码度量→侦察规划→分层审计→覆盖率门禁→规则沉淀→报告生成。该体系通过流程约束和状态持久化,将LLM的随机能力转化为可控的工程化输出,实现从&quo

LM Studio模型下载与管理本地推理(CPU / GPU)可视化聊天界面OpenAI 接口兼容 API 服务你可以把它看作 “” 的整合体 —— 完全图形化操作,极低门槛,上手即用。模块功能模型搜索与下载(支持 HuggingFace 模型)本地模型管理与运行💬 Chat图形化聊天界面⚙ Settings推理设置 / API Server 配置提供 OpenAI 接口兼容服务,支持 VSCo

本文介绍了如何使用 Docker 部署 Bitnami MySQL 8.0.40 镜像,并提供了详细的步骤和配置说明。首先,通过 docker pull 命令拉取镜像,建议使用加速器提升下载速度。接着,创建持久化目录并通过 docker run 命令启动容器,配置了数据库的 root 密码、初始化数据库、用户及密码等环境变量,并挂载数据目录以实现数据持久化。文章还介绍了如何使用 DBeaver 客