简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

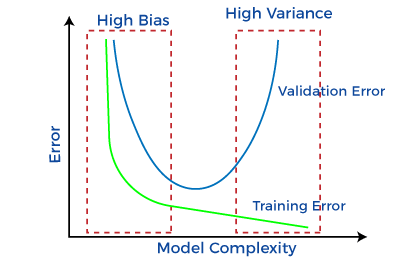

*****方差(Variance)**是什么?********在机器学习中,********方差通常指的是模型在不同训练数据集上性能(如准确率、损失等)的波动程度。********方差的计算方法是什么?****计算平均值(均值):计算所有预测值的平均值。计算每个预测值与平均值的差值:对于每个预测值,计算它与平均值的差。计算差值平方:将每个差值平方,以消除负值的影响。计算平方差的平均值:将这些平方差

目录引言:编码 AI 是新素养。第1章:职业成长的三个步骤。第2章:学习技术技能,成就有前途的人工智能职业。第3章:为了在人工智能领域找到工作你应该学习数学吗?第4章:界定成功的人工智能项目。第5章:寻找符合你职业目标的项目。第6章:构建显示技能进步的项目组合。第7章:启动你的人工智能职位搜索的简单框架。第8章:使用信息面试找到合适的工作。第9章:找到适合你的人工智能工作。第10章:构建人工智能职

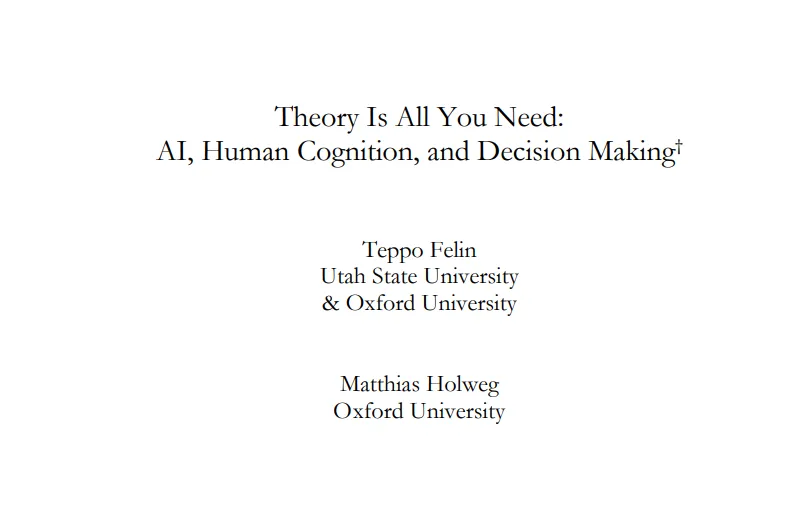

牛津大学发布了最新的报告《你所需要知道的理论:人工智能、人类认知与决策》。这份报告共53页,深入探讨了人工智能(AI)与人类认知及决策之间的关系,提出了一些深刻的观点和建议,对于理解AI的局限性和人类认知的独特性非常有帮助。这份报告由牛津大学的学者撰写。报告不仅分析了AI在认知任务上超越人类的现状,还强调了人类认知的“理论驱动”特性,即人类能够提出具有前瞻性的创新想法,而AI的学习模式严重依赖于历

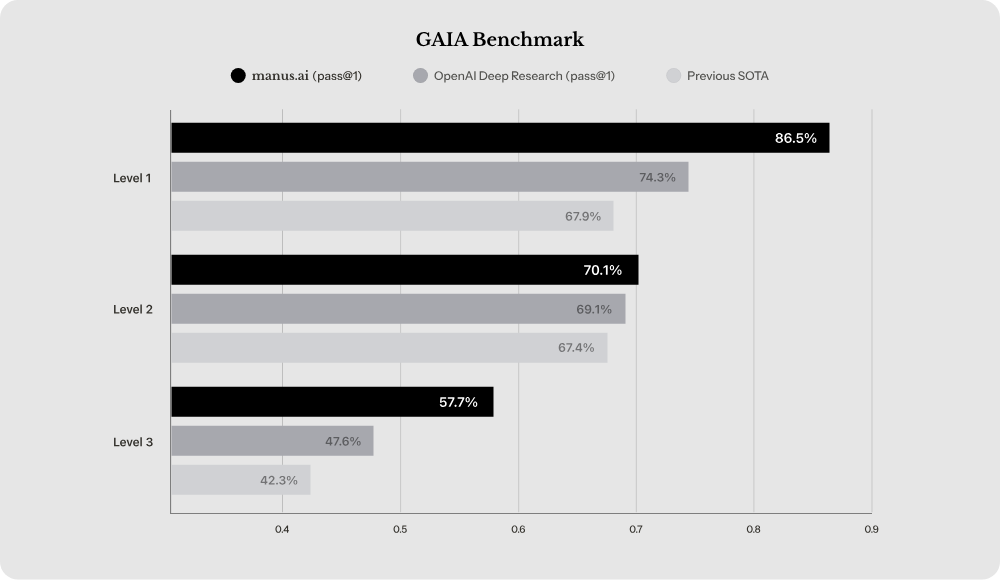

我想放一个视频:摄于2025年3月5日晚10点: Manus 发布之际此刻,中国团队在通用智能体赛道上,迈出了实质性的第一步。2025,东方破晓。

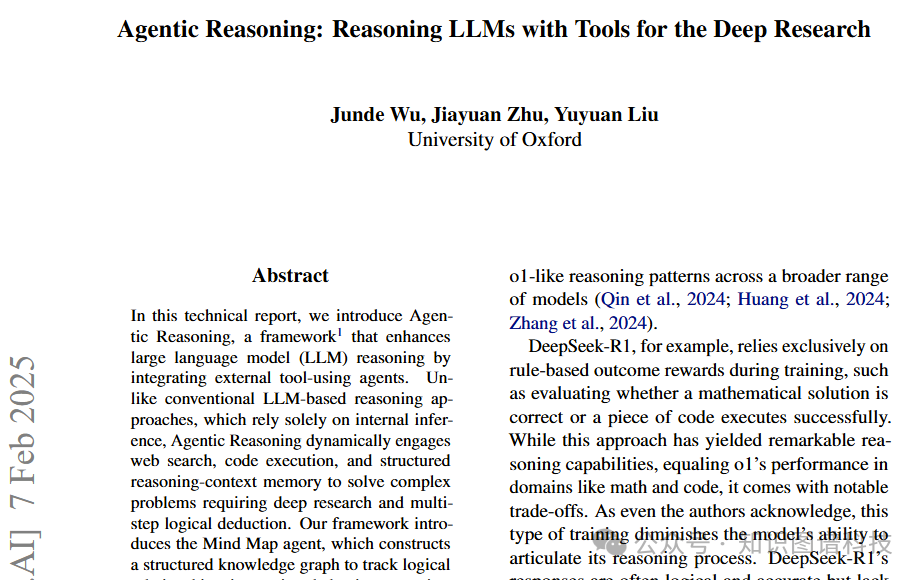

在这篇技术报告中,我们介绍了一种名为代理性推理的框架,该框架通过整合外部工具使用代理来增强大型语言模型(LLM)的推理能力。与仅依赖内部推理的传统基于LLM的推理方法不同,代理性推理动态地结合网络搜索、代码执行和结构化推理-上下文记忆来解决需要深度研究和多步逻辑演绎的复杂问题。我们的框架引入了思维导图代理,它构建了一个结构化的知识图谱来跟踪逻辑关系,从而提高演绎推理能力。此外,网络搜索和编码代理的

总的来说,AI可能会导致某些类型的工作减少,但同时也会创造新的工作机会。这种转变可能会要求劳动力市场进行重大的调整,包括对现有员工的再培训和技能提升,以及教育系统对新技能的培养。因此,AI带来的影响是复杂的,既有挑战也有机遇。社会、政府和企业需要共同努力,以确保平稳过渡并最大化AI带来的好处。。

大模型发展对算力需求激增,高端AI芯片是关键。大模型需千卡以上AI芯片构成的服务器集群支撑,高端芯片供不应求。GPT-4模型参数规模达1.9万亿,训练所需GPU数量较GPT-3增加近24倍。预计到2024年,我国企业5%—8%的大模型参数将从千亿级跃升至万亿级,算力需求增速达320%。定制化算力解决方案将成为趋势。随着摩尔定律放缓,一体化解决方案已难满足特定计算需求。为实现芯片最佳性能和效率,需针

目录引言:编码 AI 是新素养。第1章:职业成长的三个步骤。第2章:学习技术技能,成就有前途的人工智能职业。第3章:为了在人工智能领域找到工作你应该学习数学吗?第4章:界定成功的人工智能项目。第5章:寻找符合你职业目标的项目。第6章:构建显示技能进步的项目组合。第7章:启动你的人工智能职位搜索的简单框架。第8章:使用信息面试找到合适的工作。第9章:找到适合你的人工智能工作。第10章:构建人工智能职

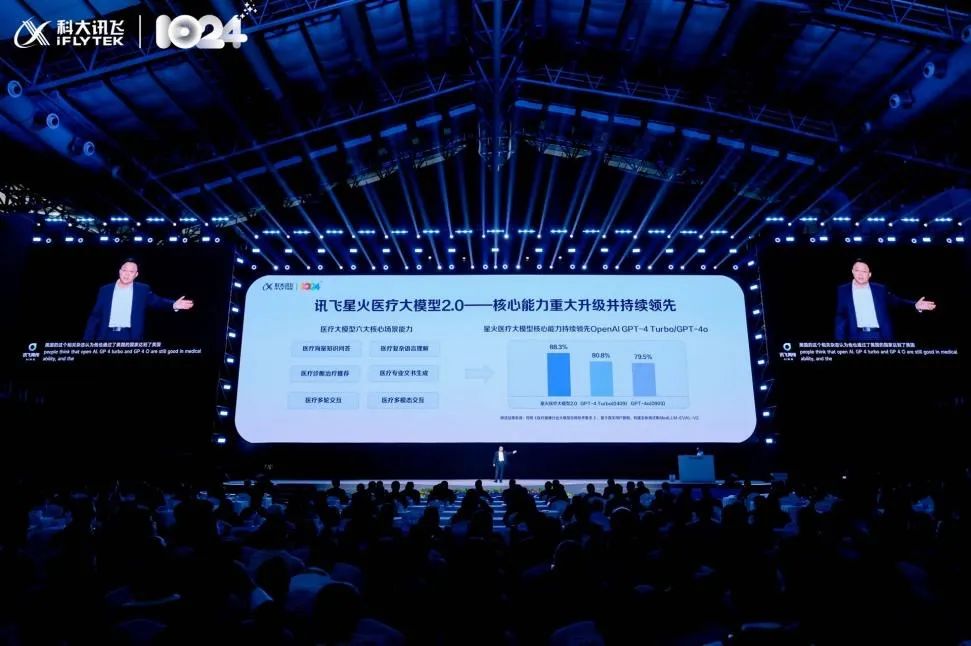

医疗大模型浪潮过去一年多来,大模型技术从最初的崭露头角到如今的遍地开花,市场竞争异常激烈。众多企业竞相布局,以强大的研发实力和资源储备为基石,力图在这片蓝海中占据一席之地。作为医疗人工智能领域的先行者,讯飞医疗在医疗大模型方面有着怎样的布局和实践呢?在第七届世界声博会暨2024科大讯飞全球1024开发者节上,刘庆峰表示,讯飞星火医疗大模型升级至2.0,在医疗海量知识问答、医疗复杂语言理解、医疗专业

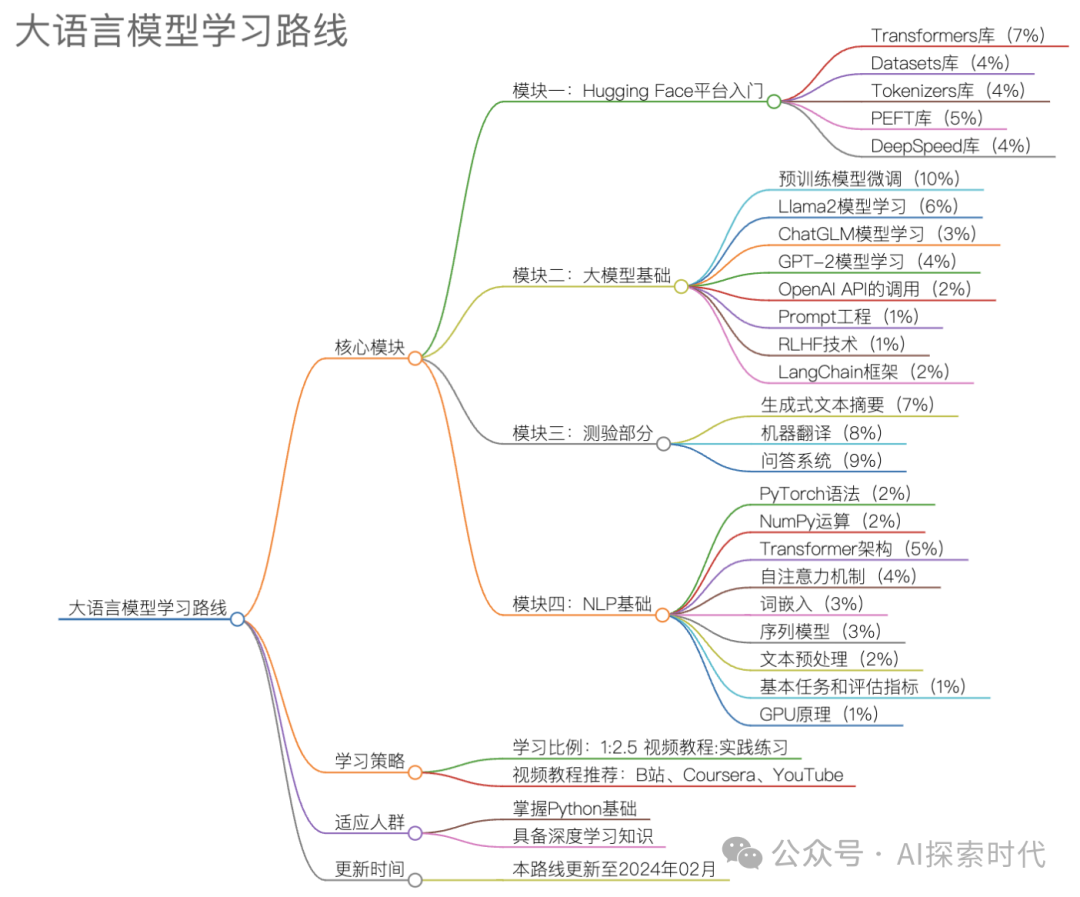

随着大模型技术的发展,越来越多的人开始进入大模型领域,但大模型作为一门技术,因此它的本质上是一个工具,因此这也让学习大模型有了不同的学习方向。从工具的角度来看,学习一个工具主要有两个方向,一个是使用工具,一个是制造工具;而今天我们主要讲的是后者,也就是怎么制造一个大模型工具,它需要哪些技术基础。大模型基础技术路线下面主要从以下几个技术基础讲解一下大模型的学习路线:理论基础编程