简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

**原理**: 使用深度神经网络(如LSTM、GRU、Transformer等)生成文本的向量表示,然后计算相似度。- **原理**: 使用Transformer模型,生成上下文相关的词向量表示,然后通过模型输出的向量计算相似度。- **原理**: 结合词频和逆文档频率,计算文本中词语的重要性,然后计算向量之间的余弦相似度。- **原理**: 基于BERT,专门用于生成句子的向量表示,然后计算句子

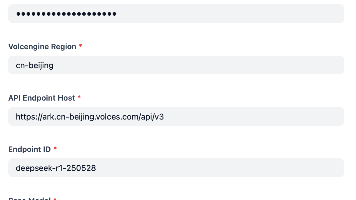

火山插件安装失败或配置不显示的解决方案:1)在线安装失败时可本地安装插件文件;2)确保只运行一个插件守护进程副本,避免写冲突;3)多租户环境下需为每个租户单独安装插件并配置API密钥(可与admin相同);4)注意保存配置才能生效。关键点:单进程运行、多租户独立配置、本地安装备选方案。

Oumi是一个完全开源的平台,可以简化基础模型的整个生命周期——从数据准备和培训到评估和部署。无论您是在笔记本电脑上开发,在集群上启动大规模实验,还是在生产中部署模型,Oumi都能提供您需要的工具和工作流程。🚀使用最先进的技术(SFT、LoRA、QLoRA、DPO等)将模型从10M到405B参数进行训练和微调。🌎在任何地方运行——从笔记本电脑到集群再到云(AWS、Azure、GCP、Lambd

工具:interpreter --local。输出:(输出最基本的结果,并提示进一步优化)输出:(每次输出的结果可能会不一样)2、显示数据文件内容。

代码解释器通常都需要在GPU的环境下使用原生的模型通过transformer来实现,且本身还需要模型本身支持,ollama本地蒸馏过的模型占用的资源比较小,也方便本地使用,但是如果想用这些模型的代码解释器,即让大模型写程序并执行,好像又没有提供必要的接口,我们可以使用open-interpreter来实现。计算对不对和模型也有一定的关系,有时候模型写的代码可能不对,导致结果不对。选择本地模型的提供

申请服务账号json格式key。

方法一:使用百度翻译apiimport requestsimport randomimport jsonfrom hashlib import md5def cntoen(query):# Set your own appid/appkey.appid = 'x'appkey = 'x'# For list of language codes, please refer to `https://a

•训练数据问题:大模型的训练数据多来自互联网,数据质量参差不齐,可能存在错误、偏见或不完整的情况,导致模型学习到不准确的信息。•模型架构与训练过程:大模型的复杂架构和训练方式,使得它在处理信息时更依赖于预训练阶段积累的知识,而容易忽略实时的上下文信息。•输入数据的多样性:不同的输入数据可能触发模型的不同响应模式,尤其在数据分布变化较大的情况下,模型的输出稳定性会受到影响。•训练过程中的随机性:大模

通过集成 MCP,你的 FastAPI 应用不仅能被传统客户端调用,还能与支持 MCP 的 AI 代理工具(如 Claude Desktop、Cursor 等)无缝对接,实现更智能的 API 交互。要让 FastAPI 应用支持 MCP(Model Context Protocol),可以使用 FastAPI-MCP 工具,它是一个零配置的工具,可以自动将 FastAPI 应用的端点暴露为 MCP

但“水电”毛利极薄。据第三方测算,在H100上跑开源Llama-3.3-70B,每1000次推理成本约0.013美元,而公开API报价0.02美元,毛利率仅35%左右,再扣掉运维、带宽、人力,基本无利可图。LLM厂商的终点不是“卖模型”,而是把模型变成通往算力、咨询与奢侈级服务的“流量入口”——现在亏掉的钱,只是为将来收更高的“税”铺路。结论:当大模型变成高端咨询的“锤子”,厂商就能摆脱Token