简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

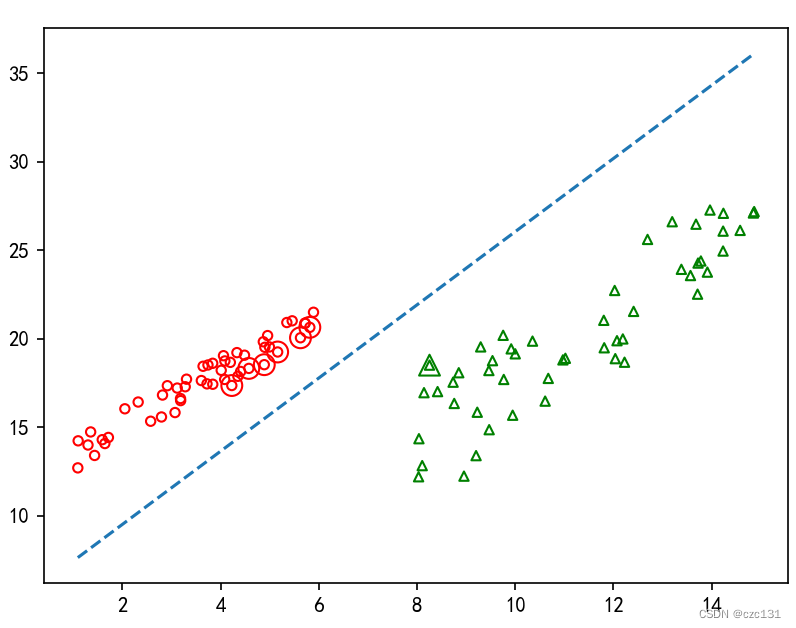

支持向量机(SVM)是机器学习中非常经典的一个模型,所以我就把这个作为第二个深入学习的机器学习模型,然后发现居然还挺难的(调包侠流下无能泪水)。参考了很多博客,但是大部分博客都是讲一部分,要么数学部分比较详细,要么后面的推导部分比较详细,本篇汇集了百家之长,其中我也尽量详细通俗给出了我的一些理解,特在此记录一下。其中可能存在一些错误,或者有些地方我也理解的不到位,在这些地方我都给出了参考博客,可以

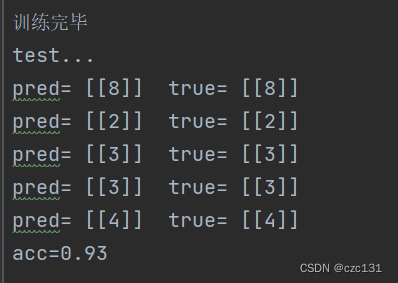

手写Minist识别是一个非常经典的问题,其数据集共有70000张28*28像素的图片,其中60000张作为训练集,剩下的10000张作为测试集,每一张图片都表示了一个手写数字,经过了灰度处理。本文延续前面文章提到的多层感知机,在这里完成更复杂的任务,这个也可以作为分类任务的代表。

一套面向“可学习、可扩展、可上线”的博客社区模板 CCBlog 正式开源!前后端分离,Vue3 + SpringBoot3 + Redis7 + Caffeine + RabbitMQ + MySQL8,Jmeter实测 500 并发 4000 QPS、0 错误。无限层级评论、WebSocket 实时聊天、AI 大模型 SSE 流式回答、Docker 一键部署全部开箱即用。项目文档完整,欢迎 St

一套面向“可学习、可扩展、可上线”的博客社区模板 CCBlog 正式开源!前后端分离,Vue3 + SpringBoot3 + Redis7 + Caffeine + RabbitMQ + MySQL8,Jmeter实测 500 并发 4000 QPS、0 错误。无限层级评论、WebSocket 实时聊天、AI 大模型 SSE 流式回答、Docker 一键部署全部开箱即用。项目文档完整,欢迎 St

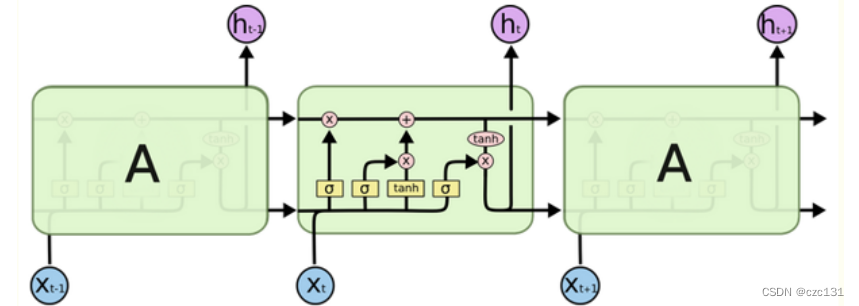

LSTM---长短期记忆递归神经网络是一个非常常用的神经网络,其特点在于该网络引入了长时记忆和短时记忆的概念,因而适用于一些有着上下文语境的回归和分类,诸如温度预测或是语义理解。从利用pytorch来构造模型的角度来看,该模型相比于一般的模型会有一些不同的地方,尤其是在参数的设置上,本文尝试以一个相对通俗的方式来解释本人的一些理解。

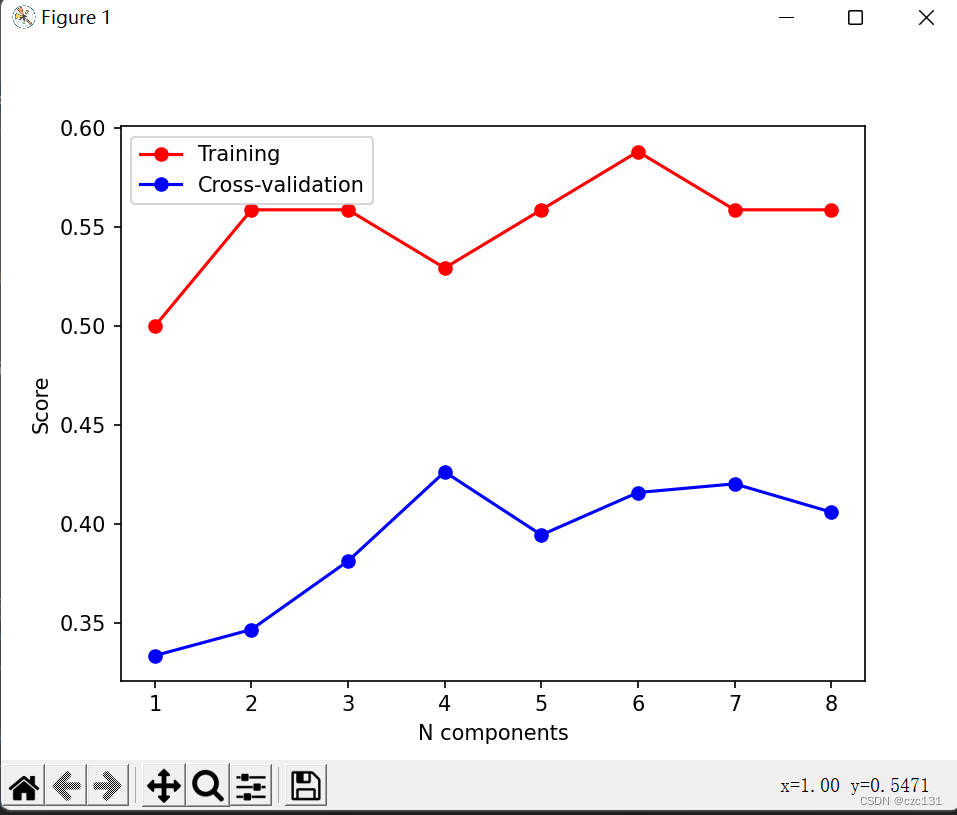

既可以用来分类,也可以用来降维,与PCA不同的是,PCA是无监督的,PLS-DA是有监督的。与PCA不同,PCA是无监督,PLS是“有监督”模式的偏最小二乘法分析,当样本组间差异大而组内差异小时,无监督分析方法可以很好的区分组间差异。反之样本组间差异不大,无监督的方法就难以区分组间差异。另外如果组间的差异较小,各组的样本量相差较大,样本量大的那组将会主导模型。有监督的分析(PLS-DA)能够很好的

下面就opencv的安装,ncnn的部署,模型的移植和一些关于模型的修改展开首先是numpy然后是opencv所需的依赖安装好依赖之后就可以下载opencv了需要下载Opencv和OpenCV_Contrib两个压缩包,链接如下,可能要打开好几次才能进去,我是尝试了好几次OpenCV:GithubOpenCV_Contrib:Github4.x代表四点几的版本,后面的tags是细分,可以自行选择,