简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文为AI应用开发新手提供实用入行指南,强调“先进去再补课”的策略。核心步骤包括掌握基础开发能力与AI概念、熟练常用工具与框架(如LangChain、FastAPI)、复现典型AI案例、将业务逻辑转化为技术方案,并推荐学习资源与社区。文章鼓励抓住AI时代机遇,实现职业跃迁,并附有完整学习资料领取方式。如果你想入行AI应用开发,听我一句——大胆投简历,别被那些“精通大模型底层原理”“两年AI经验”吓

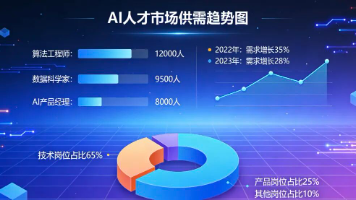

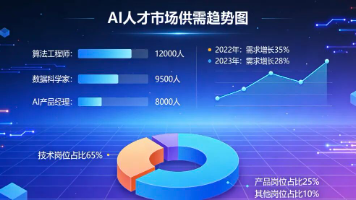

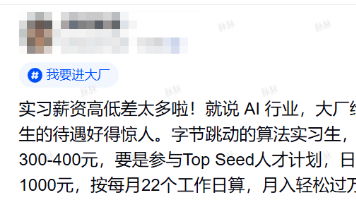

2026年的AI,早已不是泡沫,而是新质生产力的核心引擎,也是普通人、普通程序员实现薪资跃迁的最佳风口。很多人疑惑“为什么AI岗位月薪6万还招不到人”,答案其实很简单:这场用工荒,本质是“人才质量的荒”,不是“人才数量的荒”——企业缺的不是“会AI”的人,而是“能落地、能创造价值”的人。未来3-5年,AI人才依然是卖方市场,薪资只会持续走高。与其焦虑“AI会抢我的工作”,不如主动拥抱变化,成为驾驭

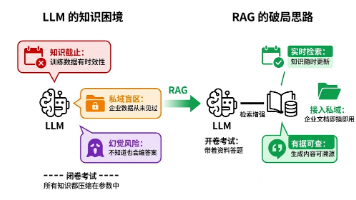

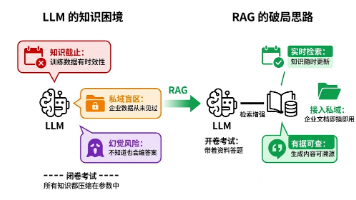

2026 年 AI 应用落地已成主流趋势,检索增强生成 RAG 作为当下大模型落地最常用技术,不管是零基础入行小白,还是转型 AI 方向的程序员,都必须吃透这项核心能力。本文全方位剖析 RAG 技术原理、运行流程,对比微调技术优劣,梳理技术短板与落地组合方案,帮大家系统掌握 RAG 核心逻辑,轻松应对学习与面试考核。

2026 年 AI 应用落地已成主流趋势,检索增强生成 RAG 作为当下大模型落地最常用技术,不管是零基础入行小白,还是转型 AI 方向的程序员,都必须吃透这项核心能力。本文全方位剖析 RAG 技术原理、运行流程,对比微调技术优劣,梳理技术短板与落地组合方案,帮大家系统掌握 RAG 核心逻辑,轻松应对学习与面试考核。

本文由大厂在职资深Agent开发工程师AgentGuide分享,结合招聘面经与实际工作需求,提供了一份系统的大模型应用开发学习路线。内容涵盖大模型基础、提示词工程、RAG检索增强生成、Agent智能体应用、工程实践及微调原理等六大模块,旨在帮助读者从浅入深掌握Agent开发技能,满足大厂岗位要求。对于想转行或求职Agent开发的同学,这是一份不可多得的参考资料。结合个人实际的工作内容和招聘市场对于

文章指出AI发展迅速,引发大众焦虑,但AI本身无好坏,关键在于使用方式。AI乱象背后是普通人入局的良机,行业薪资可观,前景广阔。零基础者可通过学习AI数据分析师等岗位进入该领域,抢占先机。文章鼓励大家抓住AI机遇,稳步前行。前段时间刷手机,估计大家都被AI圈的“神仙打架”给刷屏了吧?从能走路、会互动的人形机器人,到突然爆火、各种玩法层出不穷的AI小龙虾openclaw,这波AI发展的速度,说句“一

我一个在字节的朋友跟我说,他们现在面试,

2026年春招AI赛道,确实很难。但难的不是只有你一个人,无论是留学生、小白,还是程序员,都在面临竞争和挑战。一位大厂HR的话很有启发:“不是春招变难了,是以前太容易了。前几年,只要是个大学生,稍微培训一下就能上岗;现在企业更看重投入产出比,你得来了就能干,不是坑少了,是你得证明自己值得那个坑。对于留学生来说,你的优势从来不是一张名校文凭,而是在海外独自面对陌生环境的韧性,是在多元文化中沟通协作的

2026年春招就业市场的竞争依旧白热化,千军万马挤独木桥的场景在各大招聘会场随处可见,但与之形成鲜明对比的是,AI大模型相关岗位迎来“爆发式扩招”,成为春招市场中最耀眼的“香饽饽”。无论是互联网大厂、科技巨头,还是新能源、金融、医疗等跨界企业,都在疯狂争抢大模型相关人才,相关岗位量同比暴涨超12倍,尤其适合想入门大模型、转型AI领域的程序员和零基础小白,抓住风口就能实现职业跃迁。

2026年的AI,早已不是泡沫,而是新质生产力的核心引擎,也是普通人、普通程序员实现薪资跃迁的最佳风口。很多人疑惑“为什么AI岗位月薪6万还招不到人”,答案其实很简单:这场用工荒,本质是“人才质量的荒”,不是“人才数量的荒”——企业缺的不是“会AI”的人,而是“能落地、能创造价值”的人。未来3-5年,AI人才依然是卖方市场,薪资只会持续走高。与其焦虑“AI会抢我的工作”,不如主动拥抱变化,成为驾驭