简介

全民程序员们,大家好,我是练习时长两年半的,个人程序员D枫,喜欢java、c#、golang 、h5。键盘来。。。。。

擅长的技术栈

可提供的服务

暂无可提供的服务

最后简单总结一下吧,今天和大家完整分享了:基于 Dify 原生工作流、模型编排和 API 对接能力,再搭配 EdgeOne Pages 全场景模板,从零手把手完成了智慧航道行业 AI 助手的搭建,并且一键部署到全球公网,全程跑通了从 0 到落地的完整流程。整个体验下来特别省心: Dify 不用自己写复杂代码,可视化拖拽就能搭业务工作流、配大模型、接业务接口,垂直行业 AI 应用门槛直接拉低,运维、

本文分析了鸿蒙码字软件开发中正文无法换行的常见问题,指出其根源在于系统默认键盘避让模式与底部标点栏的布局冲突。通过修改键盘避让模式为RESIZE、优化布局结构(正文区使用权重布局)和动态监听输入法高度,可实现标点栏与输入法的完美适配。文章还总结了开发者易犯的四个错误:未修改键盘避让模式、设置固定高度、使用固定定位以及未监听输入法高度变化,为开发者提供了完整的解决方案和避坑指南。

本文分析了鸿蒙码字软件开发中正文无法换行的常见问题,指出其根源在于系统默认键盘避让模式与底部标点栏的布局冲突。通过修改键盘避让模式为RESIZE、优化布局结构(正文区使用权重布局)和动态监听输入法高度,可实现标点栏与输入法的完美适配。文章还总结了开发者易犯的四个错误:未修改键盘避让模式、设置固定高度、使用固定定位以及未监听输入法高度变化,为开发者提供了完整的解决方案和避坑指南。

摘要:国产数据库选型需以业务需求为核心,避免盲目跟风。首先明确业务场景(交易、分析或混合)、数据特征(量级、类型)、合规要求和成本预算。其次关注技术指标,如兼容性、高可用性、安全性和性能。主流产品各有侧重,如达梦、人大金仓适合政务系统,华为高斯DB适合高并发场景。选型后需进行小范围测试、评估生态支持并制定分阶段迁移计划,同时加强团队培训。避开只看名气、忽视生态等常见误区,通过系统性评估找到最适合的

友友,大家好呀。作为深耕Web开发领域的技术博主,近期我将部分开发系统迁移至腾讯云EdgeOne。经过一段时间的实测体验,本文将从真实体验出发,还原这款产品的真实面貌,力求客观公正。

开始之前,我们先来简单了解一下什么是CNB呢?官方说法是CNB 致力于实现“一切皆代码云原生构建”,它利用 Docker 生态对环境、缓存、插件等进行抽象,通过声明式的语法,帮助开发者以更酷的方式构建软件。其主要特点包括声明式语法、资源池化、高效的构建环境与缓存管理、Docker 作为运行环境、基于 Docker 生态的插件以及按需快速获取资源等。总结起来就是可以提供高效且灵活的软件开发环境,管理

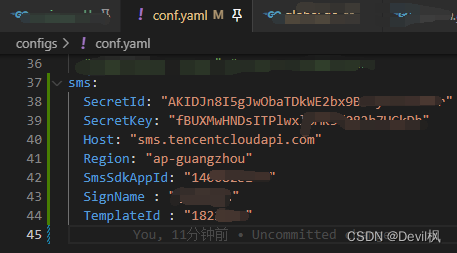

最近在做短信平台,目前测试了一下腾讯云的短信平台,把目前测试的可行调用的方式记录一下。这篇是通过go实现。

RTX 4090显卡凭借第四代Tensor Cores和24GB GDDR6X显存,在深度学习领域展现出卓越性能。通过FP8混合精度计算,其算力可达1.32 PetaFLOPS,相比RTX 3090提升87%,训练效率翻倍。24GB大显存支持7B参数的LLaMA 2等中等规模模型加载,显著提升批处理能力。在计算机视觉、自然语言处理和生成式AI等场景中,RTX 4090表现优异,推理速度较RTX 3

文章摘要 本文以华为鸿蒙生态核心语言仓颉为例,从基础计算、数据结构、特性应用三个维度展开编程教学。基础计算部分通过圆周率估算和干支纪法案例,讲解变量声明、循环控制等语法;数据结构部分演示类和枚举两种方式实现二叉树,体现面向对象和值类型特性;特性应用部分展示枚举关联值实现代数计算等高级功能。全文通过典型案例解析,帮助开发者快速掌握仓颉语言的核心语法与应用技巧,实现从入门到进阶的学习目标。

鸿蒙系统USB设备管理API解析与实战指南:本文深入介绍了鸿蒙系统(HarmonyOS)的USB设备管理功能,重点解析了ohos.usb模块的核心API,包括UsbManager、UsbDevice等关键类。文章详细阐述了设备连接与断开的完整处理流程,涵盖权限申请、事件监听、资源管理等关键环节,并提供了实战开发中的注意事项。内容涵盖设备兼容性检查、数据传输方法选择、权限管理等技术要点,帮助开发者快