简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

市面上 Agent 算法越来越强,但算法强≠能落地,文字精准≠场景有用。文字 Agent 困在文字 Demo,适配不了真实场景;具身 Agent 补齐具象能力,适配政务 / 车机 / 门店等全场景。真正的 Agent 价值,从来不是文字精准度,而是能走进真实场景、解决业务痛点、规模化落地。魔珐星云链接: https://xingyun3d.com/?熬夜磕代码丶原文链接:https://blog.

市面上 Agent 算法越来越强,但算法强≠能落地,文字精准≠场景有用。文字 Agent 困在文字 Demo,适配不了真实场景;具身 Agent 补齐具象能力,适配政务 / 车机 / 门店等全场景。真正的 Agent 价值,从来不是文字精准度,而是能走进真实场景、解决业务痛点、规模化落地。魔珐星云链接: https://xingyun3d.com/?熬夜磕代码丶原文链接:https://blog.

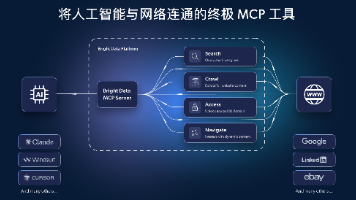

以前要做跨平台商品比价,要么自己写爬虫、租代理、折腾反爬,要么维护好几套脚本累死人。各平台经常改版,光修解析就能把人耗光。自建爬虫的成本不在“写代码”,而在“长期维护反爬”。Bright Data + MCP 的价值在于:把最难、最不稳定的部分(代理、解锁、解析)完全外包,让你只关注数据本身。接入:专门做采集的基础设施,反爬、代理、解析全交给它,你只管拿结果。配一个 Skill(SKILL.md)

以前要做跨平台商品比价,要么自己写爬虫、租代理、折腾反爬,要么维护好几套脚本累死人。各平台经常改版,光修解析就能把人耗光。自建爬虫的成本不在“写代码”,而在“长期维护反爬”。Bright Data + MCP 的价值在于:把最难、最不稳定的部分(代理、解锁、解析)完全外包,让你只关注数据本身。接入:专门做采集的基础设施,反爬、代理、解析全交给它,你只管拿结果。配一个 Skill(SKILL.md)

在当今的数字化浪潮中,数据被视为一种极具价值的资源,类似于传统工业时代的石油,它为企业挖掘出深邃的洞察力,并成为决策过程中不可或缺的基石。随着技术的不断演进,数据管理的策略与架构也经历了显著的变革,从早期的数据仓库模式,逐步迈向集成化的数据中台架构,并朝着更加动态灵活的数据飞轮体系迈进。

如今互联网发展十分迅速,有很多企业为满足自身业务的需求,对搭建一台稳定、高效的云服务器的要求越来越高。虽说国内云服务器层出不穷,比如阿里云、腾讯云、华为云等比较主流的云服务,然而有很多企业也有许多国外的的业务需求,所以对搭建海外服务器的需求也越来越多,海外服务器有很多,如何选择一个可靠的海外云服务器非常重要。亚马逊云科技推出的轻量应用服务器在选择上性价比还是很高的,它在全球范围内部署啦多个数据中心

Amazon EC2 云服务器不论是在速度上、稳定性以及灵活性,都给我了非常好的体验,让我更加坚定不移地选择它,并且我个人认为Amazon EC2 云服务器可以说是当前行业内的首选产品。

随着人工智能技术的不断演进,多模态大模型已是当下比较热的研究方向,它可以同时理解和生成多种输入和输出模态,如文本、图像、语音等,能够更好地模拟人类的多感知能力,给文档图像的分析处理带来了新的机遇和挑战!近期,中国模式识别与计算机视觉大会在厦门举办,是国内顶级的模式识别和计算机视觉领域学术盛会。大会汇聚了国内国外模式识别和计算机视觉理论与应用研究的广大科研工作者及工业界同行,分享我国模式识别与计算机

百度发布文心快码AI IDE,实现设计稿一键转代码功能。该工具可将Figma设计稿高还原度转化为前端代码,并提供自然语言调整功能,节省80%重复劳动。内置智能体Zulu能自主拆解任务需求,支持中文自然语言理解,适配国内开发场景。工具还支持MCP对接外部工具,提供全流程AI辅助编程。测试显示,文心快码生成的代码在百度日新增代码中占比超43%,显著提升开发效率。该工具降低了编程门槛,从新手到专业开发者

之前被各大平台封到怀疑人生,到一套工作流打通 TikTok、LinkedIn多平台采集,不需要再为每个网站单独写一套爬虫,也无需操心代理池和验证码。Dify Workflow 替代多套独立爬虫,Bright Data MCP 帮我搞定所有封锁问题。立即免费注册 Bright Data,可以免费获取$20额度,5 分钟内搭建你的多平台数据采集流水线,只为成功采集的数据付费。# 前言。