简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍了使用MAISI-v2模型生成3D脑部MRI图像的过程。作者针对脑部肿瘤分割任务中样本不足的问题,尝试了基于Latent Rectified Flow的生成方法。相比传统DDPM,该方法将推理时间从11分钟缩短至22秒,速度提升30倍。文章详细分析了3D医学图像生成的三大难点:显存占用大、各向异性体素处理困难、条件控制不精确,并介绍了MAISI-v2通过潜在空间扩散、体素尺寸条件输入和区域

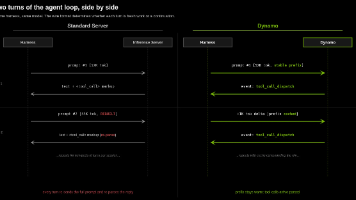

本文探讨了NVIDIA Dynamo在多轮Agent交互中的关键技术改进。通过剥离会话相关的计费header恢复KV缓存复用,使TTFT降低约5倍;优化推理与工具调用的解析逻辑,确保交错内容在跨轮次交互中保持正确顺序;实现工具调用的流式派发,提升用户体验。实验基于Nemotron-3-Super-120B模型,展示了Dynamo在保持正确性的同时显著提升性能的能力。这些改进使Agent客户端能够更

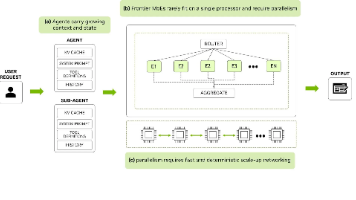

NVIDIA Vera Rubin平台通过软硬件协同设计解决Agentic AI的规模化难题。该平台结合Vera Rubin NVL72的高吞吐计算能力和Groq 3 LPX的低延迟执行能力,专门针对Agentic推理中非确定性轨迹、长上下文和多工具调用等挑战。其核心技术包括高radix点对点连接、编译器调度数据移动和硬件驱动的近同步时序,可显著降低跨芯片通信的不确定性,改善尾延迟问题。开发者需关

NVIDIA推出Verified Agent Skills治理机制,为AI Agent能力层建立信任体系。该方案将Skill从简单说明文件升级为可发布、可扫描、可签名的软件资产,包含加密签名、风险扫描、能力声明等关键元数据。通过Skill Card实现机器可读的信任记录,支持来源验证、完整性检查和安全策略执行。这套机制解决了Agent能力扩展中的透明度问题,使企业能够在加载前对Skill进行治理,

Codex、Claude Code、OpenCode、LangChain Deep Agents 这类 Agent harness 很擅长编排:它们能维持会话、调用工具、执行代码、修改文件,并把用户意图拆成连续步骤。但当任务进入 deep research 范围时,复杂度会迅速从“调用几个工具”升级为“构建一条完整研究流水线”。

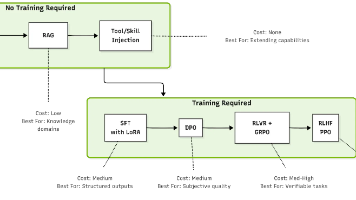

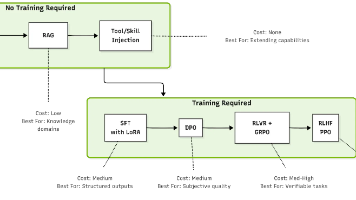

AI Agent 定制技术全景与实践路径 本文系统梳理了AI Agent定制的九类关键技术,包括从轻量级的提示词工程到深度强化学习等不同方法。文章指出,企业需要根据任务特点、资源条件和项目成熟度选择适合的定制路线,使通用AI模型能够真正适配特定业务场景。核心定制方法包括:提示词工程解决行为塑造问题,RAG补充知识缺口,工具/技能注入扩展行动能力,监督微调优化特定任务表现等。文章强调,有效的Agen

AI Agent 定制技术全景与实践路径 本文系统梳理了AI Agent定制的九类关键技术,包括从轻量级的提示词工程到深度强化学习等不同方法。文章指出,企业需要根据任务特点、资源条件和项目成熟度选择适合的定制路线,使通用AI模型能够真正适配特定业务场景。核心定制方法包括:提示词工程解决行为塑造问题,RAG补充知识缺口,工具/技能注入扩展行动能力,监督微调优化特定任务表现等。文章强调,有效的Agen

在人工智能快速发展的今天,下一代AI驱动的机器人,如人形机器人和自动驾驶汽车,都依赖于高保真、物理感知的训练数据。然而,如果没有多样化且具代表性的数据集,这些系统将无法获得适当的训练,并在测试中面临诸多风险:泛化能力差、对真实世界变化的适应有限、在边缘情况下行为不可预测等。而收集大规模真实世界数据集不仅成本高昂,还极其耗时,且常常受到现实可能性的限制。NVIDIA Cosmos通过加速世界基础模型

重排模型(Reranker)是一种特殊类型的神经网络模型,专门用于评估查询(query)和文档(document)之间的相关性。与嵌入模型(Embedding Model)不同,重排模型不会将文本转换为向量,而是直接输出一个相关性得分。这使得重排模型能够捕捉到更细微的语义关系,提高搜索结果的质量。# 自定义数据集示例# 准备数据"query": ["如何训练重排模型?", "深度学习入门教程",

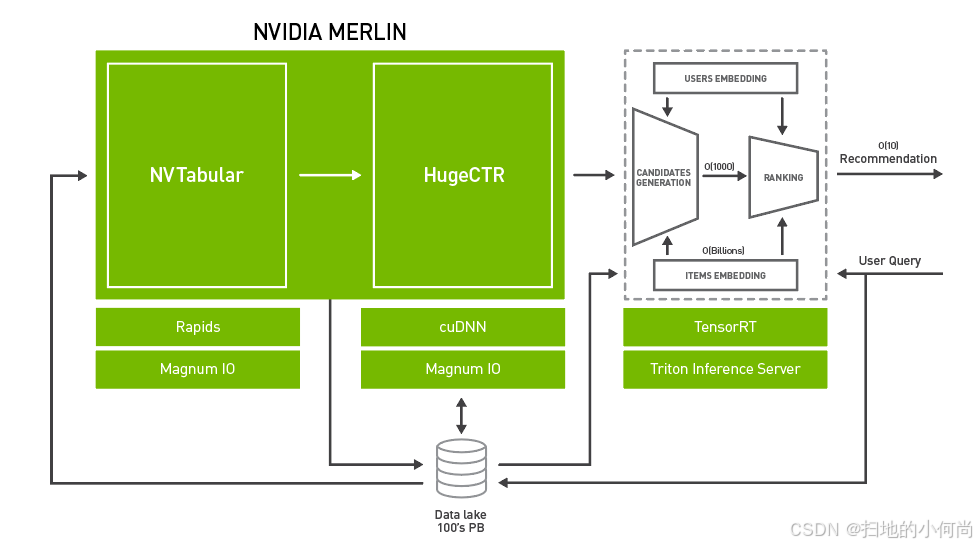

NVIDIA Merlin是一个开源库,旨在加速NVIDIA GPU上的推荐系统。该库使数据科学家、机器学习工程师和研究人员能够大规模构建高性能推荐系统。Merlin包含了解决常见特征工程、训练和推理挑战的工具。Merlin流水线的每个阶段都经过优化,可支持数百TB的数据,所有这些都可以通过易于使用的API访问。NVIDIA Merlin是一个强大的开源库,专为在NVIDIA GPU上加速推荐系统