简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Transformer通过注意力机制和多头注意力彻底改变了自然语言处理,使模型能并行处理序列数据并捕捉长距离依赖。相比LSTM等传统模型,其训练速度更快、效果更好,成为现代大语言模型的基础。通过Hugging Face等平台,开发者可轻松使用预训练模型进行微调,实现零样本和小样本学习。尽管存在计算成本高和专业领域精度不足等限制,Transformer依然是当前最具实用价值的架构。

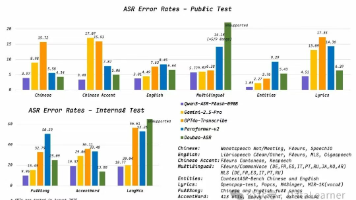

阿里发布语音识别大模型Qwen3-ASR-Flash,错误率低于GPT-4o和Gemini,支持11种语言及多种方言。最大特点是支持Prompt增强,通过文本输入提高专有名词识别准确率。模型仅通过API提供,按音频时长收费,基于未开源的Qwen3-Omni构建,展现了阿里在语音识别领域的技术实力。

本文详细介绍了如何使用Coze平台和DeepSeek模型搭建AI智能客服系统,无需编程基础。教程包括注册账号、生成问答库、创建知识库、设置智能体和工作流节点,以及调试发布等完整流程。通过详细步骤和截图指导,帮助读者快速实现专业级AI客服,降低客服人力成本,提升用户体验。

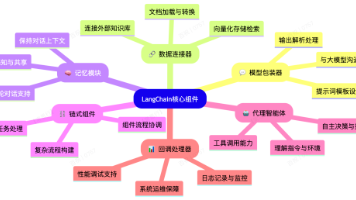

本文详解使用LangChain构建智能客服系统的六大核心组件:模型包装器处理输入输出,数据连接器实现知识库检索,记忆模块维持对话上下文,链组件协调工作流程,代理处理复杂任务,回调监控系统性能。通过这些模块化组件的组合,开发者可像搭积木一样构建适合业务场景的AI客服应用,即使是小白也能轻松上手。

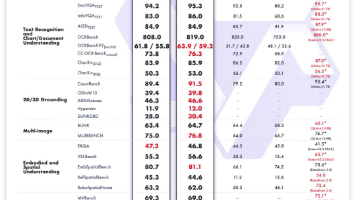

本文详细介绍了多模态大模型Qwen3-VL的本地部署与使用方法,包括模型选择、安装配置、运行参数设置等。重点推荐24G显存下部署Qwen3-VL-8B-Thinking模型,并详细阐述了其视觉编码增强、空间感知、长上下文理解等核心功能。文章提供了完整的安装步骤和运行指南,帮助读者快速上手这一先进的多模态大模型。

文章详细介绍如何使用Coze平台和DeepSeek模型搭建AI智能客服系统,包括创建售前问答库、设计智能体工作流(意图识别、问题处理、知识库检索等节点)、调试发布以及API集成到业务系统的完整流程。通过可视化操作即可完成,无需复杂编程,适合小白快速上手,为业务提供24小时智能客服解决方案。

LLM用在车机上,就是人机智慧问答,这是比较触手可及的。2、用在自动驾驶系统,比如理想VLA下一代自动驾驶架构,使用LLM作为基座模型,融合空间视觉和人类语言理解。3、用在车辆智能故障诊断和故障预测。现代车辆,特别是融合计算机系统的软件定义车辆,完全可以说是轮子上的智能计算机,车主或者驾驶员作为用户,很难理解各种原理和术语,只能用模糊描述的人类语言描述问题,车载大语言模型再转换为内部的技术语言来定

到这里为止,我们已经学会了:1、使用sentencepiece训练一个中文的词表。2、使用transformers加载sentencepiece模型。3、怎么合并中英文的词表,并使用transformers使用合并后的词表。4、在模型中怎么使用新词表。因为这个行业不同于其他行业,知识体系实在是过于庞大,知识更新也非常快。作为一个普通人,无法全部学完,所以我们在提升技术的时候,首先需要明确一个目标,

前面我们已经讲过怎么构建中文领域的tokenization:接下来我们将介绍继续预训练。我们新增加了一些中文词汇到词表中,这些词汇是没有得到训练的,因此在进行指令微调之前我们要进行预训练。预训练的方式一般都是相同的,简单来说,就是根据上一个字预测下一个字是什么。为了方便起见,我们这里直接使用IDEA-CCNL/Wenzhong2.0-GPT2-110M-BertTokenizer-chinese模

本文是一篇从零开始构建小型大语言模型的实践教程,通过分步详解Tokenizer设计、Embedding表示、Attention机制实现、Transformer结构搭建等关键环节,帮助读者理解大模型底层原理。文章以代码为主线,从简单的字符替换到完整的概率模型构建,展示了如何通过训练使模型从输出乱码到学会说话,最终实现一个具备基本对话能力的LLM,帮助开发者打破对大模型的神秘感。