简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍了如何基于Qwen1.5-7B-Chat模型构建个人语言助手。首先指导安装必要的Python依赖包(transformers、bitsandbytes等),并配置GPU加速。详细说明了模型的加载过程,包括尝试4位和8位量化以优化内存使用。文章提供了代码示例展示如何设置系统提示、管理对话历史记录,以及实现响应生成功能。通过tokenizer处理输入,使用温度采样控制输出多样性,最终实现了一个

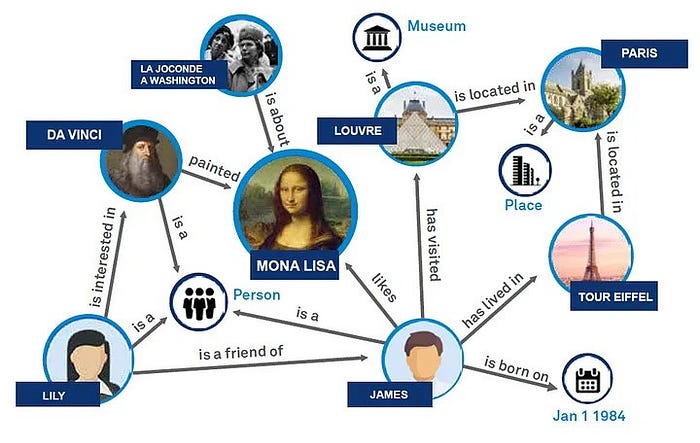

编者注:以下是 Tomaz Bratanic 的博客文章,他专注于 Neo4j的 Graph ML 和 GenAI 研究。Neo4j 是一家图形数据库和分析公司,帮助组织深入、轻松、快速地发现数十亿数据连接中隐藏的关系和模式。图检索增强生成(Graph RAG)正在蓬勃发展,并成为传统矢量搜索检索方法的强大补充。这种方法利用图数据库的结构化性质,将数据组织为节点和关系,以增强检索信息的深度和上下文

2023年3月份,中共中央、国务院印发了《数字中国建设整体布局规划》(以下简称《规划》)。该《规划》明确指出,建设数字中国是数字时代推进中国式现代化的重要引擎。数字中国的建设和大目标的达成,人工智能是重要的技术、工具和底座平台。随着ChatGPT和GPT-4这两个知名大模型的发布,让大模型迅速成为行业爆点,重新点燃了全球对通用人工智能的热情。全球主要国家和地区都开始致力于大模型的研发、应用和推广。

这篇文章介绍了如何安装和配置AI相关工具链,主要包括三个部分:1. 使用Ollama安装deepseek-r1:7b语言模型,建议配置大于1.5b;2. 安装bge-m3向量模型,用于汉字向量化转换;3. 通过Docker安装Milvus向量数据库单机版,并配置自定义网络icontainer以便与可视化工具attu通信。文章提供了详细的命令行操作步骤,包括修改安装脚本、创建网络和端口映射等操作,帮

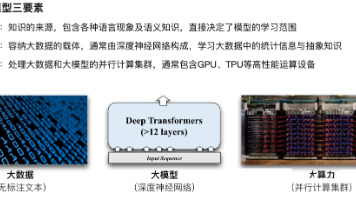

详细介绍了先进的深度学习模型,包括Transformer、GPT系列、深度生成模型,从基本架构、训练方法到特定应用,包括但不限于Seq2Seq结构、位置编码、注意力机制、残差连接、变分自编码器、GAN、ViT、CLIP、Stable Diffusion、各模型训练实践的知识点。此外,探讨了预训练模型的涌现能力、模型参数和通信数据量的估算,以及分布式训练的各种技术,如数据并行、模型并行和混合精度训练

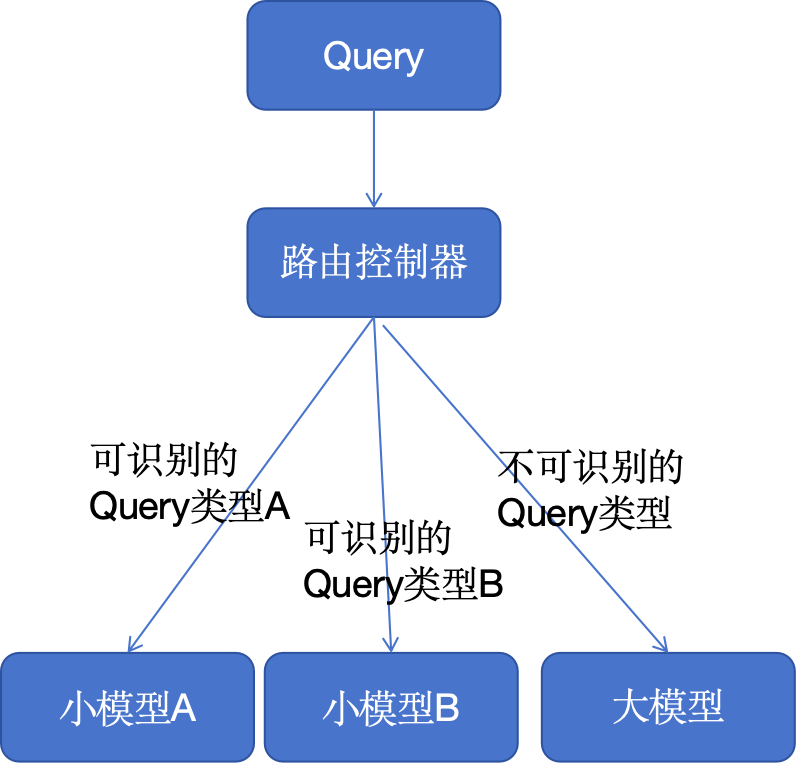

在塑造新领域的过程中,我们往往依赖于一些经过实践验证的策略、方法和模式。这种观念对于软件工程领域的专业人士来说,已经司空见惯,设计模式已成为程序员们的重要技能。然而,当我们转向大模型应用和人工智能领域,情况可能会有所不同。面对新兴技术,例如生成式AI,我们尚缺乏成熟的设计模式来支撑这些解决方案。作为一位老码农,我在这里整理总结了一些针对大模型应用的设计方法和架构模式,试图应对和解决大模型应用实现中

在Ubuntu系统下部署大语言模型,可以使用Hugging Face的Transformers库来加载和使用预训练的模型。

Large Language Model (LLM) 即大规模语言模型,是一种基于深度学习的自然语言处理模型,它能够学习到自然语言的语法和语义,从而可以生成人类可读的文本。所谓"语言模型",就是只用来处理语言文字(或者符号体系)的 AI 模型,发现其中的规律,可以根据提示 (prompt),自动生成符合这些规律的内容。LLM 通常基于神经网络模型,使用大规模的语料库进行训练,比如使用互联网上的海量

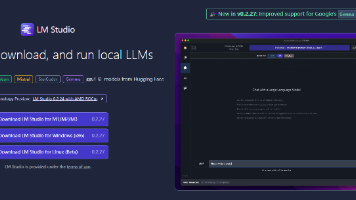

OpenAi 发布 ChatGPT 对话性大语言模型,AI 这两年发展迎来爆发,国内外也衍生了大量的语言模型开放给公众使用。为了可以让更多人接触到AI,让本地化部署更加轻便快捷,于是就有了Ollama、LM Studio等可以在本地部署模型的工具。相比之下,ollama 需要通过命令进行安装,下载模型,以及对话, 如果需要 web 界面,可搭配 open-webui 进行配套使用,整套流程下来虽算

大语言模型(Large Language Models,简称LLMs),是一类基于深度神经网络构建的先进AI系统,其核心特征是包含百亿级甚至千亿级参数,通过自监督学习在海量无标注文本(如书籍、网页、论文等)中训练而成。