简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

中国经济与科技快速发展,带来的是产业结构不断优化调整,而产业结构的调整与洗牌则是代表各行业对市场人才的不同,比如IT、人工智能、机器人、电子信息等行业,市场人才需求大,相关专业毕业生易就业。那么,你知道吗?中国人才紧缺的4个大学专业是哪几个吗?随着5G商用、电动车、物联网、消费电子等产业的快速发展,市场对集成电路产业需求量激增。据数据统计:2024年全球集成电路市场规模达到1800多亿美元,中国是

大模型只是一种可插拔组件,提示词才是核心。关于提示词的重要性应该没什么好说的了,可以说现在所有的基于大模型构建的应用都是以提示词作为核心切入点;不管是RAG还是智能体,无外如是。对从事大模型应用的开发者来说,重要的不是大模型的部署和运维,其核心是怎么写好提示词;以目前市面上的开发框架或开源项目来看,大模型都是一个可插拔的组件,只要配置好模型参数,在业务场景中可以随意切换不同的模型。模型只是可插拔组

swift框架,全称为Scalable lightWeight Infrastructure for Fine - Tuning,由魔搭社区精心打造。魔搭社区在人工智能领域积累深厚,开发swift框架旨在解决传统大模型开发中的效率和资源管理难题。其研发团队汇聚了人工智能领域的专家,经过大量调研、实验和优化,推出了这款集高效、灵活、轻量于一体的综合性工具集,整合了大模型开发从数据处理到部署的全流程功

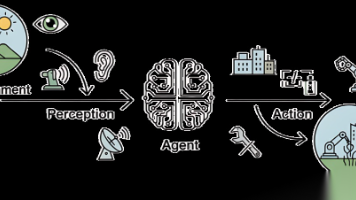

要理解智能体的运作,我们必须先理解它所处的任务环境。在人工智能领域,通常使用PEAS模型来精确描述一个任务环境,即分析其性能度量(Performance)、环境(Environment)、执行器(Actuators)和传感器(Sensors)。以上文提到的智能旅行助手为例,下表1.2展示了如何运用PEAS模型对其任务环境进行规约。表 1.2 智能旅行助手的PEAS描述在实践中,LLM智能体所处的数

日均 tokens 使用量突破 5000 亿——近日,2024 火山引擎 AI 创新巡展・成都站上,豆包大模型最新进展对外公布。一同发布的,还有豆包・图生图模型,以及升级版豆包・文生图模型、豆包・语音合成模型、豆包・声音复刻模型。今年 5 月,字节跳动发布豆包大模型家族。据后续第三方 FlagEval 大模型评测平台发布的榜单显示,豆包大模型(Doubao-Pro-4k)在闭源大模型的“客观评测”

在人工智能领域,豆包、文小言、通义和 Kimi 这几款 AI 助手都颇具影响力。接下来将从文本生成、图片生成、AI 检索以及语音会话等维度对它们进行详细的对比分析,以便用户能更清晰地了解其各自的特点,从而做出更契合自身需求的选择。一、文本生成优势:依托字节跳动云雀模型,豆包展现出强大的通用性。无论是进行学术研讨,还是开展日常对话,它都能迅速给出清晰且精准的回应。

2024年无疑是科技行业公认的“AI大模型落地元年”,大模型应用的供需关系正在经历着前所未有的变化。与过去AI厂商单方面探索应用场景的做法不同,今年我们见证了更多的重要行业和头部企业,在降本提效、以技术驱动新发展和新升级的需求之下,开始以更加开放的姿态主动拥抱大模型,并探索AI技术与自身业务深度融合的可能性。有数据表明,大模型技术正在带来生产力水平的大跃迁。据红杉美国发布的报告,生成式AI为代表的

参数原配置建议配置调整原因epoch12增加轮次以充分学习小数据集batch_size88批次大小合理,无需调整0.000010.0001提高学习率加速 LoRA 参数收敛0.050.1增加预热比例保证训练稳定性lora_rank3232秩的取值适中,无需调整lora_alpha44缩放系数合理,无需调整dpo_beta0.10.1平衡格式对齐与输出多样性11保持 SFT 损失权重合理是否“混入预

通义千问(Qwen)是阿里云研发的通义千问大模型系列的70亿参数规模的模型。Qwen是基于Transformer的大语言模型, 在超大规模的预训练数据上进行训练得到。预训练数据类型多样,覆盖广泛,包括大量网络文本、专业书籍、代码等。今天我们来对这个模型进行本地部署实践python 3.8及以上版本pytorch 1.12及以上版本,推荐2.0及以上版本建议使用CUDA 11.4及以上(GPU用户、

今日文章介绍一款名为的开源统一多模态模型,这是由的最新类似GPT-4O的7B参数的视觉大模型。其功能与 GPT-4o 和 Gemini 2.0 等专有系统类似,凭借原生多模态架构,能够实现实用且有价值的图像生成,输出精确、准确且逼真的图像。模型支持(可用于图等咨询和问答)、等。•:BAGEL 是统一的生成与理解模型,基于大型语言模型预训练,具备推理与对话基础能力。可处理图像和文本输入,并以混合格式