简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

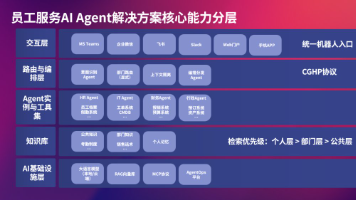

本文探讨了AI Agent在企业员工服务领域的应用解决方案和落地案例。文章指出,AI Agent能有效解决传统员工服务响应慢、流程繁、知识散、重复高、体验差等痛点,通过智能路由、多Agent协同执行和知识沉淀,实现从“人找服务”到“服务找人”的智能闭环。文章还介绍了AI Agent的技术架构、实施路径以及为客户带来的效率、财务和战略价值,并分享了多个成功案例。AI Agent的应用不仅提升了员工服

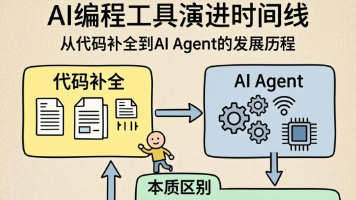

AI Agent编码和AI辅助编码不是替代关系,而是互补关系。AI Agent负责自动化、标准化、低风险的任务,让开发者从繁琐中解放出来。AI辅助编码负责增强、放大、精细化核心开发工作,让开发者的能力边界不断扩展。作为开发者,理解两者的差异、掌握两者的适用场景、灵活组合两者的优势,才能在AI时代真正提升效率,同时保证代码质量。清晰的思维、扎实的技术、对质量的责任感。这些,是任何AI都无法替代的。

本文介绍了五种AI Agent协调模式:生成-验证、编排者-子智能体、智能体团队、消息总线和共享状态。针对不同场景,分析了各模式的优缺点和适用情况,并提供了实际应用举例。建议从简单的编排者-子智能体模式起步,根据实际需求逐步演进,以降低技术复杂度,提高开发效率。他们的核心建议是:**从最简单的模式起步,观察它在哪里撑不住,再针对性地演进。**不要为了看起来"技术先进"而选择复杂模式。以下是五种模式

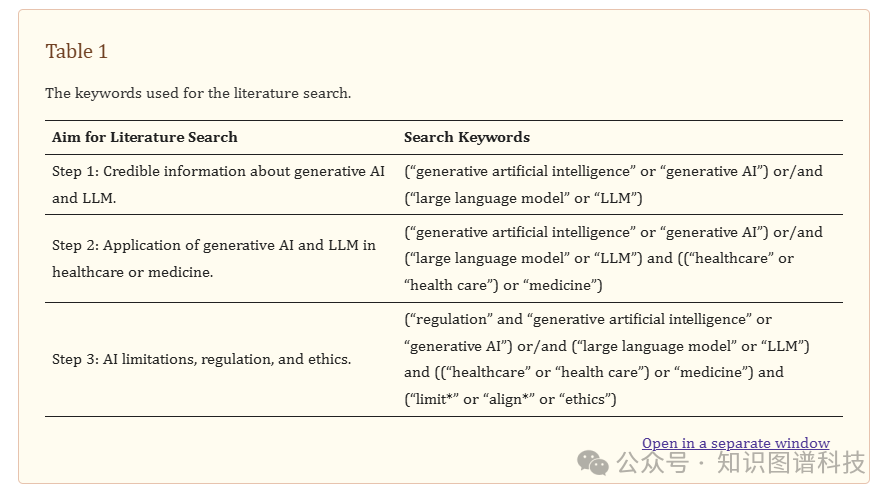

自2022年11月由美国公司OpenAI发布以来,名为ChatGPT的聊天机器人以其在与人类对话中的出色表现震惊了世界 [1]。比尔·盖茨赞扬说,新一代对话代理者将“改变人们的工作方式、学习方式、旅行方式、获得医疗保健的方式以及彼此交流的方式”,从而导致重大的生产率提升和世界上一些最严重的不平等问题得到缓解,特别是在医疗保健方面 [1]。白宫媒体公告赞扬“如果得到妥善管理,人工智能可以为所有人的繁

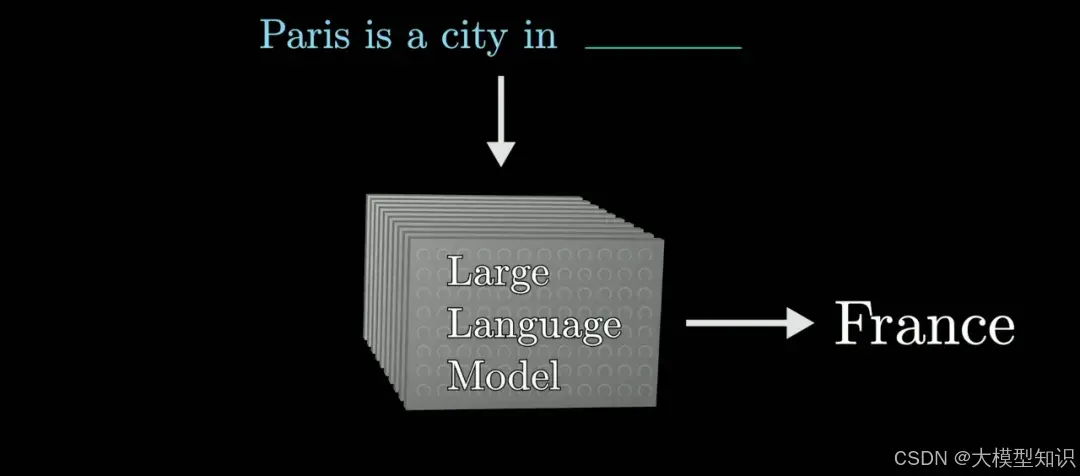

在人工智能快速发展的今天,大语言模型(Large Language Model,LLM)已然成为人们热议的焦点。从智能聊天机器人到文本创作助手,大语言模型的身影无处不在。那么,究竟什么是大语言模型?它又是如何实现这些神奇功能的?接下来,我们用 5 分钟时间一探究竟。

致力于成为大模型呼叫中心系统、电话机器人、智能呼叫中心系统、大模型智能客服系统;开源呼叫中心系统、开源客服系统;视频呼叫中心系统、视频客服系统;全渠道客服系统、在线客服系统等客户服务、企业获客方面的全球领导者!建设一套大模型智能客服系统是一个复杂而细致的过程,涉及多个环节和技术领域。以下是一套详细的建设方案,旨在帮助企业构建高效、智能、可扩展的客服系统。

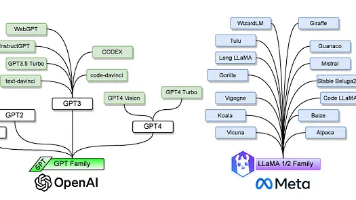

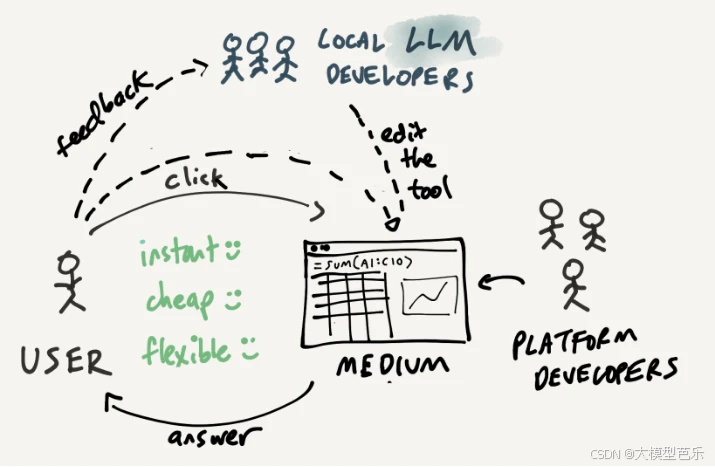

近段时间,大语言模型掀起了一股狂潮。OpenAI 发布的 GPT-4 模型在包括编程在内的各个功能上都取得了令人瞩目的进步。微软研究院发布了一篇论文,展示了 GPT-4 能够在没有太多提示的情况下生成非常复杂的代码,如 3D 视频游戏。与此同时,OpenAI 还发布了 ChatGPT 插件。大语言模型能够提高专业开发人员的工作效率,GitHub Copilot 已经证明了这个方向的可行性。这意味着

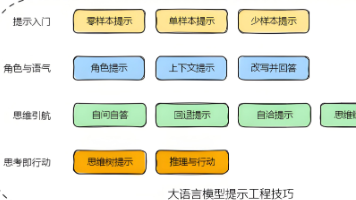

大语言模型提示工程全攻略:从零基础到 ReAct,一篇搞定!

大语言模型(LLM)建模全流程解析 本文系统阐述了大语言模型从数据到落地的四大关键阶段: 预处理:通过文本分词(如BPE算法)和数据清洗构建高质量语料; 预训练:基于MLM(BERT)或CLM(GPT)目标训练通用语言能力; 微调:使用领域数据适配具体任务,添加任务专属结构; 部署:优化推理策略(如束搜索/核采样)实现实时响应。 核心差异:理解型模型(BERT)擅长文本分析,生成型模型(GPT)专

本文系统阐述了大语言模型(LLM)的核心技术体系,包括语言建模基础、Transformer架构原理、预训练方法及挑战。重点分析了参数高效微调技术(LoRA/QLoRA)、提示工程策略和模型压缩方法(量化/剪枝/蒸馏),并探讨了分布式训练与推理优化方案。文章为LLM开发提供了从理论到实践的完整技术路线,涵盖架构设计、训练优化到部署应用的全流程指南,具有重要的工程参考价值。(摘要字数:148字)