简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

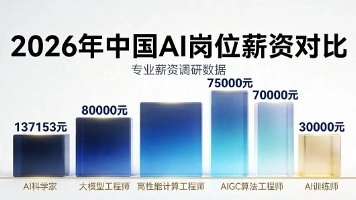

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

本文聚焦2026年AI技术(重点是大模型)在制造业全流程的落地应用,兼顾理论科普与实操导向,适合小白入门了解、程序员学习落地思路。摘要在新型工业化推进的关键2026年,人工智能(Artificial Intelligence, AI)技术,尤其是大模型技术的迭代升级,为制造业转型升级提供了核心动力,其在制造业全流程的深度落地已成为推动产业高质量发展的核心引擎。

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

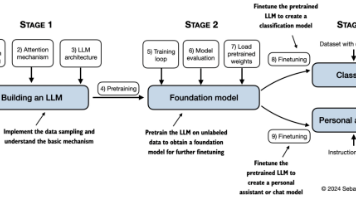

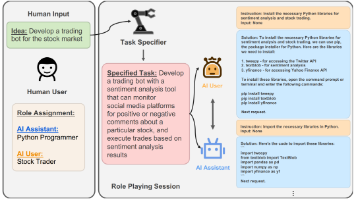

正如前文所述,AutoGen 的设计哲学根植于"以对话驱动协作"。它巧妙地将复杂的任务解决流程,映射为不同角色的智能体之间的一系列自动化对话。基于这一核心理念,AutoGen 框架持续演进。我们将以 0.7.4 版本为例,因为它是截止目前为止最新版本,代表了一次重要的架构重构,从类继承设计转向了更灵活的组合式架构。为了深入理解并应用这一框架,我们首先需要讲解其最核心的构成要素与底层的对话交互机制。

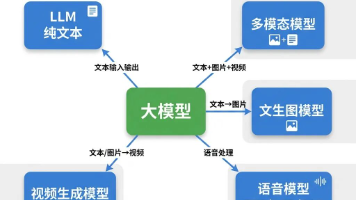

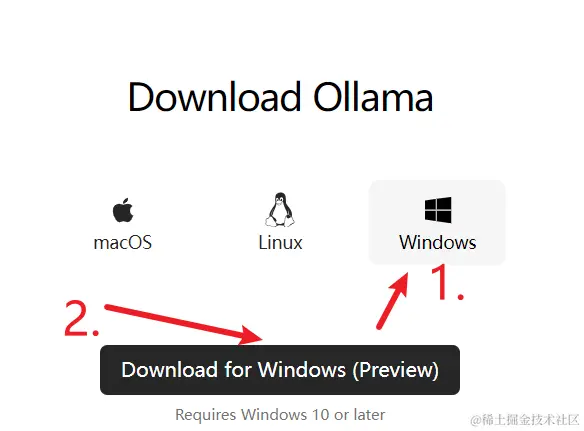

有很多开源大模型都可以本地部署,用于替代 chatGPT 实现本地执行各种任务,比如国内较好的全尺寸模型。在一般的翻译、文案创作、辅助编码等任务上,基本达到了ChatGPT3.5的水平。

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

2026年,AI时代的软件开发逻辑正在发生根本性变革:业务逻辑从应用层逐步“下沉”到模型权重,从确定性的代码编写,转变为概率性的参数优化,从人为设计的结构化复杂性,转向数据涌现的黑盒复杂性。在这样的趋势下,AI Agent开发不再是“调参+Prompt”的简单工作,而是需要开发者具备工程思维、业务理解能力和模型认知能力。而AI Agent开发工程师的核心竞争力,依然是那句核心结论——“理解并驾驭不

🎯 自主规划:能将复杂目标拆解为可落地的执行步骤,无需人工逐一步骤指导🔧 工具使用:可自主调用搜索引擎、计算器、外部API、代码执行工具等,突破自身能力边界,这也是2026年AI Agent的核心升级点之一💾 记忆能力:拥有分层记忆体系(短期工作记忆+长期向量记忆),能在多轮交互中保持上下文连贯,记住关键信息并灵活调用🤔 推理决策:基于2026年优化后的大语言模型,具备更强的逻辑推理、问题