简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

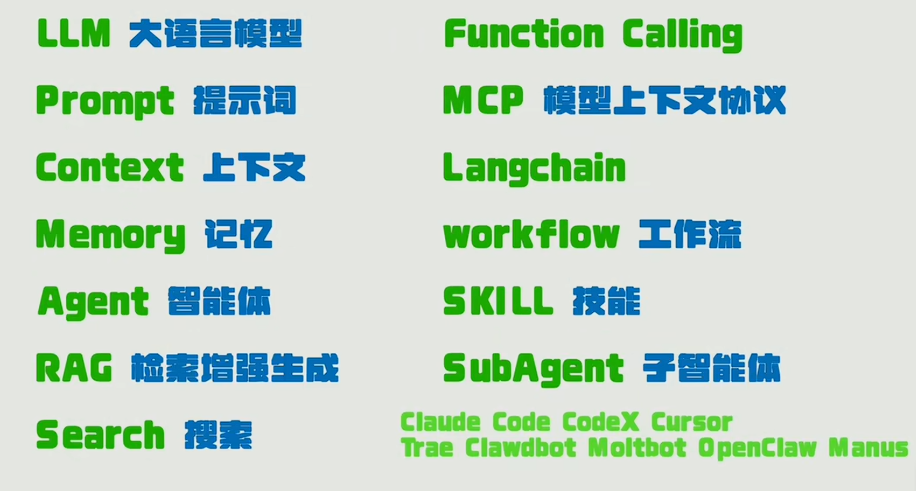

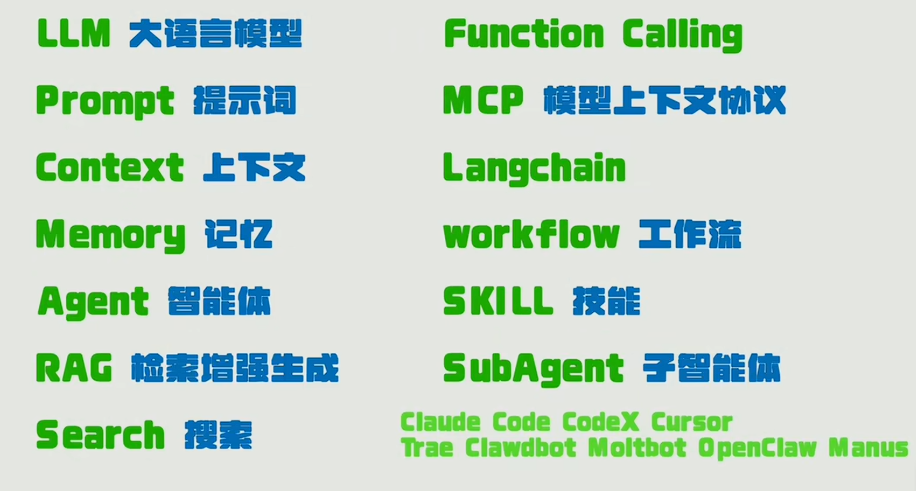

大模型应用从文本生成演进为任务执行智能体,核心概念对应具体工程痛点:LLM(2020-2022)实现通用生成但知识固化;Prompt(2022)控制输出格式;Context/Memory(2023)解决会话记忆问题;RAG+Search(2023)接入外部知识;FunctionCalling(2023)实现工具调用;Workflow/LangChain(2023-2024)组织多步任务;Agent

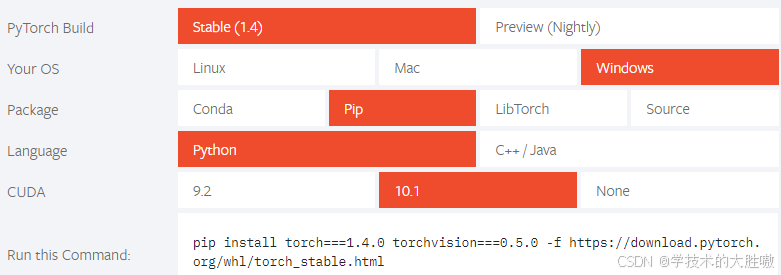

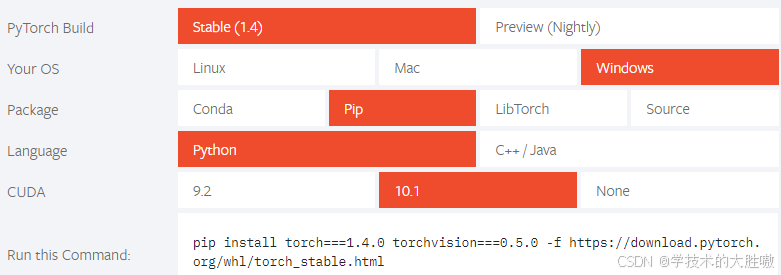

GPU驱动、CUDA、cuDNN和CUDA Toolkit之间有着紧密的关系,它们共同构成了一个完整的GPU编程和深度学习开发环境。在最初配置anaconda环境时一直搞不明白它们之间的关系。所以根据自己的理解,通俗详细解释它们各自的角色和相互间的关系,并且列举了一些在anaconda虚拟环境中的例子。不对的地方希望大家指正。

大模型应用从文本生成演进为任务执行智能体,核心概念对应具体工程痛点:LLM(2020-2022)实现通用生成但知识固化;Prompt(2022)控制输出格式;Context/Memory(2023)解决会话记忆问题;RAG+Search(2023)接入外部知识;FunctionCalling(2023)实现工具调用;Workflow/LangChain(2023-2024)组织多步任务;Agent

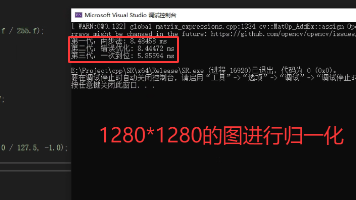

深度学习推理优化中常见"灵异现象"解析:首帧推理慢(400ms vs 6ms)源于CUDA初始化、cuDNN算法搜索等固定开销;正确计时需使用perf_counter()并同步GPU;batchsize影响显著但反常(14张图bs=8时更慢,16张图则快8倍),关键在于"残缺批"导致成本不均摊和算法缓存失效。解决方案:预热采用与推理一致的输入形状,确保数据集

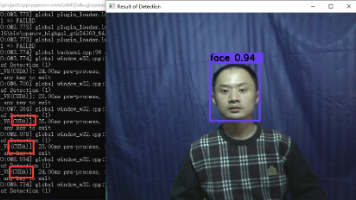

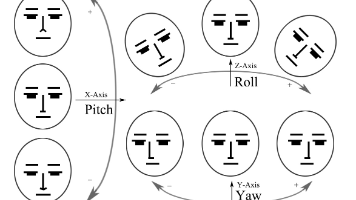

头部姿态估计(Head Pose Estimation, HPE)指根据图像或视频推断人头相对于摄像机的朝向(通常以欧拉角yaw偏航、pitch俯仰、roll翻滚表示)。作为非言语行为分析的重要组成,头部朝向能够反映注意力、意图等信息,广泛应用于驾驶员监控、人机交互、视线追踪等领域。早期方法主要依赖几何与经典机器学习技术,近年来深度学习推动了精度提升。总的来说,HPE方法大致分为基于2D关键点(两

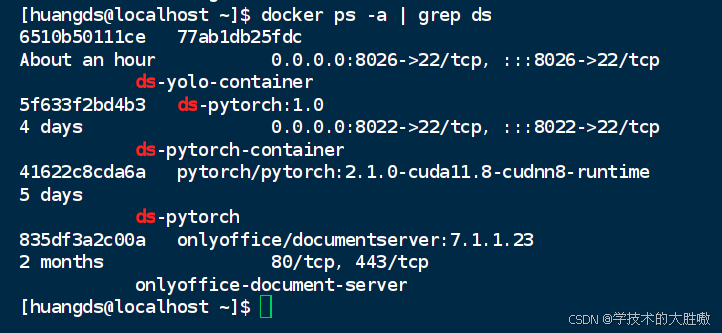

实进行深度学习时,由于GPU都在服务器上,编辑代码很麻烦。并且服务器上配置了docker的环境,所以用pycharm连接远程服务器的docker进行深度学习,这样在本地调用远程服务器的GPU和环境,更方便一点,将这个过程记录下来,希望对大家有所帮助。

GPU驱动、CUDA、cuDNN和CUDA Toolkit之间有着紧密的关系,它们共同构成了一个完整的GPU编程和深度学习开发环境。在最初配置anaconda环境时一直搞不明白它们之间的关系。所以根据自己的理解,通俗详细解释它们各自的角色和相互间的关系,并且列举了一些在anaconda虚拟环境中的例子。不对的地方希望大家指正。

在一次算法优化的任务中,我需要将整个推理项目的速度尽可能优化到极致(前处理,推理,后处理),将自己对于其中图像归一化的迭代优化思考的过程记录下来,温故而知新。

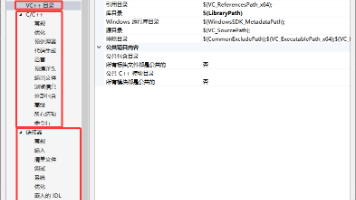

本文对比了Visual Studio中两种配置第三方库(如OpenCV)的方法:1)在VC++目录中设置包含/库目录,并在链接器中添加依赖项;2)在C/C++中添加包含目录,在链接器中添加库目录和依赖项。虽然两种方式都能成功运行,但方案二更优:它将头文件路径、库路径和库清单明确区分,作用范围限定在当前项目,配置直观且易于团队协作。建议优先使用方案二,在C/C++和链接器页面进行配置,避免使用VC+

本文介绍了一个基于ONNXRuntime和OpenCV的YOLOv8 C++推理模块,支持Windows/Linux平台,具有轻量高效、可扩展性强等特点。项目核心文件inference.cpp实现了完整的推理流程,包括模型加载、图像预处理、推理执行和后处理。系统支持CPU和CUDA加速,提供检测和分类两种任务模式,通过模板化设计实现了FP32/FP16的灵活切换。预处理采用Letterbox缩放策