简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

OpenAI推出人工智能聊天模型ChatGPT,很快引起百万用户注册使用,公众号和热搜不断,迅速火出圈,甚至引起各大公司在聊天对话机器人上的军备竞赛。

生成式建模的扩散思想实际上已经在2015年(Sohl-Dickstein等人)提出,然而,直到2019年斯坦福大学(Song等人)、2020年Google Brain(Ho等人)才改进了这个方法,从此引发了生成式模型的新潮流。目前,包括OpenAI的GLIDE和DALL-E 2,海德堡大学的Latent Diffusion和Google Brain的ImageGen,都基于diffusion模型,

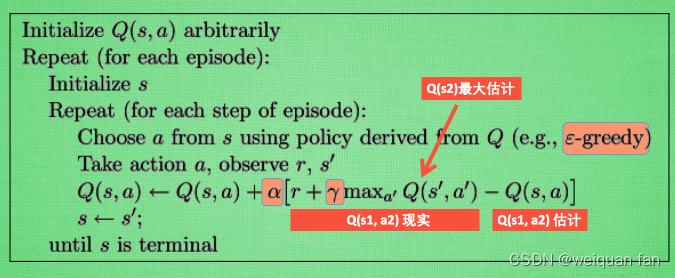

强化学习是机器学习中的一大类,它可以让机器学着如何在环境中拿到高分, 表现出优秀的成绩. 而这些成绩背后却是他所付出的辛苦劳动, 不断的试错, 不断地尝试, 累积经验, 学习经验.

生成式建模的扩散思想实际上已经在2015年(Sohl-Dickstein等人)提出,然而,直到2019年斯坦福大学(Song等人)、2020年Google Brain(Ho等人)才改进了这个方法,从此引发了生成式模型的新潮流。目前,包括OpenAI的GLIDE和DALL-E 2,海德堡大学的Latent Diffusion和Google Brain的ImageGen,都基于diffusion模型,

生成式建模的扩散思想实际上已经在2015年(Sohl-Dickstein等人)提出,然而,直到2019年斯坦福大学(Song等人)、2020年Google Brain(Ho等人)才改进了这个方法,从此引发了生成式模型的新潮流。目前,包括OpenAI的GLIDE和DALL-E 2,海德堡大学的Latent Diffusion和Google Brain的ImageGen,都基于diffusion模型,

OpenAI推出人工智能聊天模型ChatGPT,很快引起百万用户注册使用,公众号和热搜不断,迅速火出圈,甚至引起各大公司在聊天对话机器人上的军备竞赛。

梯度下降算法(Gradient Descent Optimization)是神经网络模型训练最常用的优化算法。

考虑卷积核和输入尺寸时奇数和偶数的情况

由于注意力机制的高速发展,我尝试着对attention形成一种比较系统化的理解,选了比较有代表性的Self-Attention, SENet和CBAM,整理成本文。

梯度下降算法(Gradient Descent Optimization)是神经网络模型训练最常用的优化算法。