简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

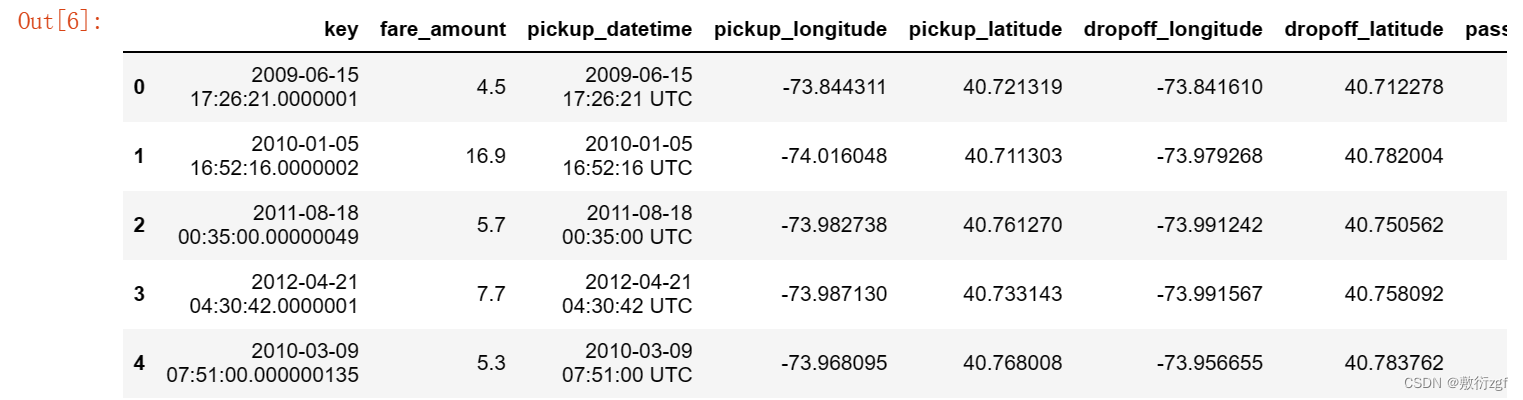

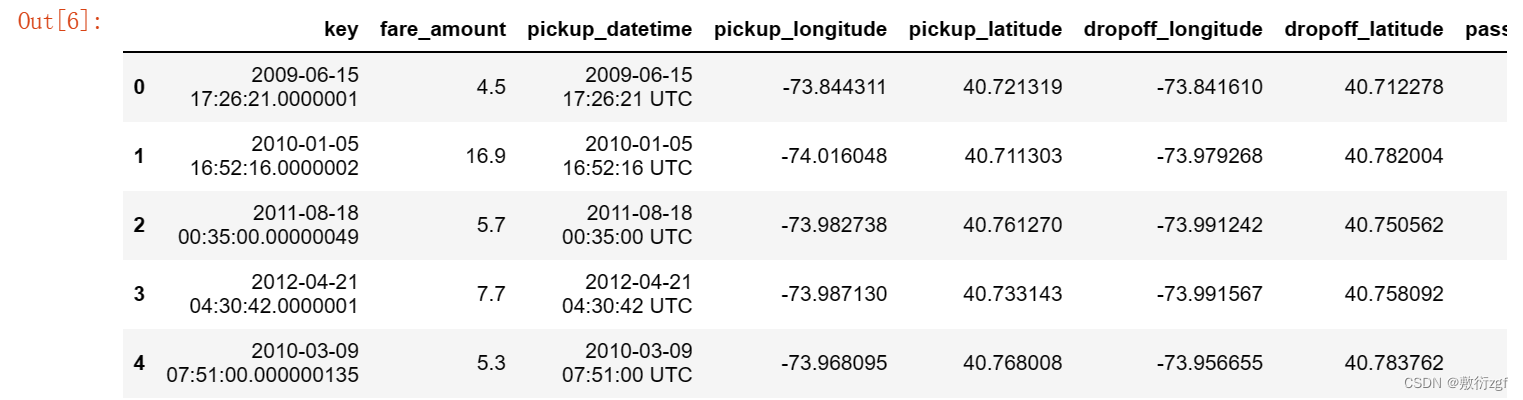

【机器学习实战】二、随机森林算法预测出租车车费案例

二、随机森林算法预测出租车车费案例

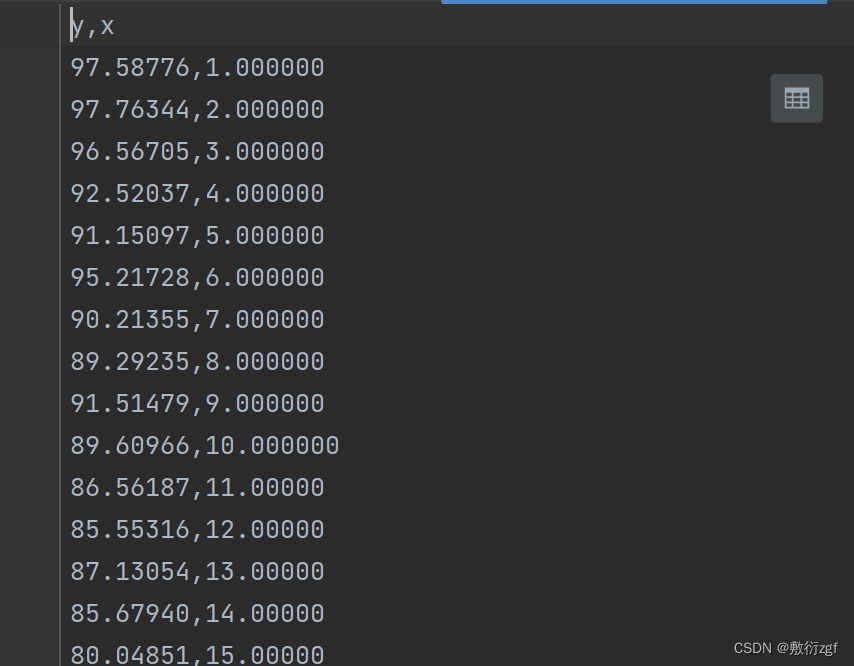

【机器学习实战】五、实现非线性回归模型案例

实现非线性回归模型案例

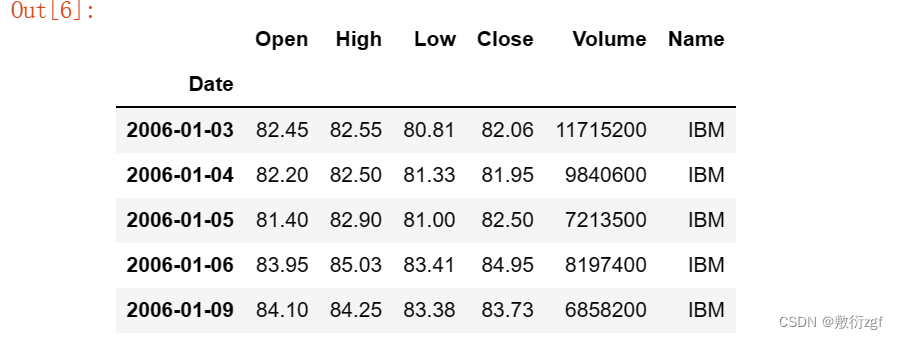

【机器学习实战】三、使用LSTM实现IBM股票价格预测

基于LSTM对IBM股价进行预测

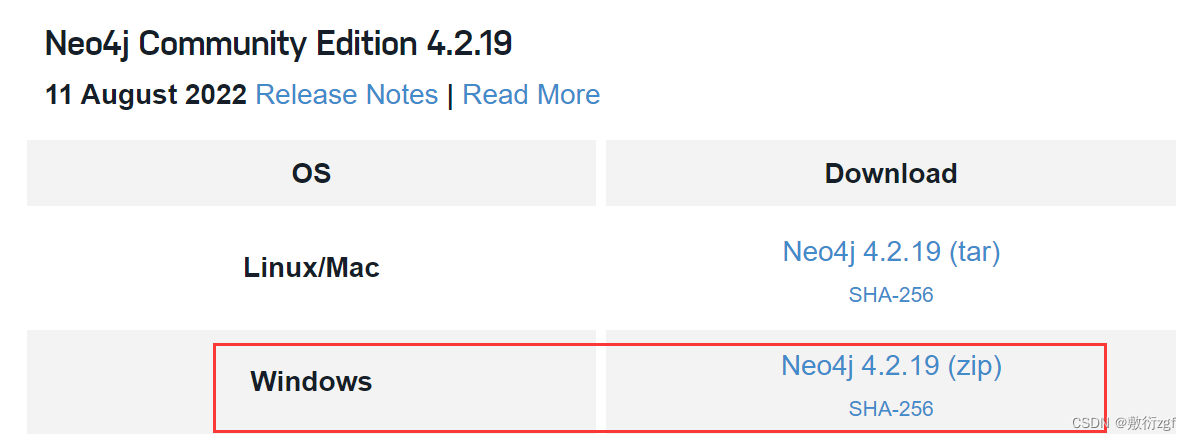

全网最详细的Neo4j安装教程

全网最详细的Neo4j安装教程

【机器学习实战】二、随机森林算法预测出租车车费案例

二、随机森林算法预测出租车车费案例

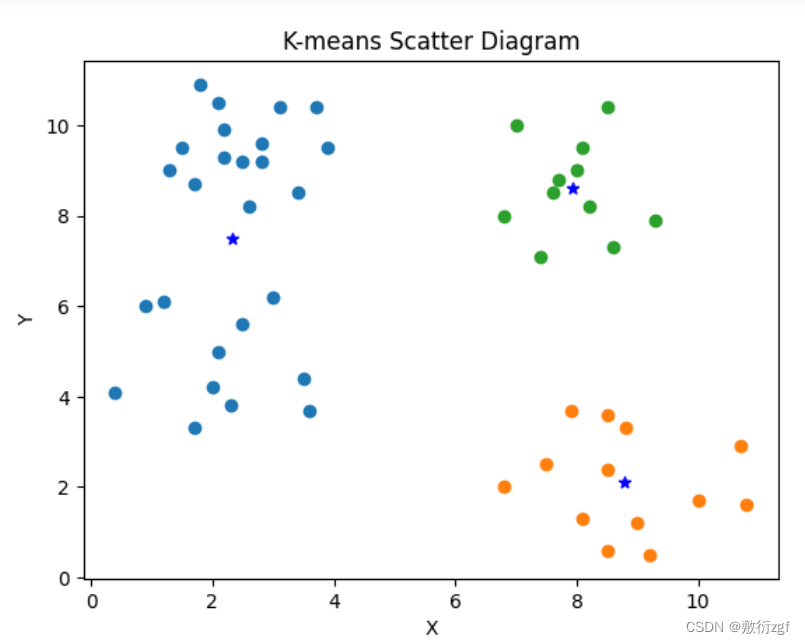

数据挖掘经典十大算法_K-Means算法

K-means算法的理解与代码实现

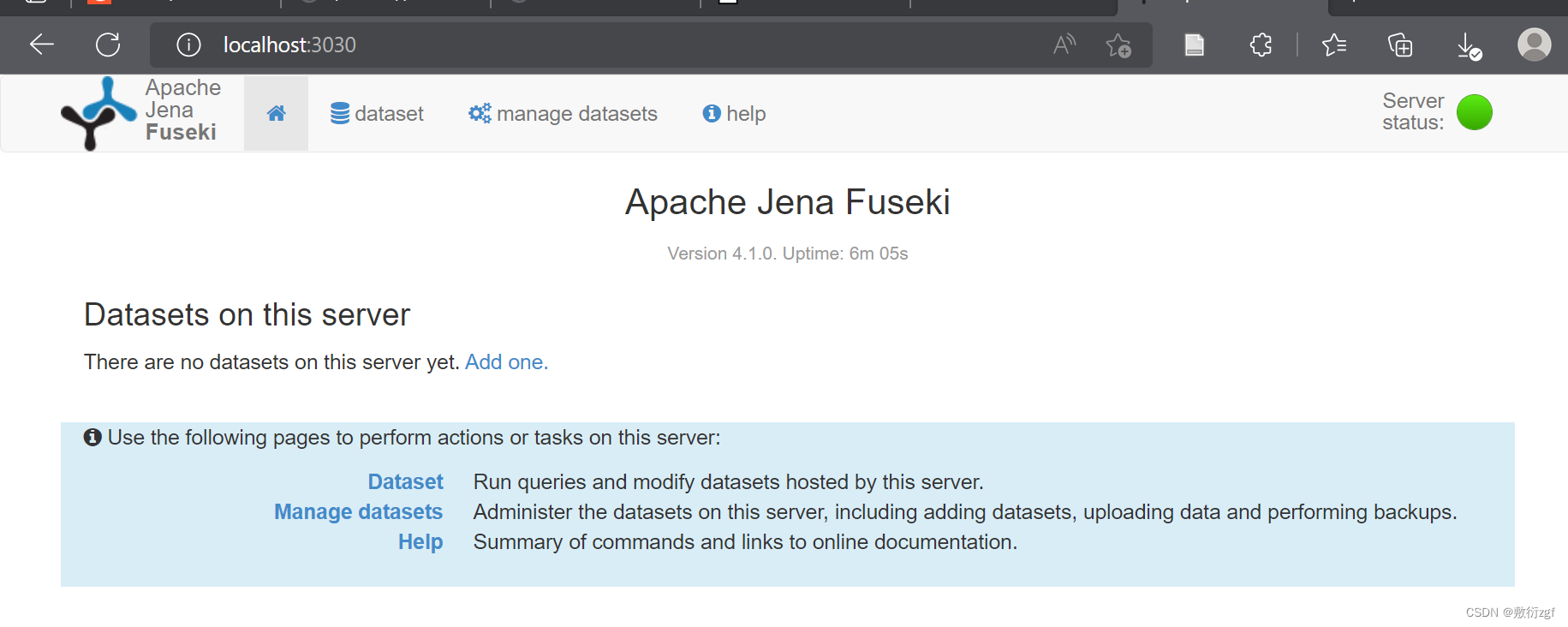

搭建基于Apache的Jena图数据平台

搭建基于Apache的Jena图数据平台

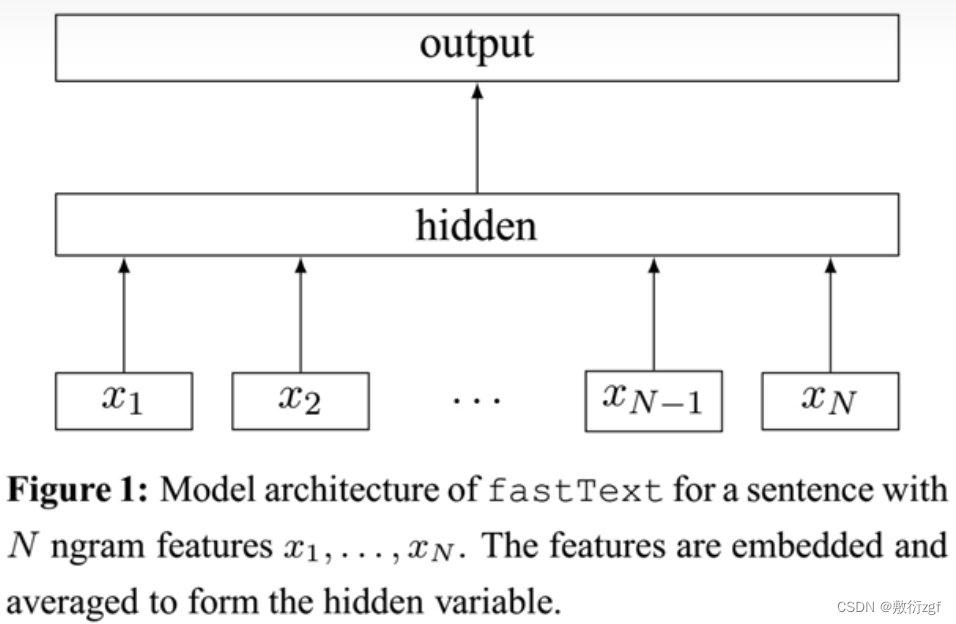

FastText词向量计算和文本分类工具

fasttext词向量计算和文本分类工具

Pytorch版本的Ernie Health源码详解

Pytrch版本的Ernie Health模型详解