简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Docker 官方维护了 143 常见开源项目的容器镜像仓库,存放在 library 项目中,是最流行的一类镜像仓库。藏云阁镜像服务第1批同步了该 143 个镜像仓库的镜像,提供免费、不限速、多架构的镜像下载服务。

本文提供了一种企业级的内网 Go 语言依赖拉取解决方案,可由运维人员统一维护服务,研发人员和CI/CD环境只需要3行配置即可实现内网 Go 开发自由。

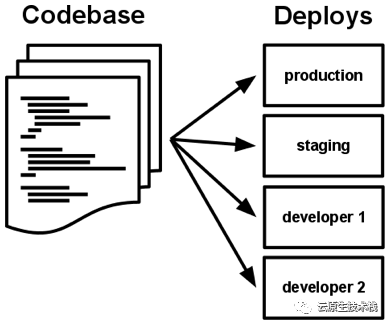

云原生技术虽然好,但对于如何设计开发好云原生应用却缺乏普适性的实践与方法论,本文的 12factor是目前主流的最佳开发实践之一。

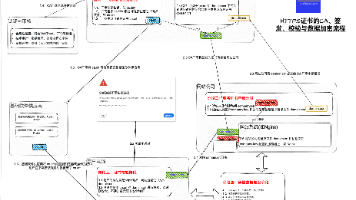

本文从HTTPS证书的CA签发、域名申请、证书校验、数据加密切入,带你彻底看懂证书运作机制。自签证书实操教程与自动化Shell脚本,助你快速生成域名证书。文末还提供《HTTPS权威指南》电子书资源,带你深入PKI体系。

在云原生场景下如何做好应用的定义与交付也同样影响着企业的成本投入,也影响着股东的每一份利润。

藏云阁新增 Agent Skill 仓库,提供 7万+ Skill 的检索、详情,以及安装下载服务。目前平台已开放 **35万+** 资源,资源种类扩充到 7 大类型,覆盖软件及AI的基础数字资产。

我身边就有不少朋友使用 KubeSphere 来管理他们的容器云集群,有人说它 页面 UI 好看,也有人说它 产品交互设计体验好,降低了 Kubernetes 的学习成本 等,当然也有一部分人因为他是国内厂商主导的(青云)开源项目,便于后续信创 而选择

深入解析 OpenClaw 的梦境功能:基于三阶段模型的后台记忆整合系统。梦境功能于 OpenClaw v2026.04.05 正式上线,标志着记忆系统从简单启发式规则向自动化、多阶段、带强化信号的评分机制的进化

本文对比了Docker Compose和Kubernetes(k8s)两种容器编排工具的适用场景。Docker Compose适合单机环境,通过YAML配置文件简化多容器应用管理,具有资源占用少、配置简单、环境一致等优势,是开发测试和小规模部署的理想选择。Kubernetes则更适合多机生产环境,提供集群管理、弹性伸缩、负载均衡等能力,能有效应对高可用、高并发等需求。建议根据业务规模、技术能力和运

Kubernetes v1.35版本发布,本文梳理十大重点确定性更新,涉及退役功能,以及新增GA的功能。并且,v1.31版本结束支持也已经在 2025-11-11 停止维护。