简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

传统购物方式面临信息过载和搜索效率低下的问题,消费者在海量商品中难以快速找到符合需求的商品。实时电商商品推荐系统通过个性化推荐,解决了这一困境。该系统利用Flink + Kafka技术架构,实时处理消费者行为数据,提供精准的商品推荐,提升购物体验和满意度。其优势包括节省时间、提高用户粘性、挖掘潜在需求等。应用场景涵盖首页推荐、搜索结果推荐、商品详情页推荐和购物车推荐。尽管面临数据实时性、质量和算法

在数字化时代,数据量呈爆炸式增长,构建高效、稳定的大数据架构方案成为企业脱颖而出的关键。本文深入探讨了大数据架构方案的重要性、技术亮点及应用场景。技术亮点包括HDFS(分布式文件系统)、Flink(实时数据处理)、Hive(数据仓库工具)和ClickHouse(高性能列式数据库)。这些技术共同支撑了海量数据存储和实时数据处理的需求。未来,随着人工智能和机器学习等技术的引入,大数据架构方案将进一步提

文章围绕大数据下的商品推荐秘诀展开探秘。开篇提出消费者购物选择难题,引出大数据商品推荐。阐述其背景意义,因商品选择困境而应运而生,能提高购物效率与满意度。介绍其技术原理,包括数据收集整理、分析建模及推荐算法选择应用,并给出代码示例与流程图。说明智能算法优势,列举深度学习、强化学习等常见算法并给出类图。

随着技术的不断进步和应用的不断拓展,数字孪生正呈现出一系列令人瞩目的发展趋势,为各个行业的创新和变革带来了新的机遇。数字孪生与人工智能、物联网、大数据等新一代信息技术的融合将更加紧密人工智能技术能够赋予数字孪生更强大的智能分析和决策能力,使其能够自动处理和分析海量数据,实现更精准的预测和优化。通过机器学习算法,数字孪生可以对设备的运行数据进行分析,提前预测设备故障,为设备维护提供决策依据。

弱人工智能,也被称为狭义人工智能,是指专注于完成特定任务的人工智能系统。它就像是一位专业的工匠,在自己擅长的领域内技艺精湛,但一旦跨出这个领域,就会显得力不从心。弱人工智能的运行依赖于大量的算法和数据,通过对这些数据的学习和分析,来实现特定的功能。例如语音识别技术,当你说出 “打开音乐”,手机里的语音助手能够迅速识别你的指令,这背后是它经过海量语音数据训练,对各种语音模式和语义进行分析匹配,从而准

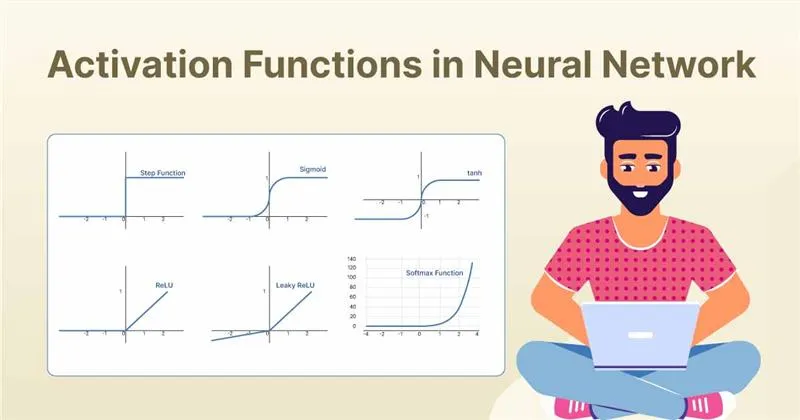

激活函数是神经网络中非常重要的组成部分,它引入了非线性因素,使得神经网络能够学习和表示复杂的函数关系。在神经网络中,神经元接收到多个输入信号,将这些输入信号进行加权求和后,再通过一个激活函数进行转换,得到神经元的输出。激活函数决定了神经元是否被激活,即是否将信号传递给下一层神经元。回顾激活函数的发展历程,从早期的 Sigmoid 和 Tanh 函数,到如今 ReLU 及其变种在深度学习领域的广泛应

AI Agent是一种能够模拟人类智能行为的系统,它能够感知环境、理解需求、制定计划并执行任务以实现特定目标。与传统AI系统不同,AI Agent具有自主性、能动性和学习能力,可以主动与环境交互并适应变化。大型语言模型(LLM):作为智能体的"大脑"Planning(规划):决定如何实现目标Memory(记忆):存储和检索信息Tools(工具):执行具体任务的能力来源:知乎链接点击查看推荐理由:这

函数类型典型算法/模型作用逻辑回归、神经网络分类层概率映射与多分类决策13ReLU/TanhCNN、RNN隐藏层非线性特征提取与梯度稳定45MSE/交叉熵线性回归、深度学习分类任务误差度量与模型优化13正则化项防止过拟合的模型(如Lasso、SVM)参数约束与泛化提升48以上函数在AI算法中通过组合使用(如Softmax+交叉熵、ReLU+梯度下降)实现模型训练与推理,需结合实

深度学习在计算机视觉、自然语言处理和语音识别与合成等领域的应用,极大地推动了人工智能技术的发展和普及。这些技术不仅提高了自动化和智能化水平,还为人们的生活和工作带来了极大的便利。随着技术的不断进步,深度学习在这些领域的应用将更加广泛和深入,为人类社会的发展带来更多的可能性。

NDArray是Deeplearning4j(DL4J)生态系统的核心组件,作为多维数值计算的核心数据结构,其设计融合了高效性、灵活性与跨平台支持。本文从NDArray的设计哲学出发,深入剖析其内存管理机制、分布式计算支持、与硬件加速的集成,并对比NumPy、PyTorch Tensor等同类技术。通过实际应用案例(如图像处理、自然语言处理)和性能基准测试,论证NDArray在深度学习任务中的优势