简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

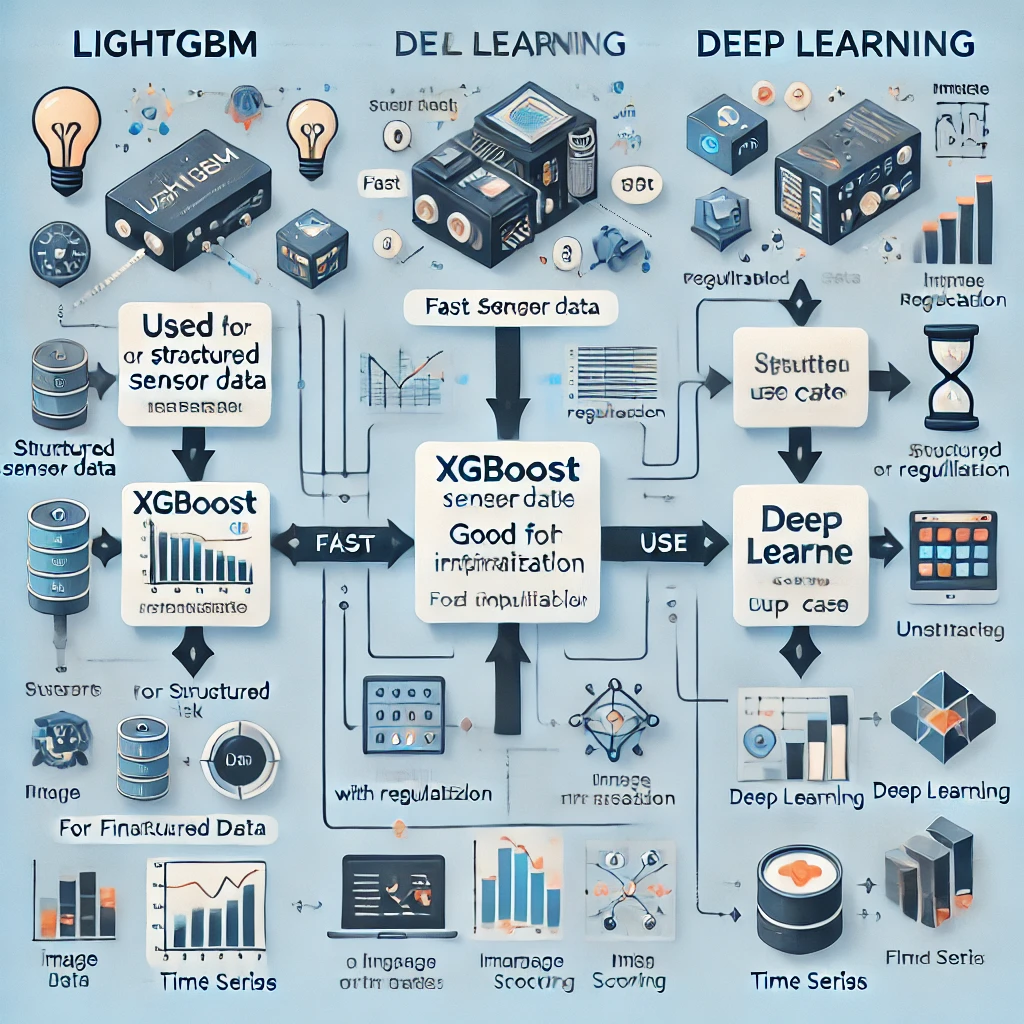

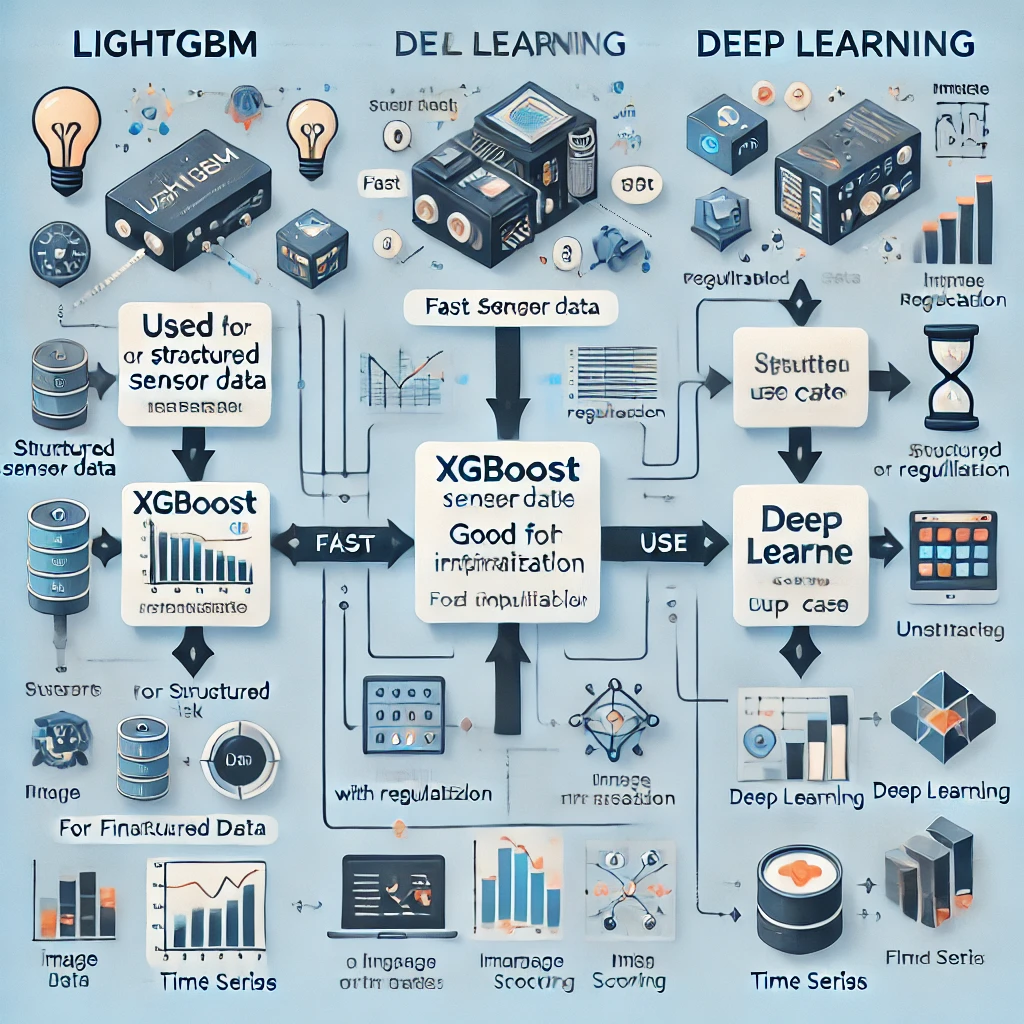

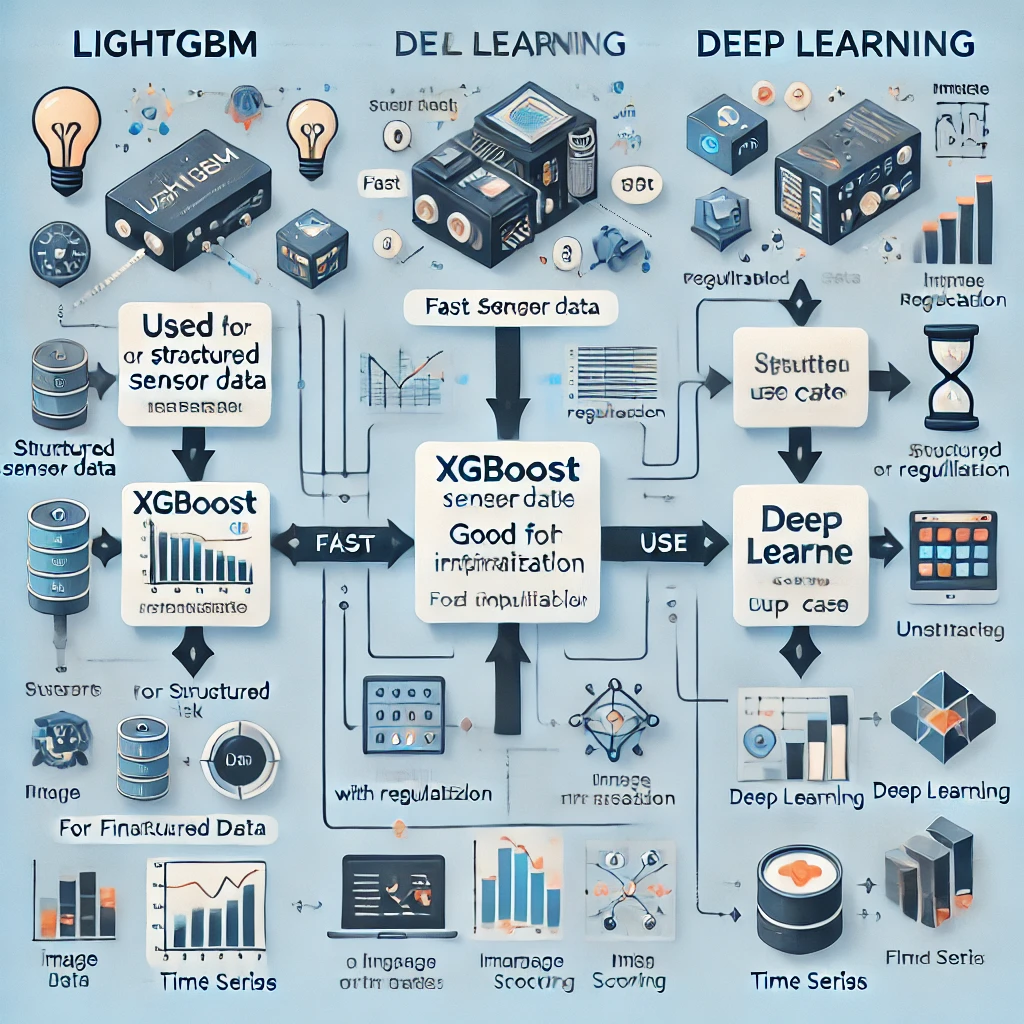

在选择机器学习模型时,LightGBM、XGBoost和深度学习各有其适用场景。LightGBM和XGBoost都是基于梯度提升树的集成学习算法,适用于结构化数据,具有训练速度快、可解释性强的特点,尤其在小样本场景下表现优异。LightGBM在训练速度和内存使用上优于XGBoost,适合大规模数据。深度学习模型则擅长处理非结构化数据(如图像、文本、声音),支持多模态融合,但训练速度较慢且可解释性差

在这个案例中,我们将使用一种更先进且性能更优的图神经网络模型——ALIGNN(Atomistic Line Graph Neural Network),结合Materials Project API(MP API)的数据,预测材料的带隙(band gap)。ALIGNN是一种专门为材料科学设计的GNN模型,它通过结合原子图和键角信息,能够更精确地捕捉原子间的相互作用和几何特性。ALIGNN通过原子

大家好!今天,我们来聊一个让很多初学者甚至有经验的开发者都头疼的问题:面对琳琅满目的机器学习和深度学习模型,到底该如何选择?就像走进一家拥有无数工具的五金店,如果你不知道每件工具的用途,很容易就挑花了眼。

Kaiming He 等人,Deep Residual Learning for Image Recognition (CVPR 2016).(同 ResNet‑34),但每个 block 内部由三个卷积层组成,expansion 值为 4。PyTorch 实现 ResNet‑50。它与 ResNet‑34 唯一不同之处在于使用了。这样就完整复现了图中右侧那张“34-layer residual”

在选择机器学习模型时,LightGBM、XGBoost和深度学习各有其适用场景。LightGBM和XGBoost都是基于梯度提升树的集成学习算法,适用于结构化数据,具有训练速度快、可解释性强的特点,尤其在小样本场景下表现优异。LightGBM在训练速度和内存使用上优于XGBoost,适合大规模数据。深度学习模型则擅长处理非结构化数据(如图像、文本、声音),支持多模态融合,但训练速度较慢且可解释性差

在这个案例中,我们将使用一种更先进且性能更优的图神经网络模型——ALIGNN(Atomistic Line Graph Neural Network),结合Materials Project API(MP API)的数据,预测材料的带隙(band gap)。ALIGNN是一种专门为材料科学设计的GNN模型,它通过结合原子图和键角信息,能够更精确地捕捉原子间的相互作用和几何特性。ALIGNN通过原子

创建一个名为StudentController的类,添加@RestController注解,并注入StudentService,用于处理前端的请求。在本例中,访问http://localhost:8080,即可看到学生信息的表格。创建一个名为StudentService的接口,定义一些学生信息相关的业务逻辑方法,如添加学生、删除学生、修改学生信息等。使用浏览器访问前端页面,触发相应的请求,后端会根

在这个案例中,我们将使用一种更先进且性能更优的图神经网络模型——ALIGNN(Atomistic Line Graph Neural Network),结合Materials Project API(MP API)的数据,预测材料的带隙(band gap)。ALIGNN是一种专门为材料科学设计的GNN模型,它通过结合原子图和键角信息,能够更精确地捕捉原子间的相互作用和几何特性。ALIGNN通过原子

在选择机器学习模型时,LightGBM、XGBoost和深度学习各有其适用场景。LightGBM和XGBoost都是基于梯度提升树的集成学习算法,适用于结构化数据,具有训练速度快、可解释性强的特点,尤其在小样本场景下表现优异。LightGBM在训练速度和内存使用上优于XGBoost,适合大规模数据。深度学习模型则擅长处理非结构化数据(如图像、文本、声音),支持多模态融合,但训练速度较慢且可解释性差

Sklearn的案例demo