简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

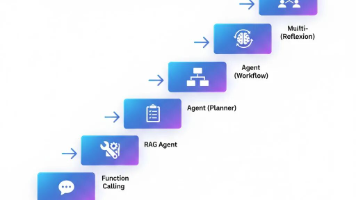

从“会聊天”,到“会做事”,再到“会协作”,

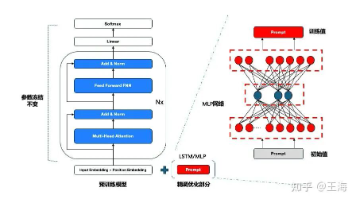

大模型精调方法综述:针对预训练大模型在特定任务表现不佳的问题,本文系统介绍了两种精调方案。全量参数调整虽能发挥模型潜力但成本高昂,更适合参数规模较小的模型。目前主流采用部分参数微调方法,重点分析了五种高效微调技术:1)Prompt Tuning通过添加可训练提示词优化输入;2)P-Tuning引入可训练编码Token加速收敛;3)P-Tuning v2改进为多层提示优化;4)Prefix Tuni

大模型是指包含超大规模参数(十亿级以上)的神经网络模型,主要包括语言大模型、视觉大模型和多模态大模型等类型。其训练分为预训练和微调两个阶段:预训练通过海量未标注数据学习通用特征,微调则使用特定领域标注数据优化模型性能。大模型具有涌现能力和泛化能力,可应用于文本生成、图像识别、跨模态任务等多个领域。但其训练需要庞大算力(如GPT-3需3640PFLOP·天)和海量数据(如45TB文本),成本极高。相

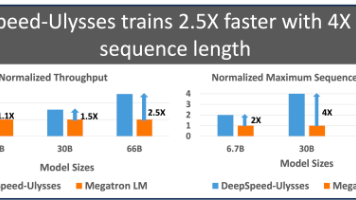

《大模型算法入门指南》摘要:本文系统介绍大模型学习的六个核心模块:1)深度学习基础(Transformer架构等);2)NLP基础知识(Bert模型等);3)大模型训练框架(Megatron-LM等);4)推理技术(KVCache等);5)应用开发(Langchain工具);6)前沿动态(顶会论文追踪)。内容由浅入深标注难度星级,建议反复学习。文末提供全套免费学习资料,包含入门指南、路径图、实战案

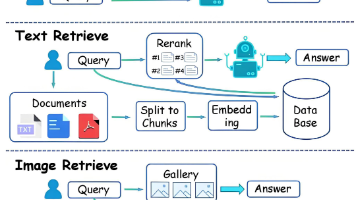

大模型技术快速发展,应用前景广阔。本文推荐系统学习路线:1)提示词工程;2)检索增强生成(RAG);3)模型微调;4)模型部署;5)AI系统实践。学习后可参与开源项目,掌握大模型应用开发技能。资料包含学习指南、实战案例、视频课程等,适合零基础入门,助力职业发展。获取方式见文末。

React面试难度升级:2025年面试官三大"死亡拷问" 近期一篇《面完React岗,我连夜把"精通"从简历里删了》引发热议,揭示了React面试的三大"地狱级"挑战: 源码层考验:要求手写useEffect依赖比对逻辑,解释Object.is与===的区别,甚至需要理解Fiber树中断恢复机制。 工程化难题:面对万级动态表格性能优化,仅

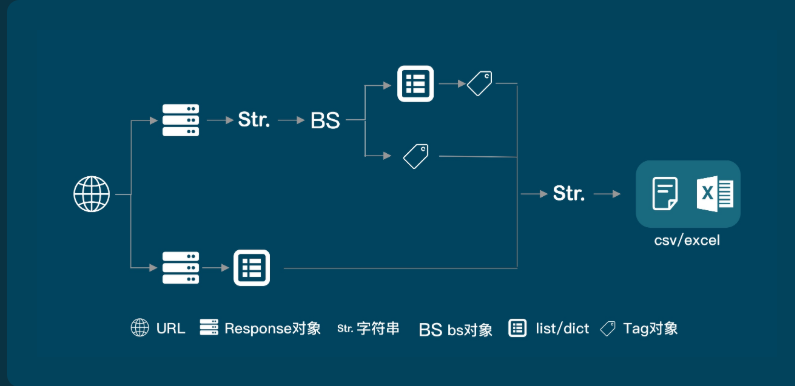

里面有3张csv文件分别是enrollments.csv,daily_engagements.csv,project_submission.csv和一个ipython的notebook。启动cmd 切换到解压之后的文件 输入 jupyter notebook 启动ipython笔记本。3.代码编写,提取出结果数据,并分析是否有异常数据,修改代码。6.追踪剩余的问题(移除数据集的测试账号)4.根据数

本文中,我们将首先讨论如何在本地机器上或者EC2的集群上设置Spark进行简单分析。然后,我们在入门级水平探索Spark,了解Spark是什么以及它如何工作(希望可以激发更多探索)。最后两节我们开始通过命令行与Spark进行交互,然后演示如何用Python写Spark应用,并作为Spark作业提交到集群上。

1.import requests2.from bs4 import BeautifulSoup3.pandas 数据分析高级接口模块

在python3.x中,可以使用pymysql来MySQL数据库的连接,并实现数据库的各种操作,本次博客主要介绍了pymysql的安装和使用方法。