简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

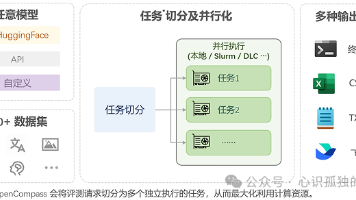

生成式大语言模型的性能评估是模型优化与应用落地的关键环节。通过系统化评估,可精准量化模型在多维能力指标上的表现,为技术迭代提供数据支撑。OpenCompass作为专业的评估平台,集成了完备的评估指标体系与大规模开源数据集,能够全面满足生成式大语言模型的多样化测评需求。本文将基于OpenCompass框架,详细解析生成式大语言模型的标准化评估方法论。

这篇文章介绍了大语言模型(LLM)的核心原理,重点讲解next token prediction机制。详细解释了token概念、tokenization过程、embedding和位置编码的添加方法,以及预训练和推理阶段的实现。还介绍了温度参数如何控制生成文本的随机性,并提供了nano-GPT的代码实现,帮助理解大语言模型的工作原理。

企业Agent是基于大模型的自主决策数字员工,具备感知-思考-决策-执行能力,解决企业数字化转型"最后一公里"难题。通过流程自动化升维、重构人机协作、赋予企业实时响应能力,实现降本增效。其运行依赖大模型推理、算力基础设施、标准化协议和安全四大支柱。已在金融、制造等多行业落地,未来将向多智能协同和行业深度融合方向发展,成为企业数字化基础设施。

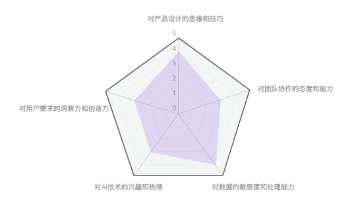

作为产品经理,您或许已经对机器学习、自然语言处理等传统AI技术在业务落地中的应用驾轻就熟。但面对大模型这场席卷全球的技术革命,我们需要以全新的视角重新审视AI产品的开发逻辑和商业价值。大模型凭借其千亿级参数规模带来的涌现能力和跨任务通用性,正在彻底改写AI产业的发展轨迹。这不仅意味着技术架构的革新,更代表着产品方法论的根本性转变——从精心设计的功能模块到激发模型潜能的能力引导,从解决特定问题到构建

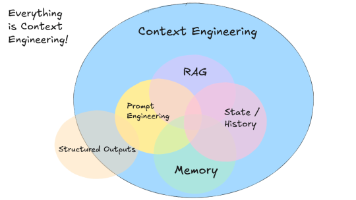

在AI技术快速迭代的今天,提示词工程、RAG和记忆管理已成为热门话题,但一个更关键的概念正在悄然崛起——上下文工程(Context Engineering)。这并非全新概念,早在智能体技术兴起时,先行者就已意识到其价值:如图表所示,上下文工程如同'胶水'般串联起提示词、检索和记忆模块,构建出真正连贯的AI交互体验。

在人工智能领域,检索增强生成(Retrieval Augmented Generation,简称RAG)技术正逐渐成为研究的热点。这项技术通过结合检索和生成两种方法,旨在提高自然语言处理系统的性能和效率。

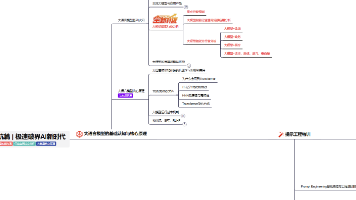

当前,人工智能技术正以惊人的速度重塑产业格局,而大模型已成为推动这场变革的核心引擎。对于程序员群体而言,这既是技术迭代的挑战,更是职业跃迁的黄金机遇——如果你仍在传统开发领域内卷,现在正是转向大模型这片新蓝海的最佳时机!程序员凭借扎实的编程功底和系统性思维,在大模型领域具有天然转型优势。本文将为您深度解析:从技术适配度和市场价值双重维度,揭秘5大最具潜力的转型方向——无论是需要深度学习功底的大模型

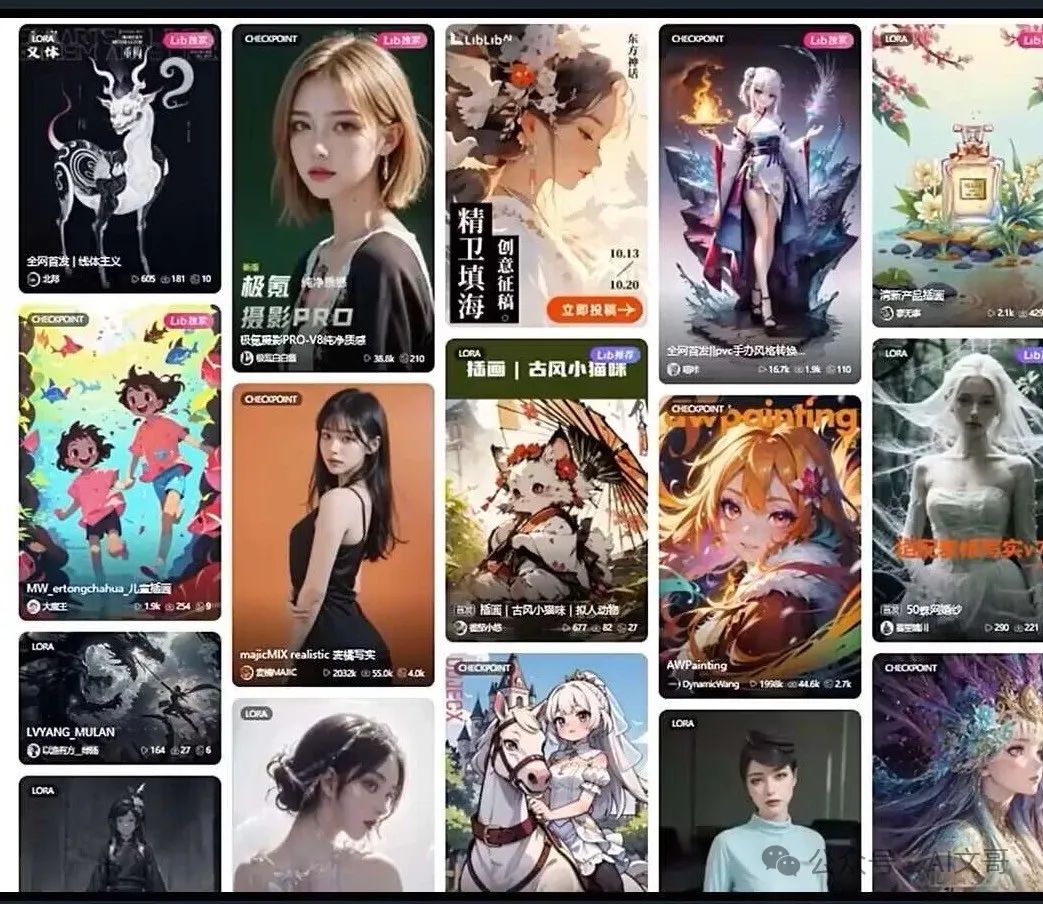

什么是 AI 绘画呢?什么是 AI 绘画呢?AI 绘画是指使用人工智能算法生成图像或绘画作品,它基于机器学习模型,可以接受不同的提示词、引导图等作为输入参数来生成各种风格和内容的视觉艺术品。比如,图 1 就是给 AI 输入提示词 a cute cat 得到的绘图结果。

AI绘画现在越来越火爆了,很多人无论大人小孩都在玩,还有的很多电商老板也在使用辅助生成产品主图和详情页,可以说是非常的实用。而其中最让人追捧和好评的就是SD(Stable Diffusion)这款AI绘图软件了,Stable Diffusion是一款基于深度学习的图像生成工具,它可以根据文本描述生成高质量的图像,而且是开源的非常友好和无私,现在更是有图生视频这么强大的功能。下面我详细介绍Stabl

截至2025年6月的最新市场调研显示,Stable Diffusion的用户规模已突破早期的小众阶段,呈现出显著的专业化发展趋势。具体用户数据表现为:国内ChatGPT用户规模已达2.8亿,Midjourney活跃用户约3000万,而Stable Diffusion的核心用户群已增长至800万量级。特别值得注意的是,SD在工业设计、电商视觉、建筑表现等专业领域的渗透率同比去年提升了47%,其精准可