简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

我们展示了 DeepSeek-V4 系列的预览版本,包括两个强大的混合专家(MoE)语言模型——DeepSeek-V4-Pro(总参数量 1.6T,激活参数量 49B)和 DeepSeek-V4-Flash(总参数量 284B,激活参数量 13B)——两者均支持一百万令牌的上下文长度。DeepSeek-V4 系列在架构和优化方面融合了多项关键升级:(1)一种结合了压缩稀疏注意力(CSA)和重度压缩

builder。

多模态诅咒的本质,是四重打击叠加:信息密度不对等引入噪声,参数容量竞争造成零和博弈,跨模态对齐污染文本权重,视觉 token 稀释关键注意力。行业打破它经历了三次范式跳跃:第一阶段靠数据配比和冻结策略少交税;第二阶段靠原生联合预训练和 MoE 解耦避免互相伤害;第三阶段靠推理型多模态把视觉压缩成高密度逻辑表示,让不同模态开始互相增强。对前沿模型来说,多模态正在从拖累变成增益。对中小模型和微调场景来

具身人工智能(Embodied AI)要求智能体能够感知、行动并预测其行为将如何重塑未来的环境状态。世界模型作为一种内部模拟器,能够捕捉环境动态,从而支持感知、预测和决策的前向与反事实推演。本综述为具身人工智能中的世界模型提出了一个统一的框架。具体而言,我们形式化了问题设定和学习目标,并提出了一个包含三个轴的分类法:(1)

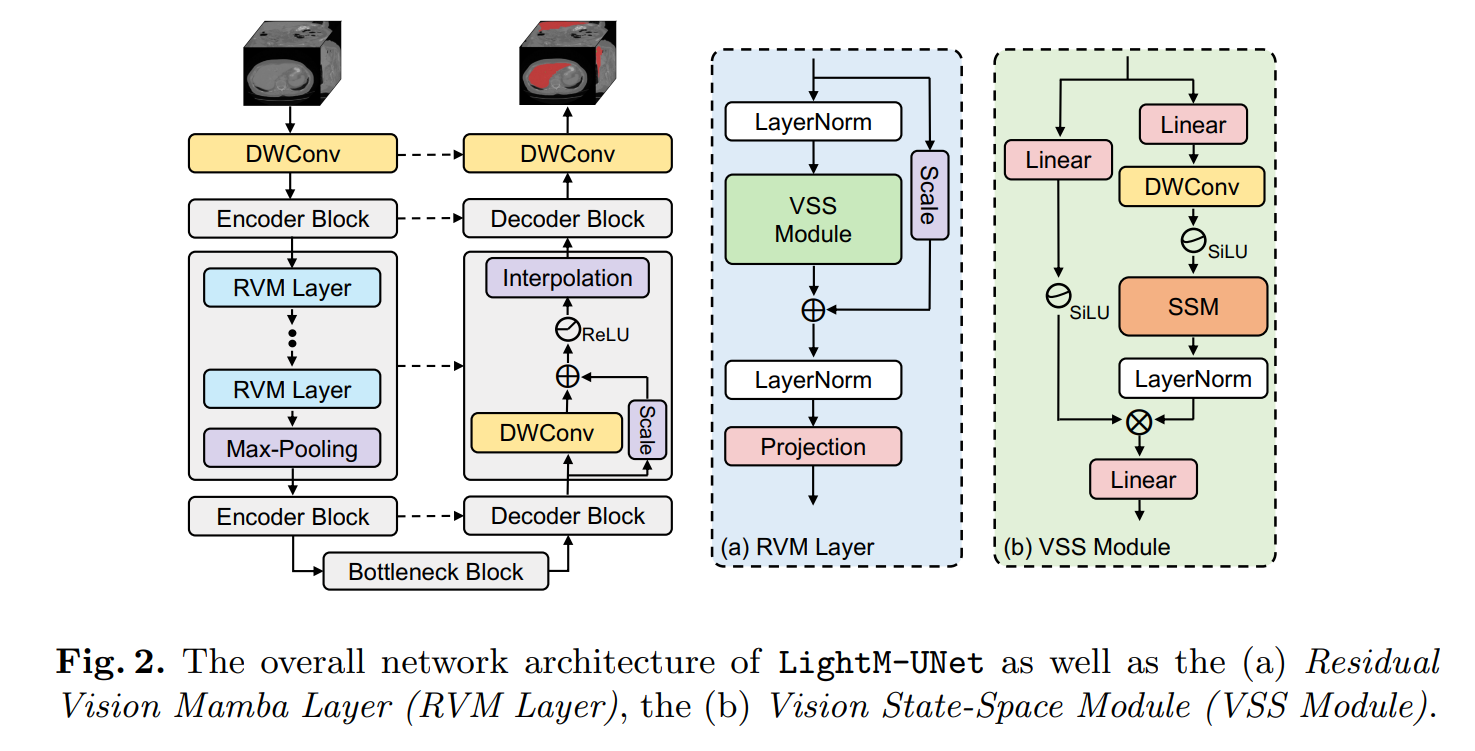

UNet [16],作为医学图像分割领域一个广为人知的算法,在涉及医学器官和病灶的各种分割任务中得到了广泛应用,涵盖了多种医学图像模态。其对称的U形编解码器架构与整体的跳跃连接为分割模型奠定了基础,催生了一系列基于U形结构的研究工作 [8,15,18]。然而,作为基于卷积神经网络(CNN)的模型,UNet受限于卷积操作的固有局部性,这限制了其理解显式全局和长距离语义信息交互的能力 [2]。一些研究

EMA是一种加权移动平均技术,其中每个新的平均值都是前一个平均值和当前值的加权和。在深度学习中,EMA被用于模型参数的更新,以减缓参数在训练过程中的快速波动,从而得到更加平滑和稳定的模型表现。

EMA是一种加权移动平均技术,其中每个新的平均值都是前一个平均值和当前值的加权和。在深度学习中,EMA被用于模型参数的更新,以减缓参数在训练过程中的快速波动,从而得到更加平滑和稳定的模型表现。

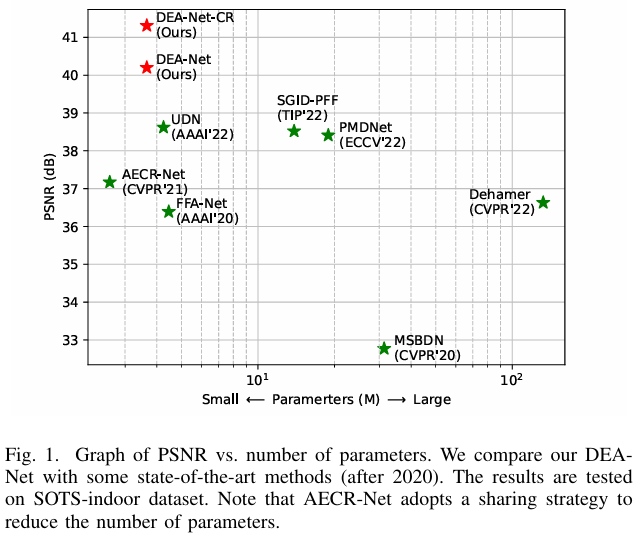

单幅图像去雾是一项具有挑战性的不适定问题,它旨在从观测到的雾图中估计出潜在的清晰图像。一些现有的基于深度学习的方法致力于通过增加卷积的深度或宽度来提高模型性能。卷积神经网络(CNN)结构的学习能力仍待充分探索。在本文中,我们提出了一种包含细节增强卷积(DEConv)和内容引导注意力(CGA)的细节增强注意力模块(DEAB),以增强特征学习,从而提升去雾性能。具体而言,DEConv将先验信息融入普通

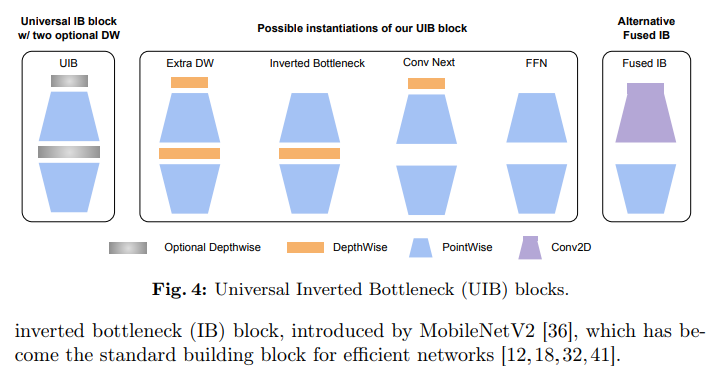

论文链接:https://arxiv.org/pdf/2404.10518MobileNetV4,作为新一代移动设备神经网络架构,凭借其创新的通用倒置瓶颈UIB块和Mobile MQA注意力块,实现了计算效率和运行速度的显著提升。该架构通过精炼的神经架构搜索NAS方法,创建了多个卓越性能的移动设备模型。新型知识蒸馏技术进一步提高了模型准确性,而Mobile MQA块相较于传统多头注意力,在移动加速

视觉语言模型(VLM)通常将视觉定位和检测形式化为坐标令牌生成问题,将每个2D框序列化为多个1D令牌,这些令牌被学习并很大程度上独立解码。这种逐令牌解码与框几何的耦合结构不匹配,并且由于严格的顺序生成而产生了实际的推理瓶颈。我们提出了LocateAnything,一个基于并行框解码(PBD)的统一生成式定位与检测框架。通过将几何元素(如边界框和点)作为原子单元一步解码,LocateAnything