简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

作为初学者,可以先学习基础。网络的话比较难,也是很抽象的,你做外网的渗透,至少要懂基础的http协议,知道端口是什么,知道网站是怎么架设起来的;操作系统的基础相对比较好学,主要是各种命令的作用,各种软件的安装和使用。计算机各领域的知识水平决定你渗透水平的上限,但是零基础并不是要把上面的全部都学的很好再去搞渗透,那不仅会劝退大部分人,而且像我前面说的深度学习很容易学的囫囵吞枣,最后反而竹篮打水一场空

网络的话比较难,也是很抽象的,你做外网的渗透,至少要懂基础的http协议,知道端口是什么,知道网站是怎么架设起来的;操作系统的基础相对比较好学,主要是各种命令的作用,各种软件的安装和使用。计算机各领域的知识水平决定你渗透水平的上限,但是零基础并不是要把上面的全部都学的很好再去搞渗透,那不仅会劝退大部分人,而且像我前面说的深度学习很容易学的囫囵吞枣,最后反而竹篮打水一场空。探测到疑似漏洞后,不能直接

计算机专业学生参加CTF比赛的实用指南 本文分享了一位计算机专业学生通过CTF比赛成功转型网络安全领域的经验。文章指出,计算机专业课程(如计算机网络、操作系统)为CTF打下基础,参赛经历对大厂安全岗求职有直接帮助。建议新手主攻Web和Crypto方向,组建3人互补团队,掌握Burp Suite等核心工具。比赛策略包括:前30分钟快速标记简单题目,利用编程优势写脚本提速,最后检查Flag格式。赛后需

同理心是促进亲社会行为的基础,可以通过分享个人经历的故事来唤起。虽然同理心受到叙事内容的影响,但直觉上,人们也通过叙事风格对故事的讲述方式做出反应。然而,同理心与叙事风格之间的关系尚未完全明了。论文通过大型语言模型(LLMs)和大规模众包研究实证检验并量化了这种关系。论文引入了一种新颖的理论基础分类法,HEART(人类同理心与叙事分类法),该分类法阐述了叙事风格中的元素,这些元素能够引导听众对故事

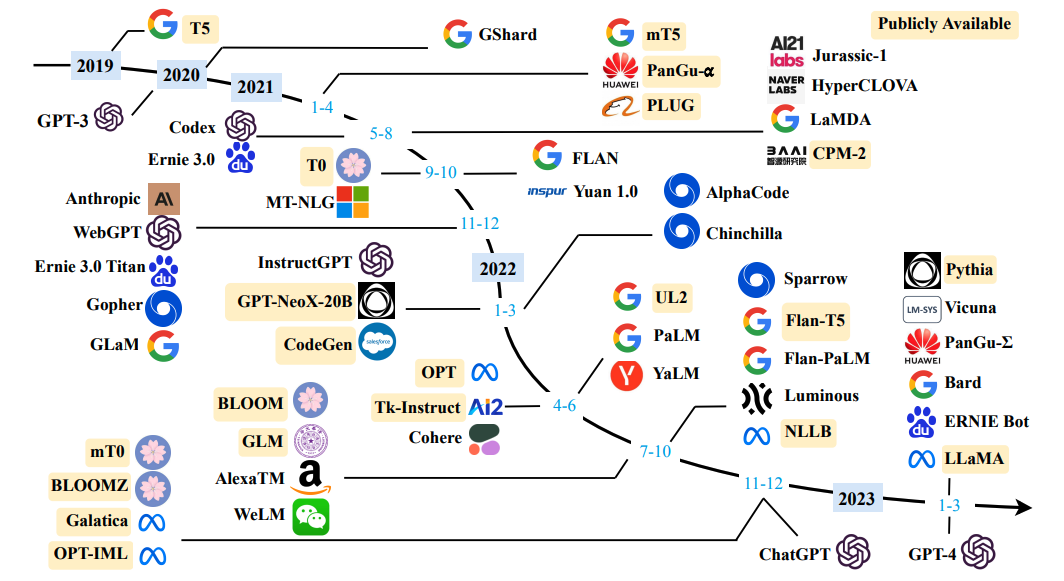

大语言模型(LLM)用于理解和生成自然语言和编程语言的人工智能模型。它可以帮助完成适用程度和成本效率不同的各种任务。本文通过测试来自同一基础模型的多个独立模型,以找到最佳的大语言模型。这一技术领域发展迅猛,尽管本文已尽可能保持时效性,也还是需要读者随时关注最新发布的模型,根据成本效益判断该模型是否更佳。官方网站:https://openai.com/图片来源:Unsplash。

原文:https://zhuanlan.zhihu.com/p/620360553要说2023刷屏最多的词条,ChatGPT可以说是无出其右。到最近的GPT-4,技术的革新俨然已呈现破圈之势,从学术圈到工业界再到资本圈,同时也真切逐步影响到普通人的日常生活与工作。坦白来讲,对于大语言模型生成相关的工作,个人长期以来持保守态度,认为这个方向更多的是一种深度学习的理想追求。现在看小丑竟是我自己,也许优

什么是网络安全?网络安全是指保护网络系统的硬件、软件及其系统中的数据,破坏、更改、泄露,使系统连续可靠正常地运行,网络服务不会中断。未来,我国将着重发展数字经济,发展云计算、大数据、物联网、工业互联网、区块链和人工智能等产业,这些产业全部都基于网络互联。网络的安全就是以上这些产业能够良性发展的基础,也是建设制造强国和网络强国的基础保障。什么是网络安全工程师?网络安全工程师是负责保护计算机网络系统,

网络空间安全建设刻不容缓,已成为国家安全建设的重中之重。随着境内外敌对势力的大规模安全事件,《国家网络空间安全战略》《网络安全法》《网络安全等级保护2.0》等一系列政策/法规/标准的持续落地,网络安全产业从小众产业逐步发展成为国家战略性新兴产业,与人工智能、大数据、云计算等领域并驾齐驱。“没有网络安全,就没有国家安全”。网络安全对于大部分政企单位来说,已经从[可选项]变成了[必选项]甚至是[强制项

网络安全职业发展指南(2025转行版) 本文系统梳理了网络安全行业的职业发展路径,为计划2025年转行的从业者提供实用指南。薪资方面呈现明显阶梯:初级(8-15k)、中级(15-30k)、高级(30-60k+),受地区、行业和公司规模影响。工作内容涵盖安全监控、渗透测试、漏洞修复等核心领域,部分岗位需应急响应值班。行业前景广阔,需求持续增长,伴随AI、云计算等技术演进催生云安全、物联网安全等细分领

网络安全职业发展指南(2025转行版) 本文系统梳理了网络安全行业的职业发展路径,为计划2025年转行的从业者提供实用指南。薪资方面呈现明显阶梯:初级(8-15k)、中级(15-30k)、高级(30-60k+),受地区、行业和公司规模影响。工作内容涵盖安全监控、渗透测试、漏洞修复等核心领域,部分岗位需应急响应值班。行业前景广阔,需求持续增长,伴随AI、云计算等技术演进催生云安全、物联网安全等细分领