简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本节介绍了 分词(Tokenization) 在自然语言处理中的重要性,并重点分析了 英文分词 与 中文分词 的差异。英文单词天然由空格分隔,但仍存在词形变化、缩写等问题,需要进一步处理。而中文没有显式分隔符,需依赖统计、词典或深度学习模型进行切分。

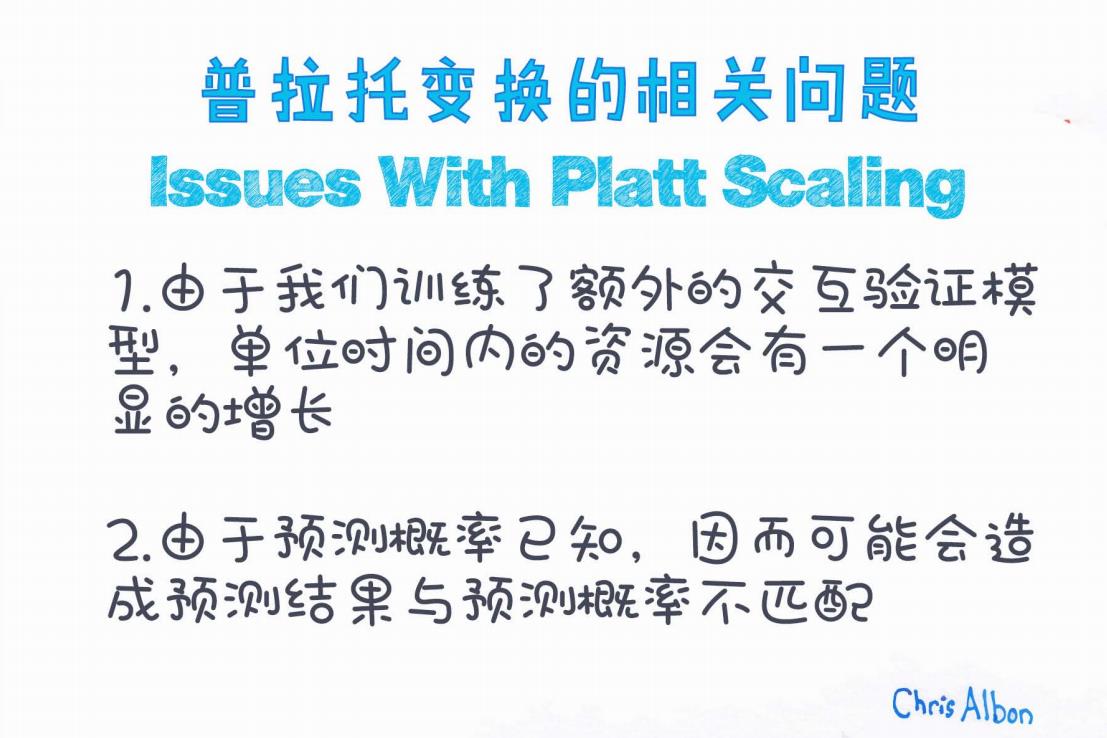

PlattScaling是一种广泛使用的概率校准方法,旨在将机器学习模型的输出分数映射为概率,以提高预测结果的可解释性和实用性。然而,这种方法并非没有缺陷。首先,PlattScaling通过训练额外的逻辑回归模型来实现校准,这通常需要进行交叉验证以避免过拟合,导致计算资源和时间的显著增加。其次,由于过分关注概率拟合,可能会导致预测概率与实际分类结果不一致,特别是在数据分布不平衡的情况下。为了解决这

K-means聚类算法是一种经典的无监督学习方法,通过迭代优化将数据划分为K个簇。算法流程包括初始化质心、分配数据点、更新质心直至收敛。K值选择可使用肘部法则或轮廓系数。该算法对初始点敏感,改进方法包括多次运行和K-means++初始化。虽然计算高效,但需预设K值且对异常值敏感。适用于客户细分、图像分割等场景,Python实现简便。

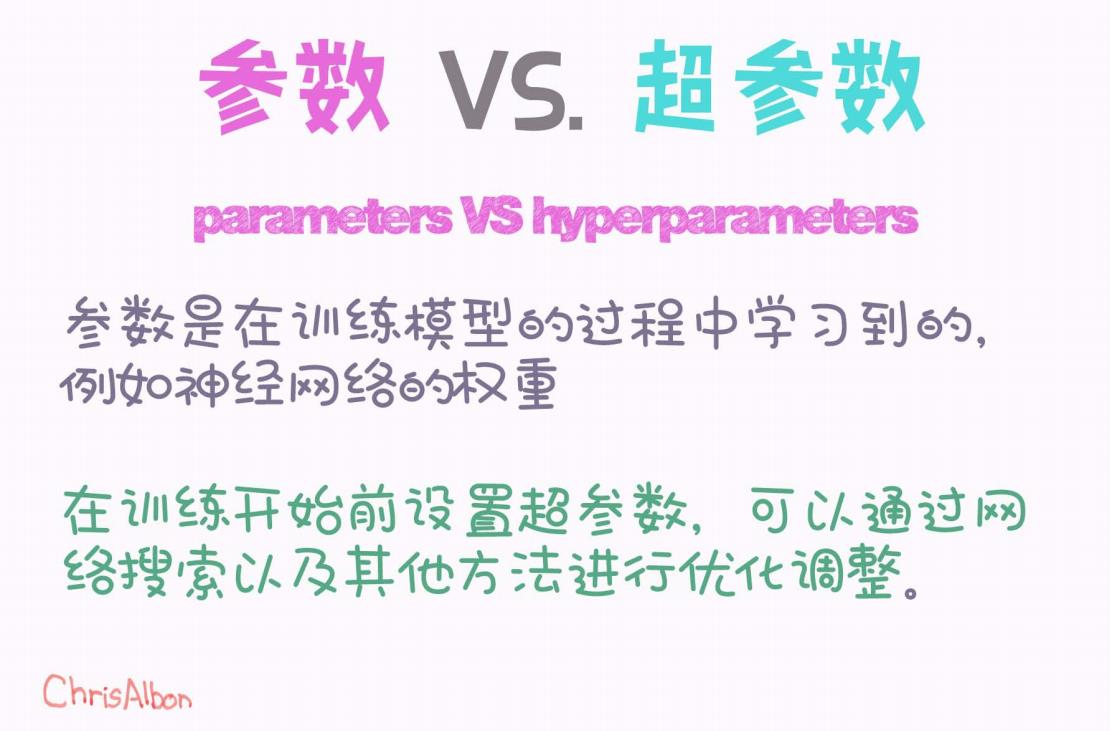

在机器学习中,"参数"(parameters)和"超参数"(hyperparameters)是两个非常基础却又容易混淆的概念。理解它们的区别和作用,是深入掌握机器学习的第一步。

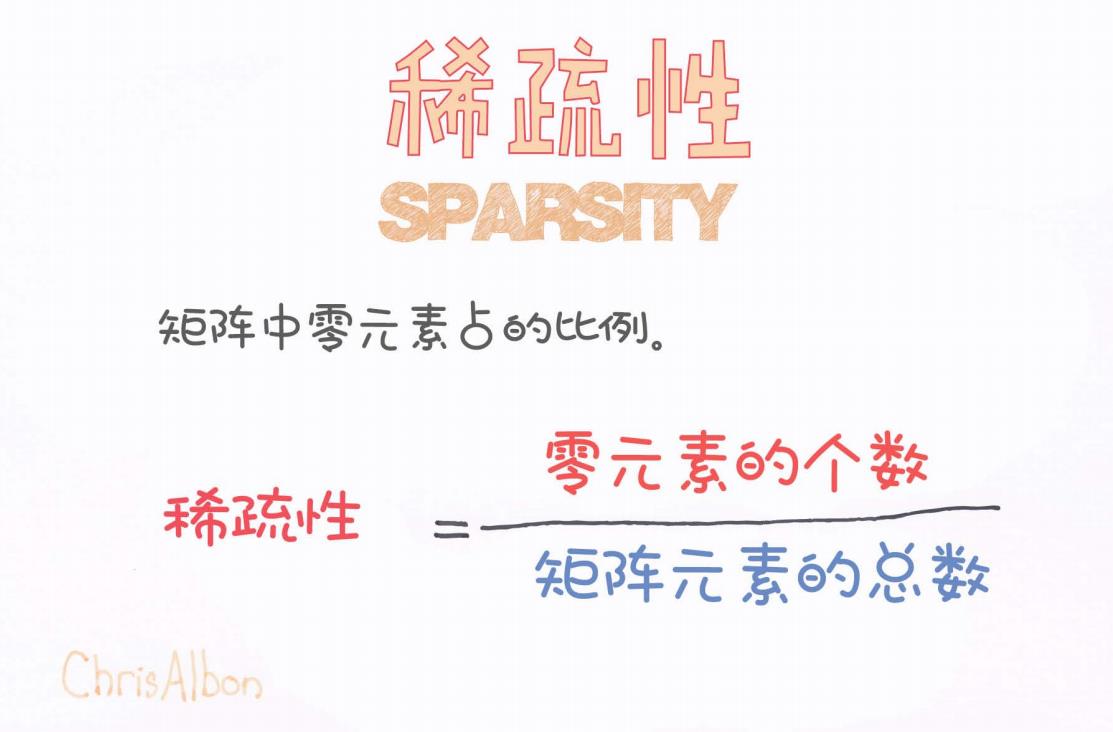

在数据科学、机器学习、线性代数等多个领域中,矩阵是一个常见而基础的数学工具。而在处理大型矩阵时,我们经常会遇到“稀疏矩阵”(Sparse Matrix)。稀疏性(Sparsity)正是描述一个矩阵中“有多少是零元素”的一个重要概念。理解和利用稀疏性,有助于我们提升数据存储效率、加速运算过程。

本文详细介绍了神经网络中的关键组件及其作用,包括激活函数(Sigmoid、Tanh、ReLU等)、损失函数(MSE、交叉熵等)、Dropout正则化技术,以及梯度消失/爆炸问题与过拟合/欠拟合现象的成因与解决方案。这些组件共同决定了神经网络的性能和稳定性,合理选择与优化这些组件是构建高效神经网络模型的基础。文章还提供了各类组件的数学公式、特点分析和常见优化策略,如使用ReLU激活函数缓解梯度消失、

在数据科学、机器学习、甚至哲学中,我们常常会面对一个核心问题:不确定性。无论是预测天气、疾病发展,还是评估人工智能的决策,不确定性始终存在。

极值是数学分析和优化问题中的一个核心概念,指函数在某个定义域内取得的最大值或最小值。极值是分析函数行为的重要工具,广泛应用于优化、建模和决策中。通过数学条件和数值方法,可以有效地识别和验证极值点,从而指导实际问题的求解。

在机器学习和深度学习的模型训练过程中,超参数调优(Hyperparameter Tuning)是至关重要的一环。随机搜索(Randomized Search)是一种高效的超参数优化方法,它通过在候选超参数的数值分布(如正态分布、均匀分布等)中随机选择超参数组合,从而找到最优的超参数配置。

在人工智能(AI)和机器学习(Machine Learning,ML)领域,我们常听到“机器学习”这个术语,但“学习”究竟意味着什么?机器如何学习?它的学习过程与人类的学习有何异同?