简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

类别代码为“01”(表示电子产品),品牌代码为“02”(表示品牌B),系列代码为“03”(表示系列C),列号为“0001”。接口分配不同的限流配额,确保关键接口的可用性,但需要维护API接口的限流配置。型号:ABC123(运动鞋的通用型号) 这样,无论你销售多少不同变种的鞋子,它们都被列为同一款产品的不同变种,方便顾客在在线商店中浏览和比较。这种方式可以为不同的请求类型分配不同的限流配额,确保关键

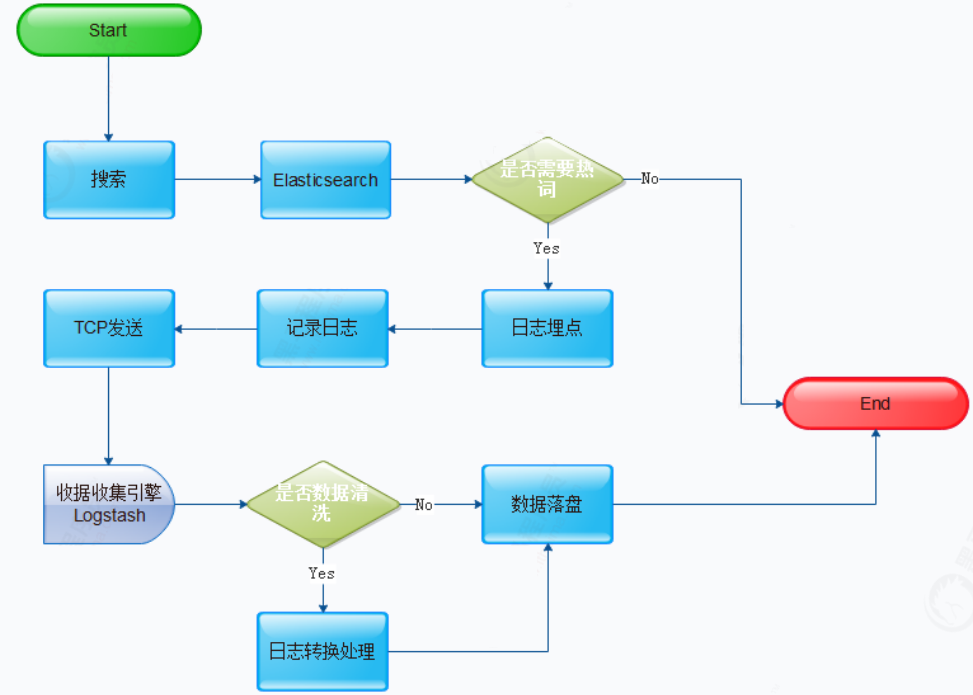

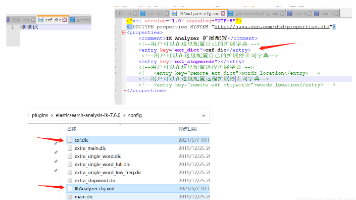

另外这里的host是部署了Logstash服务端的地址,并且端口号要和你在Logstash里配置的一致才行。从配置文件中可以看到,这里使用的是Socket Appender来将日志打印的信息发送到Logstash。注意了,Socket的Appender必须要配置到下面的Logger才能将日志输出到Logstash里!获取es-log索引中的文档数据并对其进行分组,统计热搜词出现的频率,根据频率获取

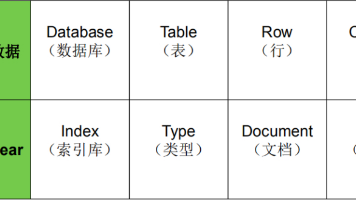

分词:即把一段中文或者别的划分成一个个的关键字,我们在搜索时候会把自己的信息进行分词,会把数据库中或者索引库中的数据进行分词,然后进行—个匹配操作,默认的中文分词是将毎个字看成一个词,比如“我爱中国”会被分为"我"“爱”“中"国”,这显然是不符合要求的,所以我们需要安装中文分词器IK来解决这个问题。如果要使用中文,建议使用IK分词器!IK提供了两个分词算法: ik_smart和 ik_max_wo

上线前务必把核心索引写死。明确:字段类型、是否索引、所需 fields 及分析器。不让 ES 自己猜。当你不手动定义索引映射(Mapping)时,ES 会根据插入的第一条数据 “猜” 字段类型:数字可能被识别为text(文本),导致排序 / 聚合时需要额外转换,性能下降;手机号 / 身份证号被识别为long,但超出数值范围会报错;所有字段默认开启索引,即使是不需要检索的字段(如备注、日志详情),浪

primary_term: _primary_term主要是用来恢复数据时处理当多个文档的_seq_no一样时的冲突,避免Primary Shard上的写入被覆盖。在_msearch中,请求格式和bulk类似。Shard级别严格递增,保证后写入的Doc的_seq_no大于先写入的Doc的_seq_no。_seq_no和_primary_term是对_version的优化,7.X版本的ES默认使用这

StarRocks 是新一代极速全场景 MPP (Massively Parallel Processing) 数据库。StarRocks 的愿景是能够让用户的数据分析变得更加简单和敏捷。用户无需经过复杂的预处理,就可以用 StarRocks 来支持多种数据分析场景的极速分析。StarRocks兼容 MySQL 协议,支持标准 SQL 语法,易于对接使用,全系统无外部依赖,高可用,易于运维管理。

Python 操作 PDF 会用到两个库,分别是:PyPDF2 和 pdfplumber。PyPDF2 可以更好的读取、写入、分割、合并PDF文件;pdfplumber 可以更好的读取 PDF 文件中内容和提取 PDF 中的表格,主要应用于机器生成的PDF,而非扫描的PDF文档。

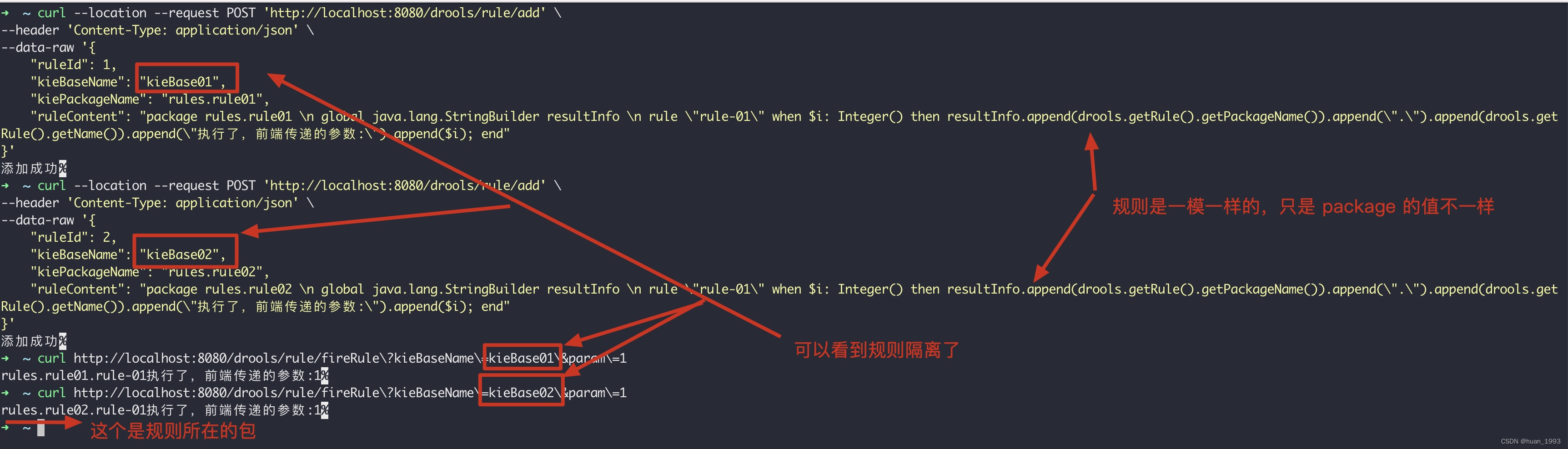

1、加一个DroolsManager加载时,从数据源中读取规则,然后依次添加。3、数据库部分没有完整实现,可以考虑实现多种数据源,其实mysql一种就够了。可以参照大佬写的引(我没试过),或者按照我上面的引入。

使用阿里云镜像仓库,docker push了之后,使用docker pull可以成功拉取仓库中的镜像。提示说使用docker login,可是我已经docker login过了呀!