简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

别再看国外了,谁说国内没有好教程!国内AI圈硬核好课 —— 上海交大教授团队重磅发布的全套AI Agent系统学习路线,一经曝光就引爆全球技术圈,无数开发者连夜蹲守学习,彻底打破 “Agent 只有高端人才能玩” 的壁垒!

在产品经理学习使用AI的道路上,试错和成长是必经之路。每一位成功驾驭AI工具的产品经理,都经历过不断尝试和持续改进的过程。有些尝试可能不尽如人意,但正是这些经历帮助他们形成了自己独特的工作方法。对于刚开始在工作中应用AI的产品经理来说,不必因为初期的不完美而气馁。可以先从一些基础场景开始尝试,比如文档撰写、会议记录或竞品分析等日常工作。在实践中逐步建立对AI工具的认知,找到最适合自己的使用方式。作

诸如ChatGPT等生成式人工智能(GenAI)已万众瞩目,基于Transformer的大型语言模型(LLMs)在大量未标记数据上进行训练,可以泛化到诸多不同类型的任务。为了更好地理解LLMs如此强大的真实原因,我们将在本博中深入探究它们的工作原理。LLM演进树形式上,一个仅有解码器的语言模型只是一个条件分布p(xi|x1···xi−1),在已知上下文为x1····xi−1 的情境下,下一个标记x

大模型开发遇到的问题及langchain框架学习如下

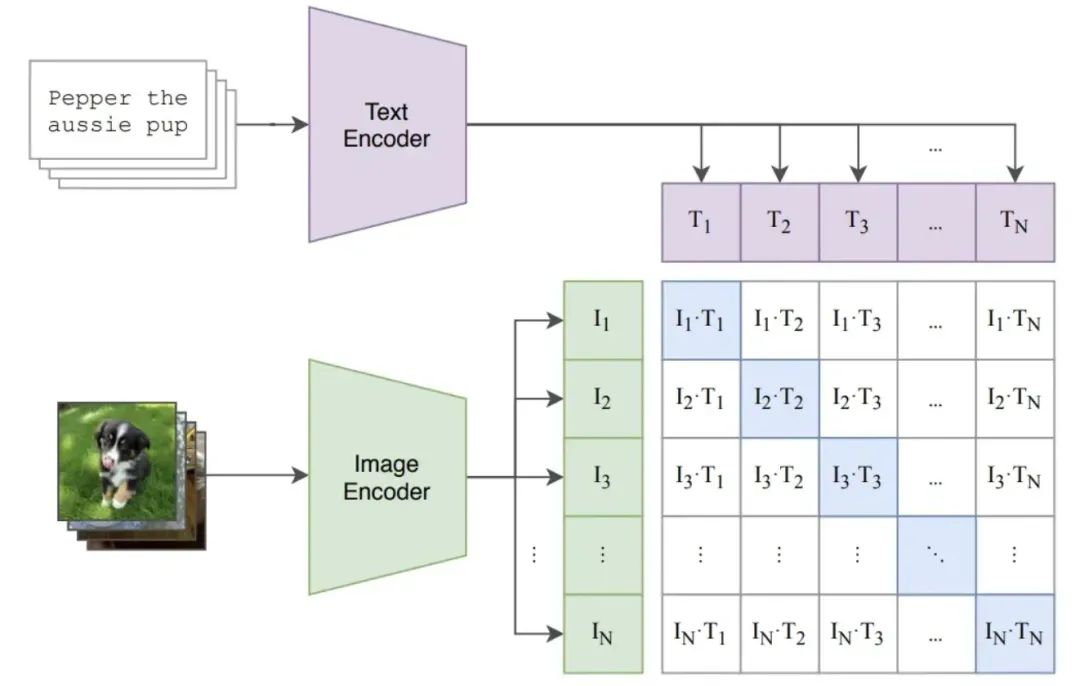

看了这些多模态的研究后,多模态的研究做的事情主要是:不同模态进行对齐不同模态进行融合指令微调促进人机交互,数据的质量可能比数量更重要模型设计既要保证检索任务下的高效推理,又要能够进行多模态深度融合进入大语言模型时代前,用更大的图像编码器一般是更有效的进入大语言模型时代后,图文理解能力的强大可能来自于大语言模型的能力进入大语言模型时代后,视觉优先仍然是值得探索的方向,但是训练大视觉模型向来是比较困难

本书详细介绍了大语言模型和多模态大模型的发展历史、技术原理和亮点、主要的开源框架、配套工具、部署细则和实战案例。为了让读者更好地进行大模型的应用实战,本书还详细介绍了使用大模型为商业赋能的3个应用案例。期望本书能够帮助读者打开通往大模型尤其是多模态大模型的学习、实战和商业成功之路。

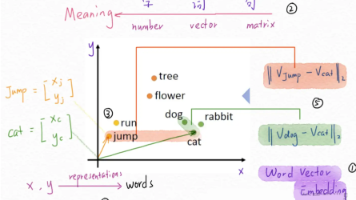

LLM大模型与Embedding模型的区别及RAG应用 大型语言模型(LLM)和嵌入模型(Embedding)是NLP的两大核心技术,但存在显著差异: 功能差异:LLM用于文本生成和理解,Embedding模型专注于将文本转换为数值向量表示 应用场景:Embedding模型适用于文本相似度计算、信息检索和聚类分析 资源效率:在RAG(检索增强生成)架构中,单独设置Embedding模型可降低资源占

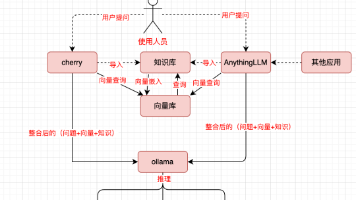

本文介绍了两种基于DeepSeek大模型搭建本地知识库的方法。首选方案是使用Cherry Studio,通过配置本地Ollama服务、嵌入模型和知识库,实现文档向量化存储和智能检索;备选方案是采用AnythingLLM,同样支持本地模型部署和文档管理。两种方案均强调数据隐私保护,适合开发人员构建个性化知识管理系统。文章还提供了大模型学习资料获取方式,帮助读者系统掌握AI大模型技术。整体方案实现了离

本文介绍了如何通过Ollama和OpenWeb-UI在个人电脑上搭建本地多模态大模型,实现智能问答、图像分析等功能。文章详细说明了Ollama和OpenWeb-UI的特点与使用场景,并提供了MacOS系统的具体部署教程,包括Docker安装、Ollama配置以及OpenWeb-UI的搭建步骤。该方法支持跨平台使用(Windows、macOS、Linux),确保数据安全和隐私,还可结合Dify构建本

AI产品经理与传统产品经理的差异主要体现在技术应用和职责范围上。AI产品经理专注于应用AI技术(如语义、语音、计算机视觉和机器学习)进行产品设计、研发和生命周期管理,需与数据科学家紧密合作,关注数据质量、模型迭代及伦理风险。传统产品经理则更注重市场需求、竞争分析和产品全生命周期管理,强调与市场、销售等团队的协作。随着AI技术的发展,AI产品经理通过提升运营效率和个性化体验,为企业带来显著效益,而传