简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文深度分析了23个主流开源智能体框架,涵盖从LangChain、AutoGPT到最新的Microsoft Agent Framework等不同类型。文章详细比较了各框架的技术架构、适用场景和特点,帮助开发者根据业务需求进行技术选型。当前智能体框架已进入产业落地阶段,未来随着MCP、A2A等协议普及,跨框架协作将成为新趋势。本文为AI智能体应用开发提供了全面的技术参考指南。

在大模型智能体快速发展的今天,FastGPT和Dify作为两个最具代表性的开源智能体开发平台。FastGPT专注于知识库问答和RAG场景的深度优化,而Dify则致力于构建基于LLM的Agent智能体应用程序,降低开发门槛,支持多种应用类型。

ReAct模式将大模型的内部思考与外部行动相结合,形成"思考→行动→观察"的智能闭环。这种模式通过外部工具验证想法,有效解决大模型的"幻觉"问题和知识局限性,使模型决策更可靠。文章详细介绍了ReAct的核心概念、优势价值、实战案例及代码实现,为构建高级智能体提供了理论基础和实践指导。

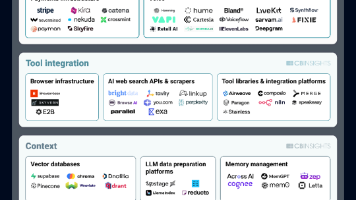

AI智能体技术栈分为六层架构,从底层基础模型到顶层治理,层层递进支撑智能体的思考、行动、记忆、协作与安全能力。文章详细解析了各层核心构成与代表企业,并指出语音、安全、支付三大新兴机遇。当前面临可靠性与数据整合等挑战,未来智能体市场平台、货币化和成本管理将成为重点。技术栈的成熟将推动智能体从信息查询迈向自主交易,重塑各行业业务环节。

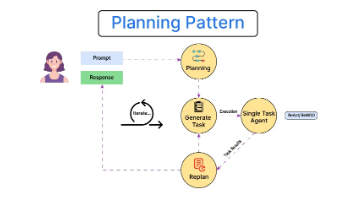

文章介绍了《Agentic Design Patterns》一书中21种智能代理设计模式,这些模式是构建AI智能代理的经验范式。与传统LLM应用相比,智能代理具备自主闭环决策、目标驱动、工具使用等优势。文章归纳了任务流程、推理改进、工具协作、记忆管理、目标规划、系统优化等六大类模式,并介绍了LangChain、CrewAI等框架,帮助开发者构建更清晰、易维护的智能代理系统。

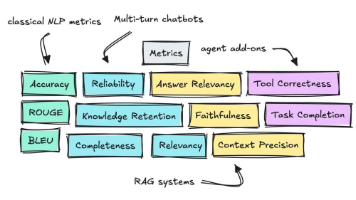

文章详细介绍了大语言模型应用的评估方法,重点讲解了多轮对话、RAG和智能体应用的评估指标,并推荐了RAGAS、DeepEval等实用评估框架,帮助读者选择合适的工具进行LLM应用评估,确保系统性能稳定。

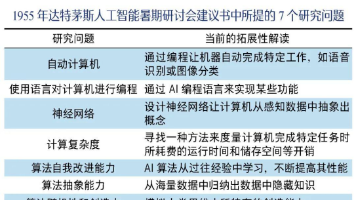

本文系统介绍了人工智能历史背景和大模型发展脉络,从图灵测试到多模态革命。解析了Scaling Law原理和涌现能力,探讨了大模型幻觉问题和思考本质。分析了成本下降趋势和数据枯竭挑战,提出高质量数据和AI生成数据解决方案。为读者提供从理论到实践的全面视角,帮助理解AI大模型发展现状和未来方向。

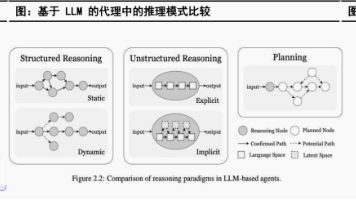

本文介绍了大模型Agent智能体的四大设计范式:反思模式通过自我评估和迭代提升输出质量;工具使用模式借助外部API扩展能力,实现任务模块化;规划模式将复杂任务分解为多步骤并制定执行计划;多智能体协作模式让多个AI各司其职、互相配合。这些模式可根据实际需求灵活组合,推动AI技术创新与发展。

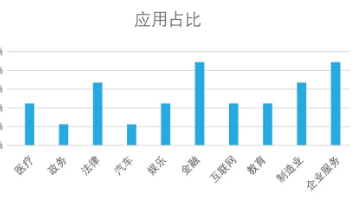

AI Agent是具备自主决策能力的智能实体,区别于LLM和传统自动化,处于AGI分级L3阶段。当前AI基础设施面临重构,微软、谷歌等云厂商积极布局Agent平台。据预测,2032年AI Agent营收将达1036亿美元,CAGR 44.9%。Agent平台由90%软件工程和10%AI组成,核心包括感知、记忆、决策和执行层。AI数据基础设施正向多模态、低门槛方向发展,企业将根据AI/工具部署能力重

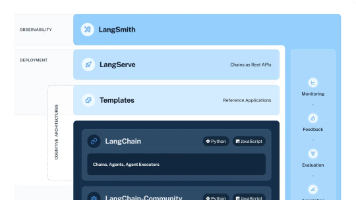

本文全面介绍了七大主流AI Agent开发框架:LangGraph、AutoGen、CrewAI、OpenAI Agents SDK、Google ADK、MetaGPT和PydanticAI。每个框架各有特色,LangGraph专注于有状态工作流,AutoGen支持多智能体协作,CrewAI强调高性能与灵活性,OpenAI Agents SDK提供简洁核心原语,Google ADK注重模块化部署