简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

关于语言模型的经济影响,我想先谈谈市场的影响。我们看到一些服务领域的变化速度比预期的要慢,比如 CHEG 和其他相关服务的表现。对此,您是否认为学术界应该获得人工智能补贴?还是说,他们应该与大公司合作?我个人非常努力地推动为大学争取数据中心。如果我是计算机科学系的教员,我会非常沮丧,因为无法和我的研究生一起构建能够进行那种博士研究的算法,这让我不得不与公司合作。然而,我认为公司在这方面并不够慷慨。

然而,现在看来,他们似乎已经失去了对 OpenAI 的主动权。甚至在最近的一些排行榜上,我看到了Anthropic的名字,Claude排在了榜首。我曾就此询问桑达尔,他并没有给我一个非常明确的答案。也许,您对此有更清晰或更客观的解释。为了完全披露,我现在已经不再是谷歌的员工。谷歌选择了强调工作生活的平衡,鼓励员工早点回家或在家工作,而非专注于获胜。而创业公司的成功原因在于,他们的人们拼命工作。很抱

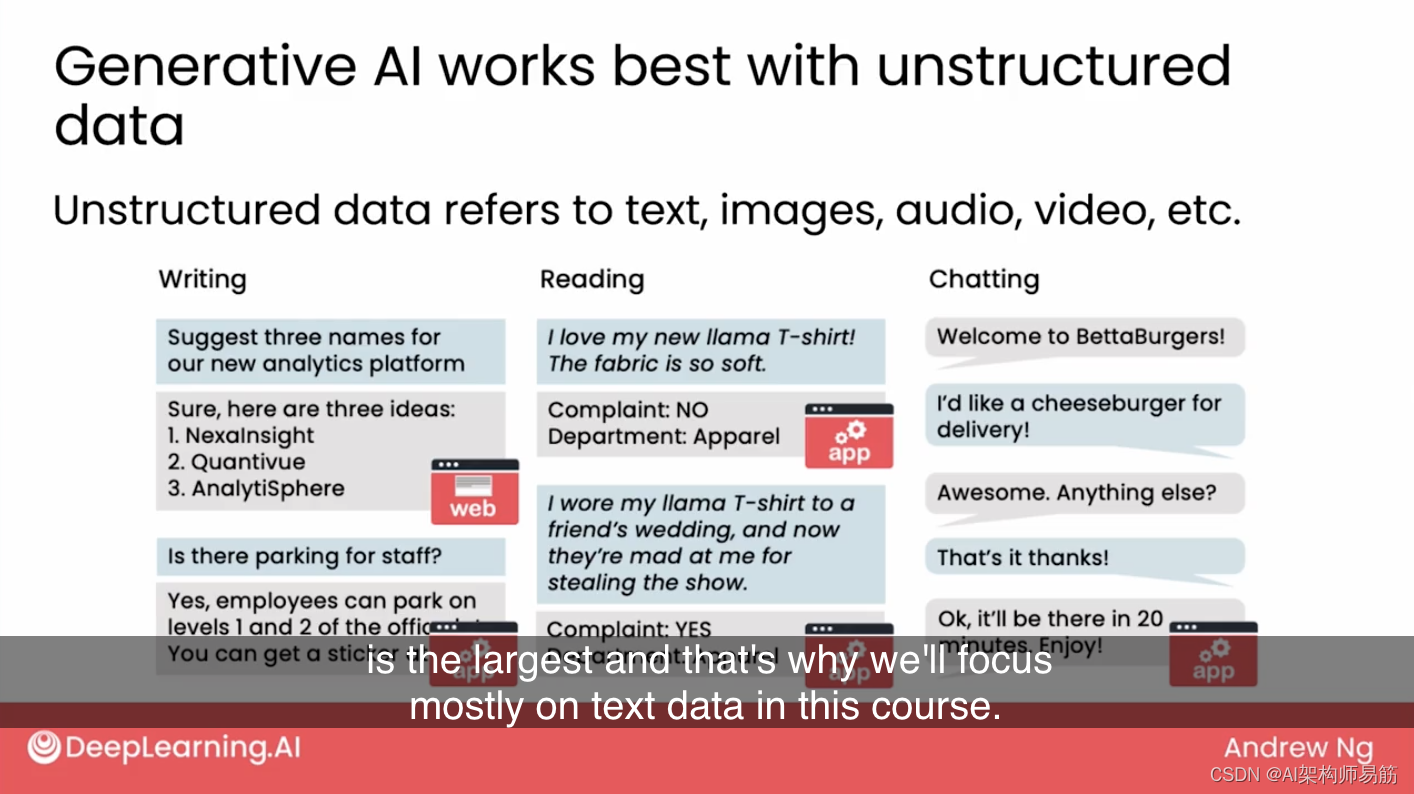

生成式 AI 是一项惊人的技术,但它并非万能。在这个视频中,我们将仔细看看大型语言模型(LLM)能做什么,不能做什么。我们将从我发现的一个有用的心理模型开始,了解它能做什么,然后一起看看 LLM 的一些具体限制。我发现理解这些限制可以降低你在尝试使用它们做它们不擅长的事情时被绊倒的机会,所以让我们深入了解一下。如果你想弄清楚引导 LLM 能做什么,这里有一个问题,我发现它提供了一个有用的心理框架。

例如,智能可能被用来开发一种新的实验范式,使我们能够在体外学习过去需要活体学习的东西 动物实验,或构建收集新数据所需的工具(例如更大的粒子 加速器),或者(在道德限制内)找到绕过人为限制的方法(例如帮助 改善临床试验体系,帮助建立临床试验较少的新管辖区 官僚主义,或者改进科学本身,使人体临床试验变得不那么必要或更便宜)。因此,我们应该想象这样的画面:智能最初受到其他生产要素的严重限制,但随着时间的

通过上述各种主题,我试图描绘出一个既合理又 如果人工智能一切顺利,情况会比现在好得多。我不知道这是否 世界是现实的,即使现实,如果不付出巨大的努力和 许多勇敢而敬业的人都在为此奋斗。每个人(包括人工智能公司!)都需要这样做 他们的 既要防范风险,又要充分实现效益。但这是一个值得为之奋斗的世界。如果这一切真的在 5 到 10 年内实现——大多数疾病被击败、生物和认知自由得到增长、数十亿人摆脱贫困并享

计算梯度是机器学习里面最贵的一部分,所以不能太小2. 线性回归的从0开始实现yield 表示随机的返回学习率很小从0.003 改为0.001的情况下,loss变化很小学习率很大从0.003 改为10的情况下,loss变化求不出来,有可能y变化是0,做除法就出现异常了。3. 线性回归的简介实现nn.Sequential: list of layer参考https://www.bilibili.com

正如我们在第 2.4 节中所解释的,微分是几乎所有深度学习优化算法中的关键步骤。虽然获取这些导数的计算很简单,只需要一些基本的微积分,但对于复杂的模型,手动计算更新可能会很痛苦(而且通常容易出错)。深度学习框架通过自动计算导数来加速这项工作,即自动微分。在实践中,基于我们设计的模型,系统构建了一个计算图,跟踪哪些数据通过哪些操作组合以产生输出。自动微分使系统能够随后反向传播梯度。在这里,反向传播只

1. 环境搭建2. 环境搭建起来后,环境架构介绍3. 环境如何用4. 部署 Chaincode5. 智能合约的调用

卷积审计网络 看书太复杂,被劝退的概率太高。1. 卷积 – 用吃饭消化 来理解卷积函数 f(t)g(x-t)卷积:不稳定输入,稳定输出,求系统存量卷积就是把g(x) 函数翻转了,因为翻转了,所以叫做卷积2. 卷积神经网络 的主要功能是识别图片里面的内容,比如图片是猫是狗周围像素点如何对当前的点产生影响图像的卷积操作f(t) = 不稳定输入g(x-t) = 稳定输出电脑里面的图片都可以看作是一个一个

案例:跨境电商如何用ChatGFT选品ChatGPT+素材和资料来自:Jungle ScoutEM, Michael Soltis 和 文韬武韬AIGC。