简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

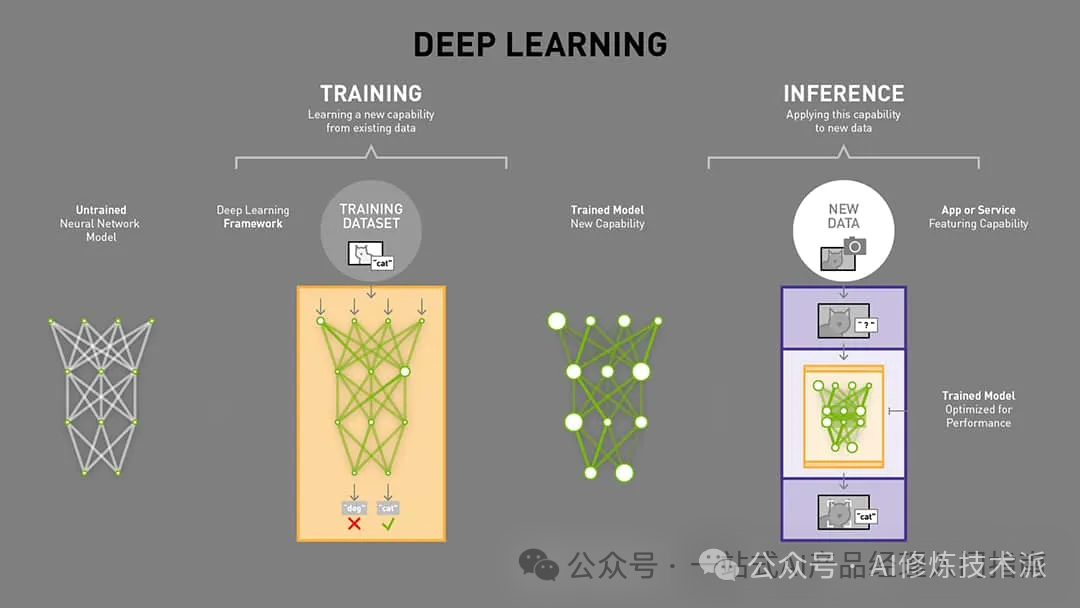

一文搞懂AI人工智能大模型训练、推理、微调

TorchVision是PyTorch库的一个扩展库,TorchVision拥有计算机视觉中最常见的图像转换功能,还包含计算机视觉神经网络的数据集和模型架构以及常见数据集。它包含数学库、并行算法库、图像和视频库、通信库和深度学习库,可用于各种任务,例如:人脸识别、图像处理、3D图形渲染等。Keras是一个基于Python的开源软件库,对初学者来说特别易用,它允许快速构建神经网络模型,是一个模块化的

人工智能专业术语

语言模型」是一种「人工智能系统」,旨在处理、理解和生成类似人类的语言。它们从大型数据集中学习模式和结构,使得能够产生连贯且上下文相关的文本,应用于翻译、摘要、聊天机器人和内容生成等领域。图片。

OpenClaw 的提供商文档中也包含 Ollama 快速入门指南,以及一个容易让人困惑的关键细节:即使 Ollama 本身并不验证 API 密钥值,OpenClaw 仍然要求该密钥值存在。它还列出了启动器的功能:如果需要,通过 npm 安装 OpenClaw,显示安全提示,选择模型,然后配置并启动网关。否则,您可能会破坏工具格式,导致出现“OpenClaw 已损坏”的提示,而实际上这只是您自定义

使用 onnxruntime-gpu 进行推理,运行时间久了,显存被拉爆。

yolov8目前不支持单通道图片训练,需要修改后才能支持。

MMDeploy 定义的模型部署流程

一、各个组件的功能描述:Docker 是一个开源的应用容器引擎。Jenkis 是一个开源自动化服务器。(1).负责监控gitlab代码、gitlab中配置文件的变动;(2).负责执行镜像文件的构建、上传与下载;(3).通过Rancher插件系统构建stack/service;GitLab: 是一个用于仓库管理系统的开源项目,使用Git作为代码管理工具。(1).保存项目配置文件;(2).nginx定

本文介绍了在Kubernetes环境下搭建分布式深度学习训练平台的全流程。首先详述了Kubernetes集群的部署和验证方法,包括网络插件安装和工作节点添加。其次讲解了深度学习环境的容器化配置,包括Docker镜像构建和Kubernetes资源分配。重点展示了TensorFlow和PyTorch两种框架的分布式训练实现方案,涵盖代码编写和Kubernetes Job配置。最后提供了监控工具选择和性