简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

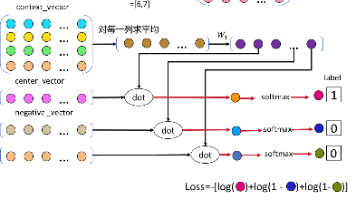

负采样是一种用于优化词向量训练的技术,主要应用于CBOW和Skip-gram模型。其核心思想是通过随机采样少量负样本(中心词与非上下文词组成的词对),将原始的多分类问题转化为二分类问题,模型通过区分正样本和负样本来更新词向量。负采样策略通常基于词频,高频词更可能被选为负样本,并通过词频的3/4次方进行平滑处理。负采样的优势在于显著降低了计算复杂度,从O(V)降至O(K+1),提升了训练速度,同时增

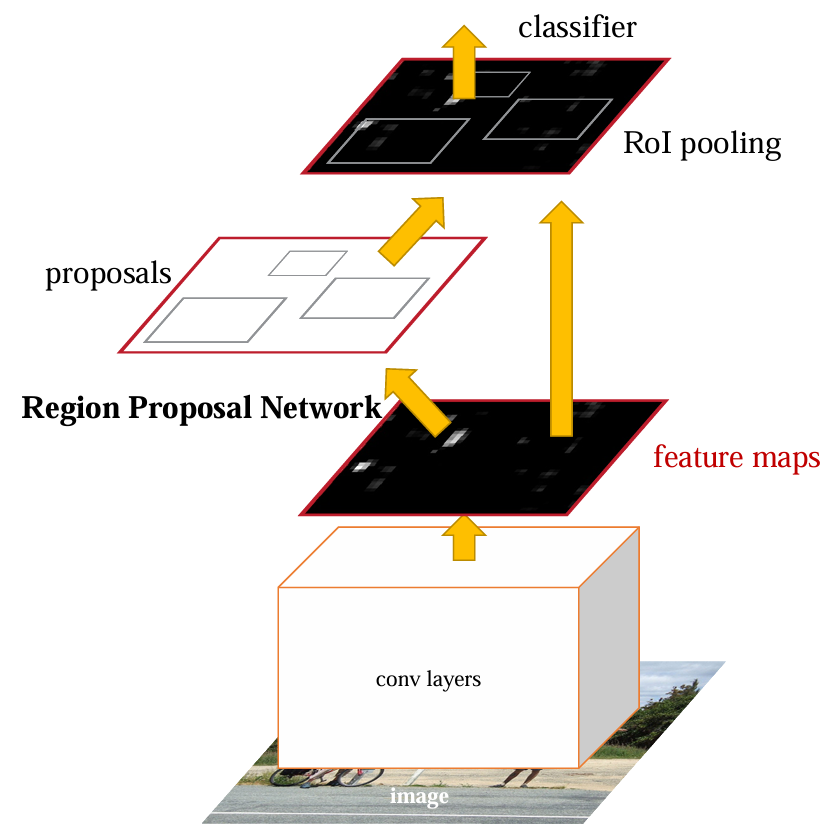

由Shaoqing Ren, Kaiming He, Ross B. Girshick和Jian Sun在2015年提出 的,它是Fast R-CNN的改进版本。 其主要创新在于引入了区域建议网络 (Region Proposal Network, RPN),使得整个目标检测过程能够在一个 神经网络中完成,从而大幅提高了检测效率和准确性。

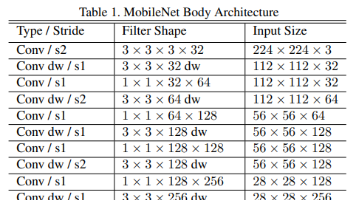

MobileNets模型基于深度可分离卷积构建,这是一种将标准卷积分解为深度卷积和1x1卷积(称为逐点卷积)的卷积分解形式。 深度卷积将单个滤波器应用于每个输入通道,而逐点卷积则用于组合深度卷积的输出。 这种分解大大减少了计算量和模型大小。

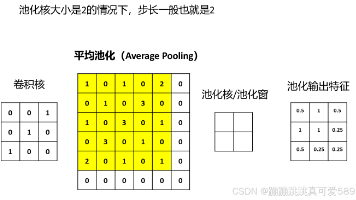

池化(Pooling)是卷积神经网络(CNN)中的一种关键操作,通常位于卷积层之后,用于对特征图(Feature Map)进行下采样(Downsampling)。其核心目的是通过压缩特征图的尺寸来减少计算量,同时保留最重要的特征信息,增强模型的鲁棒性和泛化能力。池化层不包含可学习的参数(如权重),而是通过固定的数学操作(如取最大值或平均值)实现特征压缩。

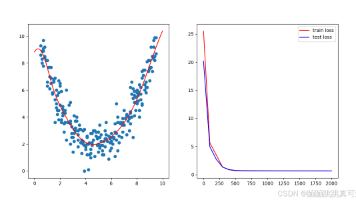

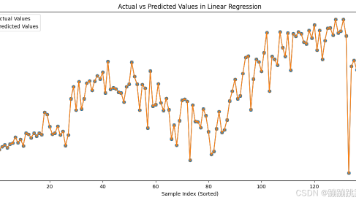

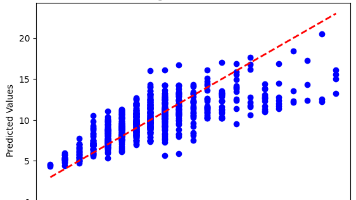

线性回归是一种基本的预测分析方法,它通过拟合一条直线来描述自变量(特征)与因变量(目标)之间的关系。曲线回归是一种用于拟合非线性关系的回归分析方法。与线性回归不同,曲线回归允许因变量与自变量之间存在更复杂的关系。常见的曲线回归形式包括多项式回归、指数回归和对数回归等。在多项式回归中,我们可以通过引入高次项来扩展模型的灵活性。

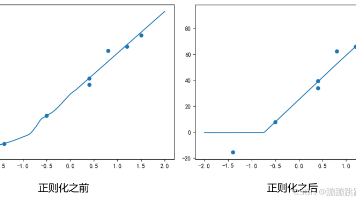

在深度学习中,防止特征探测器间的共同适应(co-adaptation)是提高神经网络性能的重要策略。共同适应指的是特征探测器在训练过程中互相依赖,使得网络对特定的输入模式过于敏感,从而导致过拟合。通过引入正则化技术,如Dropout,可以有效减少这种适应性。在训练过程中,Dropout随机地丢弃一部分神经元,使得网络在每次迭代中都依赖于不同的子集特征,从而强迫网络学习更加鲁棒的特征表示。这不仅提高

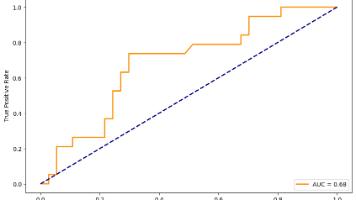

在本例中,使用了乳腺癌数据集 Breast Cancer - UCI Machine Learning Repository,其中包含 关于病人的信息,目标是预测肿瘤是否为无复发事件(no-recurrence-events)或有复发事件 (recurrence-events)。

本例使用了一个Bike Sharing Dataset( Datasets - UCI Machine Learning Repository),其中包含关于自行车租赁的信息。数据以csv表格形式保存在dataset 文件夹中,其中day.csv是按日期为最小粒度进行记录的数据,hour.csv是以小时为 最小粒度进行记录的数据,Readme.txt是本案例数据的英文解释。以下是数据集的 中文解释

本例使用了一个Abalone(Datasets - UCI Machine Learning Repository)数据集, 其中包含关于鲍鱼的信息。数据以data形式保存在dataset文件夹中,其中 abalone.data是数据,abalone.names是本案例数据的英文解释。以下是数据集的 中文解释:数据集地址鲍鱼 - UCI 机器学习存储库通过物理测量预测鲍鱼的年龄。鲍鱼的年龄是通过将

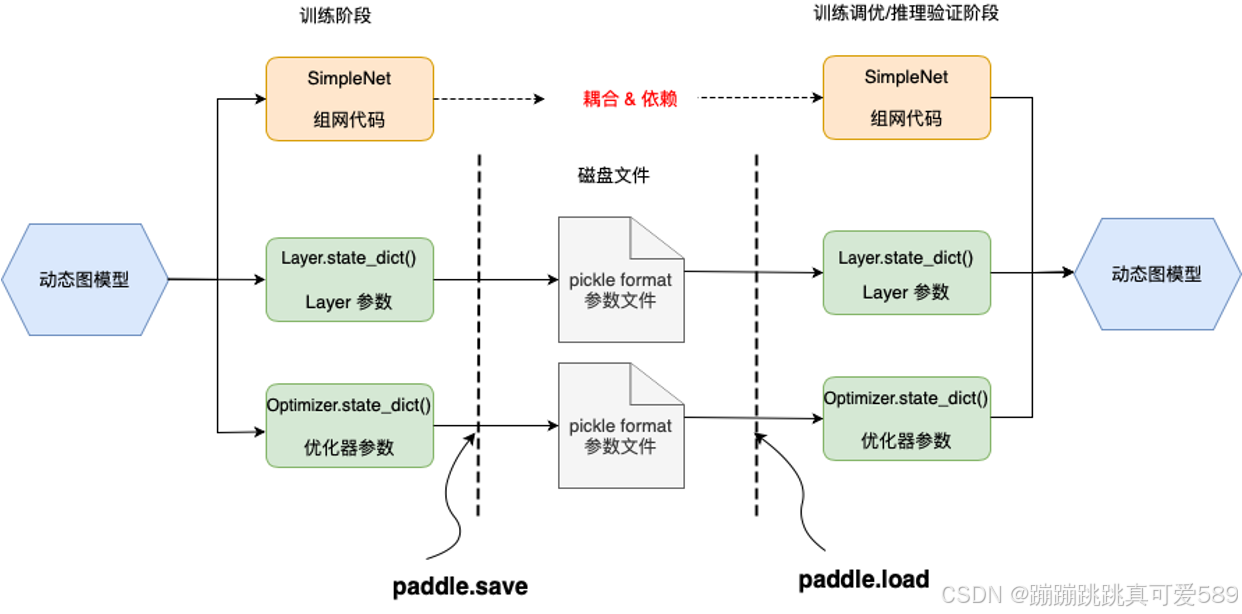

经典模型可以满足一些简单深度学习任务的需求,然后更多情况下,需要使用深度学习框架构建一个自己的神经网络,这时可以使用飞桨框架paddle.nn下的 API 构建网络,该目录下定义了丰富的神经网络层和相关函数 API,如卷积网络相关的 Conv1D、Conv2D、Conv3D,循环神经网络相关的 RNN、LSTM、GRU 等,方便组网调用,详细清单可在API 文档中查看。使用组网:构建顺序的线性网络