简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

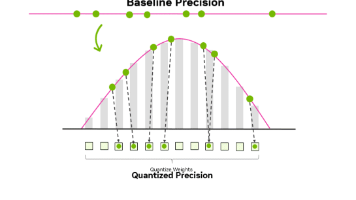

pass对称量化:零点为 0,计算快,适合权重。非对称量化:零点可调,适合非零中心分布(如 ReLU 激活)。TensorRT 提供 Calibrator,支持两种量化方式,可灵活选择。💡下一课预告:带大家搞懂直方图校准 + KL 散度—— 把极端值(outlier)踢出去,scale 选得更聪明。👉 如果文章帮到你,记得点个「赞」👍 支持一下,评论区欢迎贴代码/交流问题,我会在线答疑~#

本文提供了一份完整的YOLOv8目标检测模型训练教程,涵盖从环境配置到模型训练的完整流程。教程详细介绍了PyCharm安装、conda环境搭建、GPU驱动配置(CUDA/cuDNN)、LabelImg数据标注工具使用,以及如何准备自定义数据集和训练YOLOv8模型。特别针对Windows系统用户,给出了详细的路径设置和常见问题解决方案。文章还包含了模型验证和推理方法,并提供了训练参数调整建议。本教

本文介绍了使用Netron工具可视化YOLOv8模型结构的详细指南。Netron是一款支持30+框架的模型可视化工具,能够清晰展示模型输入输出、算子节点等细节。文章提供了Netron的下载安装方法(网页版/离线版),并详细讲解了如何将YOLOv8模型导出为ONNX格式(包括静态和动态导出方式)。通过Netron可以直观查看YOLOv8的输入节点(1,3,640,640)、主干网络、检测头以及输出节

《GPU性能优化实战:Nsight工具与Profiling技术解析》 本文系统介绍了GPU性能分析(Profiling)的核心方法和NVIDIA Nsight工具套件的使用。文章首先解释了Profiling的概念,即通过性能指标分析找出程序瓶颈的技术。然后详细介绍了Nsight家族三大工具:系统级分析的Nsight Systems、核函数级分析的Nsight Compute和图形渲染分析的Nsig

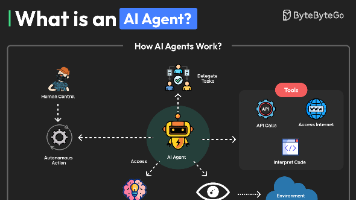

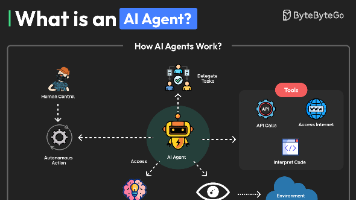

本文系统梳理了AIAgent(智能体)的核心概念与发展趋势。AIAgent是基于大语言模型(LLM)的智能决策单元,具备感知环境、规划任务、执行行动等能力,可调用工具、访问知识库完成复杂任务。其核心架构包括感知、推理、工具调用、记忆、执行和反馈等模块。主要类型有单智能体、多智能体协作和人机协作模式。关键能力包括检索增强、记忆机制、任务拆解等。文章分析了Auto-GPT等典型案例,提出角色定义、监测

本文介绍了TensorRT中INT8量化的基本原理与应用。量化通过将FP32模型压缩为INT8格式,可减少75%内存占用并显著提升推理速度。文章详细解析了对称/非对称量化、逐层/逐通道量化等策略,以及量化的数学本质。同时指出量化会带来精度损失,需要校准数据集来优化。TensorRT提供了PTQ(训练后量化)和QAT(量化感知训练)两种模式,并支持自动处理不支持INT8的层。量化是性能与精度的权衡,

Postman 2025指南:API测试利器使用全解析 Postman是一款支持多协议的API开发测试工具,2025年最新版v11.57.0新增AI测试生成功能。本文详细介绍了Postman的安装配置(Windows/macOS/Linux)、基础操作(GET/POST请求发送)和高级功能(环境变量、测试脚本、批量测试)。重点讲解了2025版本特性:AI智能测试生成、性能优化40%、协作增强等。同

FastAPI作为Python现代Web框架新秀,凭借高性能、自动文档生成、异步支持和强类型检查等优势迅速崛起。它基于Starlette和Pydantic,性能媲美Node.js/Go,特别适合AI应用、微服务和高并发API开发。相比Flask/Django,FastAPI在自动验证、文档生成和异步处理方面表现更优。通过简单示例展示了其路由定义、数据验证和异步处理能力,并推荐了Uvicorn+Gu

本文系统梳理了AIAgent(智能体)的核心概念与发展趋势。AIAgent是基于大语言模型(LLM)的智能决策单元,具备感知环境、规划任务、执行行动等能力,可调用工具、访问知识库完成复杂任务。其核心架构包括感知、推理、工具调用、记忆、执行和反馈等模块。主要类型有单智能体、多智能体协作和人机协作模式。关键能力包括检索增强、记忆机制、任务拆解等。文章分析了Auto-GPT等典型案例,提出角色定义、监测

TensorRT-LLM:NVIDIA的大模型推理加速利器 摘要:TensorRT-LLM是NVIDIA推出的高性能大语言模型推理框架,通过三级架构设计实现极致优化:1)Pythonic模型定义层保持开发灵活性;2)AOT编译层实现算子融合与内核调优;3)运行时系统支持动态批处理。核心优势包括:支持H100专属FP8量化,吞吐量达6000+tokens/s;分页KV缓存将显存碎片率从35%降至5%