简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

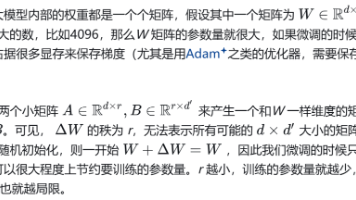

01大模型微调初步尝试:多位数乘法本文记录了本人在大模型微调任务上的初步尝试,其任务为让大模型学会多位数(实际上是 3 位数及以内)的乘法,并且按照给定的步骤输出过程(Chain of Thought)。LoRA 微调的原理LoRA 的原理网上已经有很多资料给了说明,这里稍作讲解:LoRA = Low Rank Adaption,也就是用一个低秩矩阵去拟合参数。有一些说法认为 LoRA 可以避免模

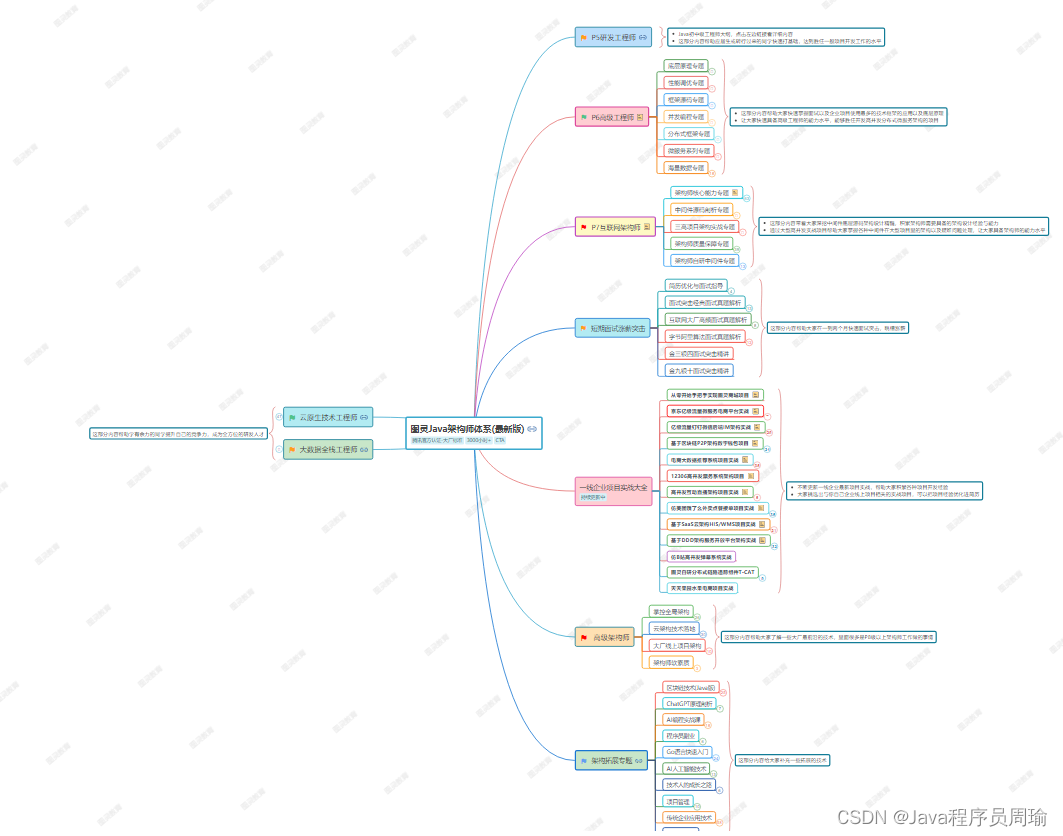

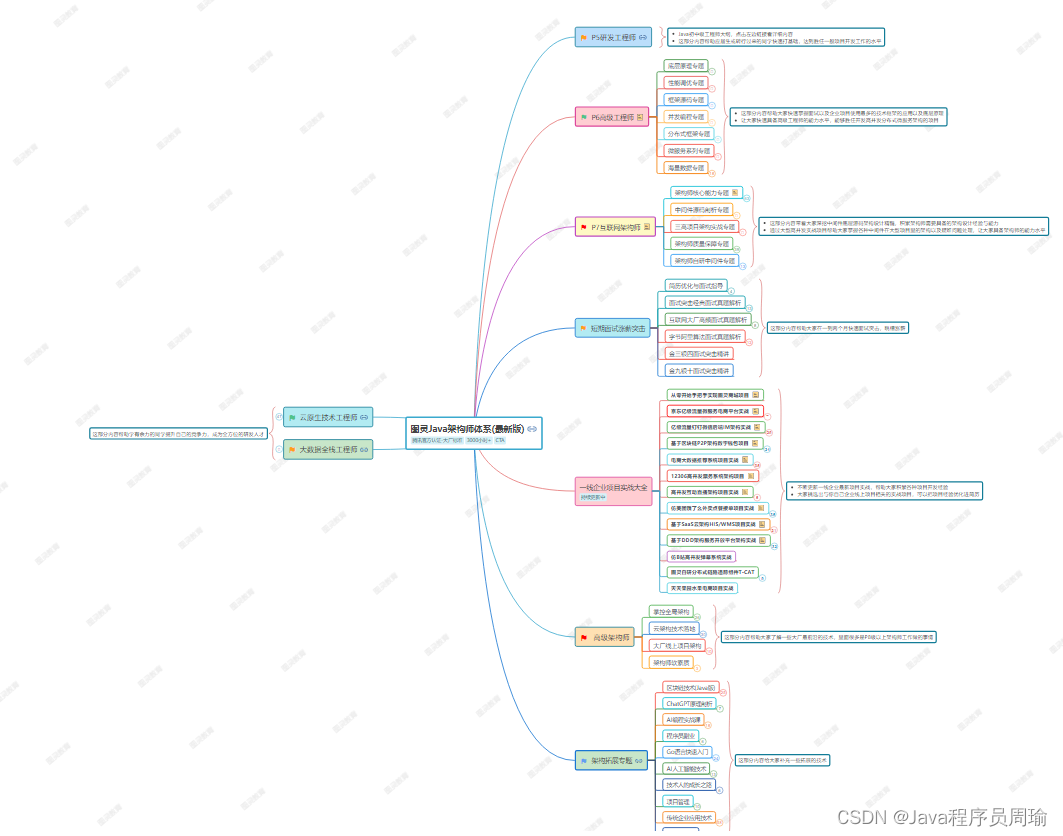

网上虽然教学资料、路线非常多,我们也不否认有些确实有可取之处,但是我们认为一个好的路线,不仅仅只是一条线,应该是点——线——面,三重结合,应该具有系统、规划、全面、细致这四个特性,而这也是网上资源所缺失的,我们本着这个原则,给大家整理了一份2023年系统全面、具有规划的Java学习路线图。我们深知,有很多同学对于培训费用、是否适合、怎么学等等有着各种各样的顾虑,在网上各大平台搜寻着学习方法资料等等

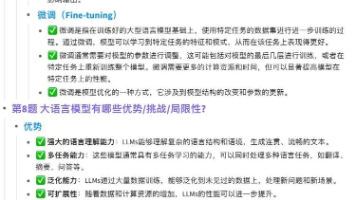

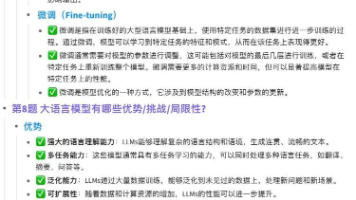

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模

网上虽然教学资料、路线非常多,我们也不否认有些确实有可取之处,但是我们认为一个好的路线,不仅仅只是一条线,应该是点——线——面,三重结合,应该具有系统、规划、全面、细致这四个特性,而这也是网上资源所缺失的,我们本着这个原则,给大家整理了一份2023年系统全面、具有规划的Java学习路线图。我们深知,有很多同学对于培训费用、是否适合、怎么学等等有着各种各样的顾虑,在网上各大平台搜寻着学习方法资料等等

本文总结了作者在腾讯、阿里、百度等公司的大模型算法岗面试经历。面试内容涵盖了大模型的基础知识、结构差异、位置编码、预训练与推理、RLHF(包括PPO和DPO的区别)、超长上下文处理、智能体组件等。此外,还涉及了数据清洗、模型幻觉、复读问题、工具调用等实际应用问题。面试官注重考察候选人的基础知识、项目经验、问题解决能力以及对大模型技术的深入理解。整体面试体验良好,面试官专业且愿意深入探讨,面试难度适

最近这一两周不少大厂都已经开始秋招面试了。不同以往的是,当前职场环境已不再是那个双向奔赴时代了。求职者在变多,HC 在变少,岗位要求还更高了。今天分享我们一星球成员面试 minimax 大模型岗一面、二面面经。面试题涉及项目、论文、八股都会问到,难度中规中矩,想找大模型方向的同学可以了解下,有什么问题欢迎评论区交流后续我会继续分享同学们的面试经验,希望能够帮助大家拿下满意的 offer 这份《AI

大部分常用的 Python 库,在定义插件时都可以直接导入(比如 json,time,random)。其他一些必要的模块(比如 requests,datetime等),还可以从左侧的依赖包中添加,这就给了插件模块比代码模块高了几个维度的灵活性。

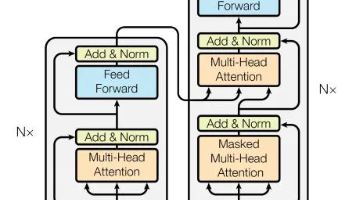

Transformer架构最初由谷歌研究人员于2017年在论文《注意力就是你所需要的一切》("Attention Is All You Need")中提出。这一架构的诞生标志着自然语言处理领域的一次重大突破,因为它彻底颠覆了传统的序列到序列学习模型的设计思路。在此之前,基于循环神经网络(RNN)的模型在机器翻译、语音识别等任务中占据主导地位,但RNN的串行处理方式使其计算效率低下,时间复杂度为O(