简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

如果不在,会说“无法确定”。有人在和GPT-4的对话中提到“我有高血压,正在吃缬沙坦(一种降压药)”,后来聊无关话题(如“推荐旅游景点”)时,模型突然说“你有高血压,旅游时记得带缬沙坦”——这说明模型记住了之前的隐私信息,没有及时“忘记”。患者起诉后,法院判决“医院承担30%责任(未人工复核),AI开发商承担45%责任(模型错误率超标),医生承担25%责任(轻信AI结果)”,同时要求开发商建立“错

文档摘要:1000字的技术文章→200字要点,比如输入一篇关于“LLM幻觉问题”的文章,摘要会包括“幻觉定义、原因、解决方法、行业影响”。会议录音转摘要:将1小时的会议录音(转文字后)浓缩为500字摘要,标注“决策事项、待办任务、责任人”。新闻摘要:输入一篇5000字的深度报道,模型能提炼出“事件起因、经过、结果、各方观点”。Transformer架构:是LLM的“骨架”——通过自注意力机制实现并

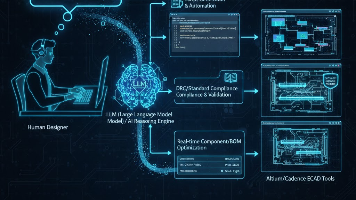

摘要:本文探讨了大语言模型(LLM)在电子设计自动化(EDA)领域的应用挑战与突破路径。研究指出,LLM在原理图生成环节面临拓扑结构理解和几何转化难题,PCB布局需解决NP完全问题和制造约束,规则校验存在AI不确定性与工程确定性矛盾,元器件选型需处理动态知识更新。解决方案包括多模态融合、分层优化、混合推理引擎等技术创新。未来趋势将聚焦多模态交互、实时优化、可解释性及边缘计算部署。LLM4EDA技术

时间全球模型/技术中国模型/技术核心贡献2017阿里中文Transformer适配自注意力机制奠定基础;中文分词优化提升准确率2-3%。2018BERT/GPT-1预训练范式确立;中文知识掩码突破语义理解。2020GPT-3验证缩放定律;中文场景缩放定律落地,成本降低56%。2022模型对齐实用化;中文RLHF+文生图突破,落地政务场景。2023开源生态爆发;中文开源模型覆盖代码领域,下载量破1亿

本文系统梳理了1986-2026年AI大模型40年的发展历程。研究以反向传播算法为起点,划分为早期探索(1986-2005)、深度学习复兴(2006-2016)和大模型时代(2017-2026)三个阶段,详细分析了各时期的关键技术突破(如AlexNet、GAN、Transformer)和应用场景拓展。研究发现模型架构经历了从感知机到Transformer的九次认知跃迁,呈现出参数规模扩大、多模态融

全参数微调(Full Fine-tuning)就像是让已经大学毕业的学霸重新上一次大学,但这次只学习特定专业的知识。专业术语解释术语解释来源类比参数(Parameters)模型中可调整的数值,决定模型如何处理输入和生成输出源自数学中的"参数"概念,在机器学习中特指模型内部的权重值人类大脑中的"神经连接强度"全参数微调调整模型中的所有参数,让整个模型适应新任务深度学习中的标准微调方法让员工接受全方位

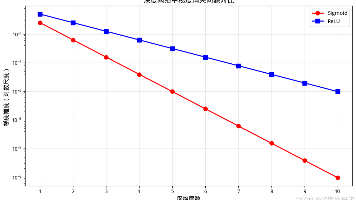

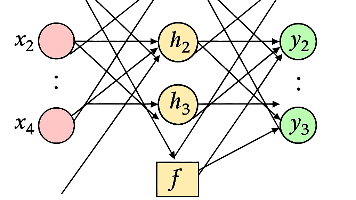

GeLU激活函数将高斯分布与神经网络巧妙融合,通过概率性激活机制解决了ReLU的硬截断问题。其核心思想是利用输入值的概率来软性调节激活强度,数学上表现为输入值与高斯CDF的乘积。GeLU具有四大优势:1)结合ReLU与Dropout思想;2)处处可导的平滑性;3)零均值激活分布;4)在Transformer架构中表现出色。相比ReLU,GeLU能更好地保留负值信息,缓解神经元死亡问题,同时保持训练

Sigmoid函数:从人口模型到深度学习的演变与局限 摘要:Sigmoid函数起源于1838年韦吕勒的人口增长模型,后在1943年成为MCP神经元的基础。其S型曲线特性(平滑、可微、有界)使其成为神经网络理想的激活函数,尤其适合二分类问题的概率输出。然而在深度学习中,Sigmoid的导数上限(0.25)导致梯度连乘时出现指数级衰减,造成训练停滞。现代神经网络多采用ReLU等替代方案,但Sigmoi

罗森布拉特在1958年写道:“感知机不是机器智能的最终答案,而是理解脑功能的起点。感知机的出现在冷战时期引起轰动,《纽约时报》报道称其为“海军研制的电子大脑雏形,能够行走、说话、观看、书写并自我复制”。感知机模型告诉我们:真正的创新往往不是一蹴而就的完美解决方案,而是开启新探索的第一把钥匙。1969年,马文·明斯基和西摩·帕普特在《感知机》一书中严格证明了单层感知机无法解决线性不可分问题,最著名的

摘要 神经网络时序建模经历了从静态到动态、从简单到复杂的演进过程。1960年代,带延迟的感知机首次引入时序信息,但依赖人工设定步长;1980年代,霍普菲尔德网络和玻尔兹曼机分别通过反馈结构和概率建模为RNN奠定基础;1986年Elman/Jordan网络正式提出循环连接结构,实现动态时序建模;1997年双向RNN解决上下文依赖问题,LSTM通过门控机制攻克梯度消失难题;2014年GRU进一步简化结